SG.hu·

A mesterséges intelligencia olyan veszélyes, mint az atombomba

A Google egykori vezetője szerint a nagyhatalmaknak önkorlátozást kellene tanúsítaniuk.

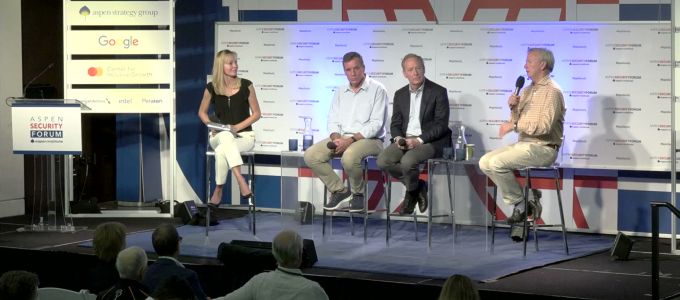

Eric Schmidt, a reklámcég korábbi vezérigazgatója az Aspeni Biztonsági Fórumon a féktelen mesterséges intelligencia-fegyverkezési versenytől óvott. A menedzser úgy véli, hogy a mesterséges intelligencia olyan veszélyes, mint az atombomba. Kifejtette, hogy munkába állásakor még ő maga is naiv volt a technológia erejét illetően. Az üzletember egy új megállapodás megkötését szorgalmazta, amelyet a nukleáris fegyverek elterjedésének megakadályozásáról szóló szerződés mintájára dolgoznának ki és fogadnának el.

Schmidt rámutatott az Amerikai Egyesült Államok és Kína közötti mesterséges intelligencia-fegyverkezési verseny veszélyére és a jelenlegi helyzetet az 1950-es és 1960-as évekhez hasonlította, amikor egy esetleges nukleáris támadás horrorforgatókönyve Damoklész kardjaként lebegett egyes országok felett. Miután az USA 1945 augusztusában atombombát dobott Hirosimára és Nagaszakira, pár évvel később Kína és a Szovjetunió is létrehozta a saját fegyvereit. Az USA, Kína és a Szovjetunió mellett Franciaország és Nagy-Britannia is azon öt úgynevezett hivatalos atomhatalom közé tartozott, amelyek aláírták az 1970-ben hatályba lépett atomsorompó-szerződést, igaz, azt Franciaország és Kína csak 1992-ben jegyezte ellen. Ezenkívül India, Pakisztán, Észak-Korea és Izrael is rendelkezik nukleáris fegyverekkel.

Hivatalosan ezek az eszközök kölcsönösen elrettentő hatásúak. Az elmélet szerint a nukleáris hatalmak azért tartanak az első csapástól, mert fel kell tételezniük, hogy a másik nukleáris hatalom vissza fog csapni - és végül a világ, ahogyan mi ismerjük, megsemmisülne. A meglepetések elkerülésére ezért a kísérleti rakétakilövések előtt az államok előre figyelmeztették egymást, így növelték az egymás iránti bizalmat. Schmidt valami hasonló szabályozást követel a mesterséges intelligencia ágazat számára.

Szerinte ez az egyetlen módja annak, hogy megakadályozzuk, hogy a világ egy mesterséges intelligencia által kiváltott katasztrófával érjen véget. Kínának és az USA-nak ennek megfelelően tárgyalnia kellene egy békés egymás mellett élésről szóló szerződésről - függetlenül attól, hogy mit gondolnak a másik országról és annak politikai rendszeréről. Probléma, hogy kormányzati szinten még egyik ország sem áll készen erre, még azt se tudni ki fog az elképzelt asztalhoz ülni, nemhogy a konkrét kérdésekről vitatkoznának.

"Nagyon aggaszt, hogy az Egyesült Államok úgy tekint Kínára, mint korruptra, kommunistára vagy bármi másra, a kínaiak pedig Amerikát kudarcnak látják" - hangsúlyozta a menedzser, ezért bármit el tudnak képzelni a másikról és egy veszélyes eszkaláció kezdődik. A Google egykori vezetője azt kérte, hogy a technológiát jobban igazítsák az emberi etikához és erkölcshöz, akiket szolgál. Az ugyanakkor kérdéses, hogy valóban össze lehet-e és kell-e hasonlítani a mesterséges intelligenciát a nukleáris fegyverekkel. A létrehozott rendszerek teremtőinek tükörképei, és nem pusztítanak, hacsak a fejlesztői meg nem tanítják erre.

Eric Schmidt, a reklámcég korábbi vezérigazgatója az Aspeni Biztonsági Fórumon a féktelen mesterséges intelligencia-fegyverkezési versenytől óvott. A menedzser úgy véli, hogy a mesterséges intelligencia olyan veszélyes, mint az atombomba. Kifejtette, hogy munkába állásakor még ő maga is naiv volt a technológia erejét illetően. Az üzletember egy új megállapodás megkötését szorgalmazta, amelyet a nukleáris fegyverek elterjedésének megakadályozásáról szóló szerződés mintájára dolgoznának ki és fogadnának el.

Schmidt rámutatott az Amerikai Egyesült Államok és Kína közötti mesterséges intelligencia-fegyverkezési verseny veszélyére és a jelenlegi helyzetet az 1950-es és 1960-as évekhez hasonlította, amikor egy esetleges nukleáris támadás horrorforgatókönyve Damoklész kardjaként lebegett egyes országok felett. Miután az USA 1945 augusztusában atombombát dobott Hirosimára és Nagaszakira, pár évvel később Kína és a Szovjetunió is létrehozta a saját fegyvereit. Az USA, Kína és a Szovjetunió mellett Franciaország és Nagy-Britannia is azon öt úgynevezett hivatalos atomhatalom közé tartozott, amelyek aláírták az 1970-ben hatályba lépett atomsorompó-szerződést, igaz, azt Franciaország és Kína csak 1992-ben jegyezte ellen. Ezenkívül India, Pakisztán, Észak-Korea és Izrael is rendelkezik nukleáris fegyverekkel.

Hivatalosan ezek az eszközök kölcsönösen elrettentő hatásúak. Az elmélet szerint a nukleáris hatalmak azért tartanak az első csapástól, mert fel kell tételezniük, hogy a másik nukleáris hatalom vissza fog csapni - és végül a világ, ahogyan mi ismerjük, megsemmisülne. A meglepetések elkerülésére ezért a kísérleti rakétakilövések előtt az államok előre figyelmeztették egymást, így növelték az egymás iránti bizalmat. Schmidt valami hasonló szabályozást követel a mesterséges intelligencia ágazat számára.

Szerinte ez az egyetlen módja annak, hogy megakadályozzuk, hogy a világ egy mesterséges intelligencia által kiváltott katasztrófával érjen véget. Kínának és az USA-nak ennek megfelelően tárgyalnia kellene egy békés egymás mellett élésről szóló szerződésről - függetlenül attól, hogy mit gondolnak a másik országról és annak politikai rendszeréről. Probléma, hogy kormányzati szinten még egyik ország sem áll készen erre, még azt se tudni ki fog az elképzelt asztalhoz ülni, nemhogy a konkrét kérdésekről vitatkoznának.

"We are not ready for the negotiations that we need." - @ericschmidt #AspenSecurity pic.twitter.com/As749t6ZyU

— Aspen Security Forum (@AspenSecurity) July 22, 2022

"Nagyon aggaszt, hogy az Egyesült Államok úgy tekint Kínára, mint korruptra, kommunistára vagy bármi másra, a kínaiak pedig Amerikát kudarcnak látják" - hangsúlyozta a menedzser, ezért bármit el tudnak képzelni a másikról és egy veszélyes eszkaláció kezdődik. A Google egykori vezetője azt kérte, hogy a technológiát jobban igazítsák az emberi etikához és erkölcshöz, akiket szolgál. Az ugyanakkor kérdéses, hogy valóban össze lehet-e és kell-e hasonlítani a mesterséges intelligenciát a nukleáris fegyverekkel. A létrehozott rendszerek teremtőinek tükörképei, és nem pusztítanak, hacsak a fejlesztői meg nem tanítják erre.