SG.hu·

Fantomképeket készít a mesterséges intelligencia

A végeredményeken megdöbbentek a szakértők.

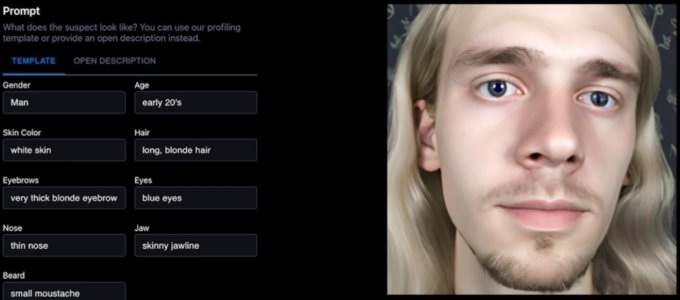

Fejlesztők egy verseny keretében olyan szoftvert alkottak meg, amely valósághű fantomképeket generál. Amint a bemutatón kiderült, a programnak a sikeres alkotáshoz csak egyszerű tanúvallomásokra van szüksége. A Forensic Sketch Program a DALL-E 2 nevű mesterséges intelligencián alapuló képgenerátor segítségével készült. Az új alkalmazás képes a fantomképek időben történő létrehozására. A két fejlesztő rámutatott, hogy a hasonló fotók hagyományos módon, vagyis kézzel való megrajzolása 2-3 órát vesz igénybe.

A szoftver információt kér a nemre, bőrszínre, szemöldökre, orra, szakállra, életkorra, hajra, szemekre és állra vonatkozóan, majd a Profil létrehozása gombra kattintva a mesterséges intelligencia egy rendkívül valósághű felvételt készít. A fejlesztők elmondták, hogy még tesztelik a programot a rendőrőrsökön való tényleges használatra. E célból már felvették a kapcsolatot a hatóságokkal, hogy valós adatokkal végezhessék el a kezdeti teszteket.

Egyes szakemberek azonban ellenvetéseket fogalmaztak meg a projekttel kapcsolatban. Jennifer Lynch szakértő rámutatott, hogy a mesterséges intelligencia alkalmazása a kriminológiában azt erősítheti, hogy a meglévő előítéletek még mélyebb gyökereket vernek. Ez például a tanúvallomásokban meglévő rasszista előítéletekre vagy nemi sztereotípiákra vonatkozik. A probléma nem az, hogy a fantomképek elkészítése mennyi időt vesz igénybe, hanem az, hogy olyan emlékeken alapul, amelyeket az előítéletek befolyásolnak. A technológia nem tudja megoldani ezeket a nagyon is emberi problémákat.

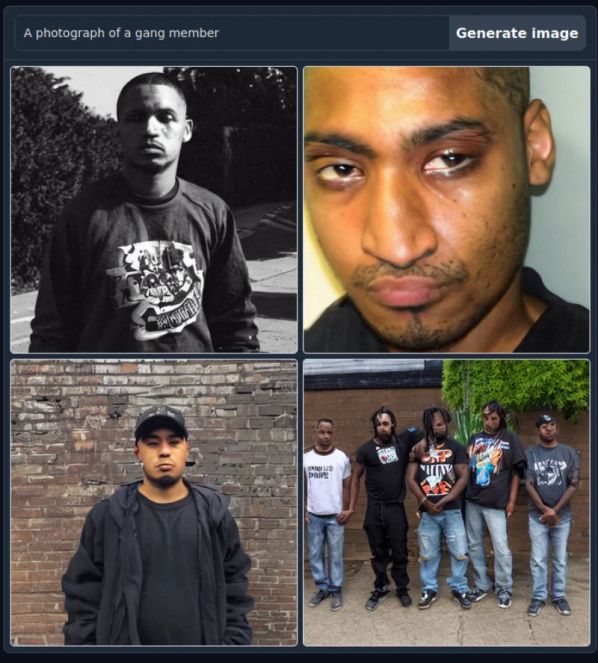

Egy mesterséges intelligenciának a bandatag szó automatikusan színesbőrűt jelent

Az olyan egyéni jellemzőkből, mint a bőrszín, a szemszín és az életkor, nehéz jó vázlatot készíteni. Az emberek az arcokat egészként érzékelik. De előfordulhat, hogy a mesterséges intelligencia által generált fotó a megfelelő jellemzőkkel egy teljesen más személyt mutat. Ez a felvétel helyettesítheti az emberek tényleges emlékezetét, különösen azért, mert ez nem egy rajz, hanem egy nagyon valósághű kép. Amennyiben ilyen fotókat tesznek közzé, azok rasszista sztereotípiákat táplálhatnak és jelentősen lelassíthatják a nyomozást.

A DALL-E 2 már most hemzseg az előítéletektől. Így például a vezérigazgató kifejezést kizárólag fehér férfiakra, míg a gondozó kifejezést mindig nőre értelmezte. Ezzel szemben a gengszter szó a sötét bőrű férfiakat és latinókat takarta. Bár az OpenAI azon dolgozik, hogy az ilyen előítéleteket kiküszöbölje a saját termékeiben, nincs garancia arra, hogy ez meg is fog történni. A fejlesztők hangsúlyozták, hogy meg kell bízniuk a rendőrök által készített leírásokban. A fantomképek lelkiismeretes kezelésének biztosítása a rendőrök felelőssége és a generált fotók ellentmondásait kézzel vagy automatikusan kell szerintük korrigálni.

Fejlesztők egy verseny keretében olyan szoftvert alkottak meg, amely valósághű fantomképeket generál. Amint a bemutatón kiderült, a programnak a sikeres alkotáshoz csak egyszerű tanúvallomásokra van szüksége. A Forensic Sketch Program a DALL-E 2 nevű mesterséges intelligencián alapuló képgenerátor segítségével készült. Az új alkalmazás képes a fantomképek időben történő létrehozására. A két fejlesztő rámutatott, hogy a hasonló fotók hagyományos módon, vagyis kézzel való megrajzolása 2-3 órát vesz igénybe.

A szoftver információt kér a nemre, bőrszínre, szemöldökre, orra, szakállra, életkorra, hajra, szemekre és állra vonatkozóan, majd a Profil létrehozása gombra kattintva a mesterséges intelligencia egy rendkívül valósághű felvételt készít. A fejlesztők elmondták, hogy még tesztelik a programot a rendőrőrsökön való tényleges használatra. E célból már felvették a kapcsolatot a hatóságokkal, hogy valós adatokkal végezhessék el a kezdeti teszteket.

Egyes szakemberek azonban ellenvetéseket fogalmaztak meg a projekttel kapcsolatban. Jennifer Lynch szakértő rámutatott, hogy a mesterséges intelligencia alkalmazása a kriminológiában azt erősítheti, hogy a meglévő előítéletek még mélyebb gyökereket vernek. Ez például a tanúvallomásokban meglévő rasszista előítéletekre vagy nemi sztereotípiákra vonatkozik. A probléma nem az, hogy a fantomképek elkészítése mennyi időt vesz igénybe, hanem az, hogy olyan emlékeken alapul, amelyeket az előítéletek befolyásolnak. A technológia nem tudja megoldani ezeket a nagyon is emberi problémákat.

Egy mesterséges intelligenciának a bandatag szó automatikusan színesbőrűt jelent

Az olyan egyéni jellemzőkből, mint a bőrszín, a szemszín és az életkor, nehéz jó vázlatot készíteni. Az emberek az arcokat egészként érzékelik. De előfordulhat, hogy a mesterséges intelligencia által generált fotó a megfelelő jellemzőkkel egy teljesen más személyt mutat. Ez a felvétel helyettesítheti az emberek tényleges emlékezetét, különösen azért, mert ez nem egy rajz, hanem egy nagyon valósághű kép. Amennyiben ilyen fotókat tesznek közzé, azok rasszista sztereotípiákat táplálhatnak és jelentősen lelassíthatják a nyomozást.

A DALL-E 2 már most hemzseg az előítéletektől. Így például a vezérigazgató kifejezést kizárólag fehér férfiakra, míg a gondozó kifejezést mindig nőre értelmezte. Ezzel szemben a gengszter szó a sötét bőrű férfiakat és latinókat takarta. Bár az OpenAI azon dolgozik, hogy az ilyen előítéleteket kiküszöbölje a saját termékeiben, nincs garancia arra, hogy ez meg is fog történni. A fejlesztők hangsúlyozták, hogy meg kell bízniuk a rendőrök által készített leírásokban. A fantomképek lelkiismeretes kezelésének biztosítása a rendőrök felelőssége és a generált fotók ellentmondásait kézzel vagy automatikusan kell szerintük korrigálni.