ATI RADEON X800

Jelentkezz be a hozzászóláshoz.

Az nVIDIA partnerei (igen, még az IBM sem) nem tértek még át a low-k technológiára, és ráadásul az NV40be egy kupac felesleges tranzisztor is került.

Félreértés ne essék, a feleslegest csak azért irtam, mert a tesztekben egyértelmûen látható, hogy semmire nem ment a +62 millió tranzisztorával az R420-al szemben.

| | ClearBox JS > http://www.clearbox.hu > (referencia: www.iwiw.hu :) |

Ugyanez vonatkozik az "Ami az ATI-t nagyon érzékenyen fogja érinteni" kijelentésre, aminek logikusan nulla valóságalapja van...

"So, according to the results obtained in Xbitmark, we can conclude that texturing samples in the shaders are a weak spot of the new RADEON X800, while mathematical calculations, on the contrary, are a strength of the new ATI architecture."

"Well, it seems that the new ATI Technologies’ graphics processors feel themselves like a fish in the water in situations when they have to render extremely complex scenes. NVIDIA’s GeForce 6800 Ultra brings us some good speed too, but is behind the rival under heavy load – that’s for sure."

Itt pedig az ATI CEO (Dave Orton) interjú

Érdemes elolvasni, amit a gyártási kihozatalról, és az NV40-rõl ir... (persze, nem független forrás, de eléggé elgondolkodtató)

Amúgy itt nem arról van szó, hogy ne lenne jó dolog a PS3, ezt senki sem mondta. Csak egyesek szeretnék túlzottan is túldimenzionálni a jelentõségét. Holott ma BIZTOSAN semmi szerepe, holnap ugyancsak BIZTOSAN nem lesz semmi szerepe, majd ESETLEG néhány hónap múlva.

Emlékezzetek csak arra, hogy az ATI VPU-i nem bridge chippel térnek át a PCI Expressre, mint az nVIDIA cuccok, hanem natív támogatás kerül beléjük, tehát lényegében ÚJ VPU-RÓL BESZÉLÜNK 3 hónapon belül (R423). Itt pedig még BÁRMI olyan lemaradást behozhat az ATI, amire NETÁN idõközben szükséget teremt az nVIDIA marketing gépezete. Ez az érem másik oldala.

Ugye az X800XT és a 6800 Ultra eredményeit hasonlitottad össsze?

És ugye azt is tudod, mi az a partial precision?

Ha ezekre igennel válaszolnál, nem irtál volna ekkora hülyeséget.

NAGYON OKOSAN??? LOL! Te mekkora baromságokat írsz!

Arról meg ne is beszéljünk, hogy mekkora égés a kártya fogyasztása. Jöttök itt azzal, hogy DirectX 9.0c - nos az ATi, csak a PS3.0 hiánya miatt marad "b", de - mint olvashattátok - azért rengeteg dolog belekerült az X800-ba, ami túlmutat a PS2.0-n.

Ezen kívül: "mekkora erõtartalék van az NV40-ben" - LOL: és az X800-ban szerintetek nincs? Vajh miért van az, hogy képminõségben MÉG MINDÍG az ATi vezet torony magasan, emellett ha az anizotropikus szûrést is bekapcsolod, akkor igen nagyon ráver az nVidia kártyájára.

Aszongyátok, hogy azért kell az NV40-nek a qrva magas fogyasztás, mert hûdemilyengyorslesz, ésatöbbi. Meg a +sokmillió tranzisztor. Ez mind csak BLABLA.

Akkor az ATi vajon hogy tudta megcsinálni, hogy a legújabb kártyája még a 9800XT-nél is kevesebbet fogyaszt, miközben a teljesítménye drasztikusan nõtt...??? A mostani 9800-as (sima, pro, xt) kártyákat PASSZÍV HÛTÉSSEL lehet hûteni (ZALMAN borda, és ha a 9800XT-t lehet, akkor az X800-ast is, ami kevesebbet fogyaszt ugye...), ezt mikor fogod megtenni az NV40-nel??? NA EZ A LOL! 😊

| | ClearBox JS > http://www.clearbox.hu > (referencia: www.iwiw.hu :) |

¤¤¤¤o¤o,¸¸o¤o,¸¸,o¤o°`°o¤o,¸¸,o¤o°`°o¤o,¸¸o¤o,¸¸,o¤o°`°o¤o,¸¸,o¤o°`°o¤o,¸¸o¤o,¸¸,o¤o°`°o¤o,¸¸,o¤o°`°o¤o,¸¸o¤o,¸¸,o¤o°`°o¤o,¸¸,o¤o°`°o¤O3>

Tény, hogy OpenGL-ben van mit fejlõdnie az ATI-nak, azonban ez PUSZTÁN DRIVER kérdés, és nem hardver.

Az elsõ játék, amely NYOMOKBAN PS2-t használt a TRAOD volt, az elsõ olyan, ami pedig viszonylag rendesen kihasználja, a mostani Far Cry.

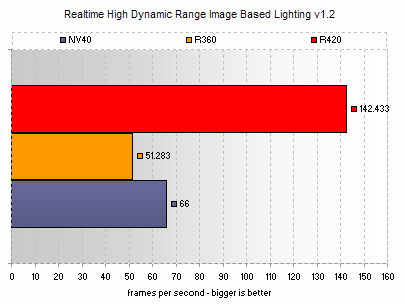

Egyébként pont az RTHDRIBL demóra visszatérve, íme a teljesítmények:

Nekem nagyon úgy tûnik, hogy jelentõs tartalékai vannak technológiai téren de úgy gondolja, hogy cseppenként adagolja, mert az nvidiával szemben jelenleg ez is elég.

Úgy sejtem, hogy a következõ generációs ATi kártya megint nagyot fog szólni.

¤¤¤¤o¤o,¸¸o¤o,¸¸,o¤o°`°o¤o,¸¸,o¤o°`°o¤o,¸¸o¤o,¸¸,o¤o°`°o¤o,¸¸,o¤o°`°o¤o,¸¸o¤o,¸¸,o¤o°`°o¤o,¸¸,o¤o°`°o¤o,¸¸o¤o,¸¸,o¤o°`°o¤o,¸¸,o¤o°`°o¤O3>

Holott a cikk végén is egyértelmûen ott van, hogy nincs gyõztese a tesztnek, a dolgok a támogatottságon, és az áron múlnak.

Sõt, az is ott áll kerek perec, hogy az NV40 elõnye a PS3, az ATI-é meg sokkal jobb fogyasztás, azonos teljesítmény mellett.

Egyátalán nem lett lehúzva egyik kártya sem, mindkettõnek ki van emelve a pozitivuma, és a negativuma is.

Ugyanugy, ahogy a 9700 PS2.0-ját egész idáig nem használta ki semmi, ugyanúgy nem fogja a PS 3.0-t sem. Szimpla döntés volt arról, hogy mi a fontosabb. Belepumpáltak pluszban 62 millió tranzisztort az NV40be, hogy tudjon valami olyant, amire nincs szükség, de csillivilli... Emiatt viszont sokkal rosszabb lesz a kihozatal, és jobban is melegszik. El lehet dönteni volt e értelme.

A VR-Zone oldalon megjelent hír alapján, a 61.11-es meghajtó verzió jelentõs gyorsulást ígér, a 60.72-es meghajtóval szemben.

~5% Aquamark

~5% X2

~5% Tomb Raider: Angel of Darkness

~10% Call of Duty

több mint 20% Far Cry

A fenti gyorsulás természetesen az NVIDIA új zászlóshajójára, a GeForce 6800-as szériára értendõ. A régebbi kártyákon mért teljesítményrõl nem esik szó a hírben."

Végsõ soron minden az ártól és a támogatottságtól függ.)

Avg. continuous power draw while looping 3DMark03: X800 Pro - 49W, X800 XT - 65W

Avg. continuous power draw while looping 3DMark01: X800 Pro - 58W, X800 XT - 76W

Magyarítva:

Átlagos fogyasztás folyamatosan futó 3DMark2001/3Dmark'03 alatt:

X800Pro: 58/49Watt

X800XT: 76/65Watt

OFF:

Valaki elárúlná mi a rákért lehet ekkora különbség a két program futattása alatt? Ennyit számítana, hogy a VPU milyen részeit használja a benchmark?

A csapatmunka roppant fontos: rajtad kívül másra is l?hetnek!

Az nVidia elég tõkeerõs cég, és eddig is komolyan támogattot játékfejlesztõ cégeket - nyilván, hogy most minden követ meg fog mozgatni a PS3.0 alkalmazásához, és figyelembe véve a trendeket, sokszor fogunk még arról olvasni, hogy ez-meg-az a játék támogatja alapból a PS3.0-át, amit ugye jelenleg csak és kizárólag a GeForce 6800 család tud. Csak várjuk meg az E3-at, és csodálkoznék, ha ott nem lenne legalább jópár ilyen bejelentés majd... 😊

Szóval az ATi részérõl ez a lépés kissé ingoványos talajt ért, kérdés, hogy a vásárlók hogy fognak dönteni...

A csapatmunka roppant fontos: rajtad kívül másra is l?hetnek!

Hõérzékelõs fordulatszámszabályozás van benne, mint az FX-ekben, de ha felpörög akkor bizony nagyon hangos a refkártya a tesztek szerint (valami 40-45db körüli értékrõl rebesgettek, de persze ez a gyártók egyéni hûtésétõl is függeni fog).

Mennyivel fogyaszt többet?

Mármint mi? A Geforce 6800Ultra olyan 110-120 Watt körül eszik. A Radeon 9800XT olyan 81 Watt körül, de az 0,15 mikronos (X800: 0,13 mikron), ráadásul nem low-k gyártástechnológia, amit az X800 magáénak tudhat. Szóval ezek alapján a fogyasztása semmiképpen nem lehet a Radeon 9800XT fölött. Ami még így is 30-40 Wattal kevesebb, mint a GeForce 6800Ultráé.

Egy mai hardcore gamer, jól leterhelt, zsúfolt gépébe, 300W-550W-s acorp, mercury, codegen tápos házba beraknád nyugodt szívvel akár az X800-t is?

Aki hardcore gamer, és ilyen tápegysége van, az meg is érdemli, ilyenbe még egy 9800Pro-t sem mernék rakni 😊))

Aki meg több, mint hatvan-hetvenezer forintott áldoz egy videókártyára, az ne sajnáljon már egy húsz-harmincezer forintott egy jó tápegységre. Nem csak a videókártya miatt, hanem az egész gépére való tekintettel.

Azért az a plusz 62 milla tranyó NV-ben feltételez valamit a jövõre tekintve;-)

Pardon, de anno a GeForce FX-eknél volt a tranyómennyiség terén az elõny ha jól tévedek. Szóval ez önmagában nem ad okot semmire...

Mielõtt újabb flamehullám kezdõdne erre reagálva, elmondanám, hogy személy szerint nem tartom rossz kártyának a GeForce 6800-at, legalábbis ami a teljesítményét és a képességeit illeti. Amit viszont nehezen vesz be a gyomrom, az az extrén energiafelvétel és a nagy hõledás és az abból adódó komoly hûtésigény. Remélem az nVidia ahogy anno a GeForce FX5800 után gyorsan revizitálta a GPU-t, és kihozta az annál sokkal versenyképesebb FX5900-at, úgy képes lesz itt is felülkerekedni a nehézségeken (és õ is sikerrel átáll a low-k gyártástechnológiára, ami miatt kisebb fogyasztás, kevesebb hõtermelés, és ezáltal kisebb hûtés is elég lenne, illetve nagyobb elérhetõ mûködési frekvencia lehetséges). Drukkolok nekik.

A csapatmunka roppant fontos: rajtad kívül másra is l?hetnek!

\"És cselekszem rajtok nagy bosszúállásokat fenyítő haragomban, hogy megtudják,hogy én vagyok az Úr,ha bosszúmat állom rajtok.\" Ezékiel 25, 17

\"És cselekszem rajtok nagy bosszúállásokat fenyítő haragomban, hogy megtudják,hogy én vagyok az Úr,ha bosszúmat állom rajtok.\" Ezékiel 25, 17

Az Ati egyértelmûen jobb játékra.Az Nvidia nem tudom

mire jó, de valamire biztos.

Persze ez csak magánvélemény, de biztos vagyok benne hogy sokan gondolkodnak hozzám hasonlóan

Nem 1 töredékmondatot kell kiragadni a cikkbõl, mint "basszus" tette, és egy oltári nagy baromságot levonni következtetésképpen...

Ami tény az tény, az nVIDIA kártyája többet fejlõdõtt, de neki volt is miért. Világosan le van irva, hogy még annak ellenére is, hogy hiányzik a PS3.0, az ATI hardvere erõsebb lett. Ugyanugy ottvan a 16 pipe, meg a 6 VS egység, ráadásul a low-k miatt jó 125MHz-el gyorsabban tud futni... Ezek egyszerû tények, még csak nem is következtetések, hogy elfogult lehessen.

pl: "Az architektúrális különbségek jól mutatják, hogy mekkora erõ is lakozott az R3x0 VPU-ban. Az R420 ugyanis messze nem jelent akkora elõrelépést, mint az NV40 az NV30-hoz képest, mégis teljesítményével simán képes utolérni azt."

Én nem vagyok sem az ATI, sem az Nvidia oldalán, de az eddig leírtakból szerintem késõbb sokkal többet lehet majd kihozni az Nvidia kártyákból. Sokkal többet fejlõdött az Nvidia, mint az ATI.

Gigabyte P35 DS3, Intel E2180@2500, 2GB DDR2@1066, Inno3D 9600GT 512MB

Az emberek őrültnek tartanak. Ez talán igaz is, és akkor mindegy, ha eggyel több a holdkóros. Viszont, ha igazam van, és a tudomány téved, akkor Isten irgalmazzon az emberiségnek. Viktor Schauberger