SG.hu·

Végső fázisába ért az EU mesterséges intelligencia szabályozása

Az utolsó hetek intenzív tárgyalásaihoz érkezett a világ első mesterséges intelligenciáról szóló átfogó törvénye. Az uniós intézményeknek azonban még ki kell alakítaniuk a legerősebb "alapmodellekkel" és a jogalkalmazási területekre vonatkozó rendelkezésekkel kapcsolatos megközelítésüket.

Kedd este (október 24-én) kezdődött meg az EU Tanácsa, a Parlament és a Bizottság magas szintű ülése és egészen szerda hajnalig elhúzódott, de az intézményközi tárgyalások - avagy trilógus, ahogy az uniós szakzsargonban nevezik - eredménye felemás. Az uniós döntéshozók megállapodtak a magas kockázatú mesterséges intelligencia-alkalmazások osztályozására vonatkozó rendelkezésekről, és általános iránymutatást adtak a nagy teljesítményű alapmodellek kezeléséről; arról, hogy kinek kell felügyelnie azokat, de alig karcolták a felszínt a tilalmakra és a jogérvényesítésre vonatkozó részt tekintve.

Most minden szem a következő, december 6-i háromoldalú egyeztetésre szegeződik, ahol politikai megállapodás várható, de az eredmény itt sem garantált. Addig is kilenc technikai ülést terveztek be, hogy a mesterséges intelligenciáról szóló törvény néhány legösszetettebb és legkövetkezetesebb aspektusának szövegét rögzítsék.

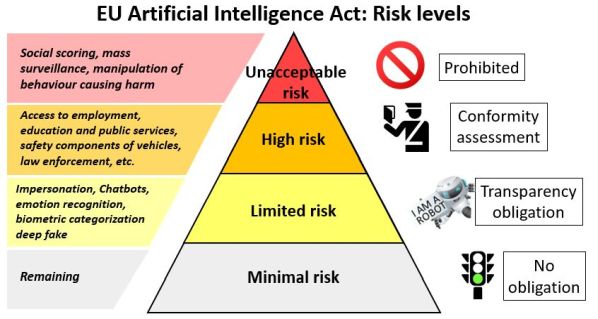

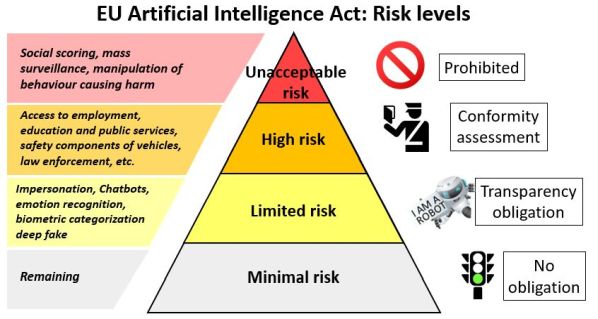

Az európai MI-törvény kockázatalapú megközelítést követ, amelynek értelmében azoknak az MI-modelleknek, amelyek jelentős kockázatot jelenthetnek az emberek egészségére, biztonságára és alapvető jogaira, szigorú kötelezettségeknek kell megfelelniük, például a kockázatkezelés és az adatkezelés terén. Az eredeti javaslatban minden olyan mesterséges intelligencia-megoldást, amely a kritikus felhasználási esetek előre meghatározott listájába tartozik, magas kockázatúnak minősítettek. Ezen a listán van például a foglalkoztatás és a migráció ellenőrzése, például a cégeknél a felvételről és előléptetésekről, jutalmakról döntő személyzeti algoritmusok.

Az EU készülő MI törvénye be fogja tiltani a tömeges megfigyelést, tanúsítást követel majd meg a kritikus területeken, míg átláthatóságot a korlátozott kockázatú rendszereknél

Az október 2-án tartott előző háromoldalú egyeztetésen azonban az Európai Parlament és a Tanács, az uniós társjogalkotók egyaránt megszüntették ezt az automatizmust, és egy további réteget vezettek be annak elkerülése érdekében, hogy a minimális kockázatot jelentő mesterséges intelligencia megoldások a szigorúbb rendszer hatálya alá kerüljenek. Október elején az uniós döntéshozók megvitattak egy kompromisszumos szöveget, amely három olyan szűrőfeltételt vezet be, amelyek teljesülése esetén a mesterséges intelligencia szolgáltatók úgy tekinthetik, hogy rendszerük mentesül a magas kockázatú kategóriából. A feltételek azokra az MI-rendszerekre vonatkoznak, amelyeket szűk körű eljárási feladatra, pusztán az emberi értékelés egy járulékos tényezőjének megerősítésére vagy javítására, illetve előkészítő feladat elvégzésére szánnak.

Néhány további biztosítékkal egészült ki a javaslat, nevezetesen azzal, hogy a profilalkotást végző mesterséges intelligenciamodellek továbbra is magas kockázatúnak minősülnek, és a nemzeti hatóságok továbbra is jogosultak a nem magas kockázatúként nyilvántartott rendszerek ellenőrzésére. A képviselők azonban jogi véleményt kértek az EU Parlament jogi szolgálatától, és e szerint ha a mesterséges intelligencia fejlesztőinek kell eldönteniük, hogy a rendszerük megfelel-e a szűrési feltételek valamelyikének, az nagyfokú szubjektivitást eredményez, és "nem tűnik kellően körülhatároltnak ahhoz, hogy az egyének egyértelműen megállapíthassák, milyen kötelezettségeik vannak".

A Parlament jogi hivatala szerint a mesterséges intelligencia szolgáltatóknak ilyen szintű autonómiát hagyva "ellentétben áll a mesterséges intelligenciáról szóló törvény általános céljával, amely a magas kockázatú mesterséges intelligencia rendszerek által okozott károk kockázatának kezelésére irányul". Ezt az ellentmondást jogbizonytalanságnak tekintik. Hasonlóképpen a vélemény szerint a szűrőrendszer ellentétes az egyenlő bánásmód elvével, mivel olyan helyzetekhez vezethet, amikor a magas kockázatú modelleket nem magas kockázatúként kezelik, és fordítva, valamint az arányosság elvével.

A jogi szakértők két feltételt szabtak ahhoz, hogy a megközelítés jogilag megalapozott legyen. Először is, a mentességi feltételeknek kellően pontosnak kell lenniük ahhoz, hogy ne hagyjanak hibalehetőséget a mesterséges intelligenciamodellek besorolása során. Másodszor, a jogalkotónak kell megítélnie, hogy egy mesterséges intelligencia alkalmazás magas kockázatot jelent-e vagy sem. Más szóval, az összes felhasználási esetre vonatkozó mentességi feltételek helyett az uniós döntéshozóknak eseti megközelítést kell alkalmazniuk, és meg kell határozniuk, hogy egy adott kritikus területen a mesterséges intelligencia megoldások milyen feltételek mellett nem jelentenek jelentős kockázatot.

A mostani tervezet szerint a Bizottság csak akkor vehet majd fel új szűrőket, ha konkrét és megbízható bizonyítékok állnak rendelkezésre arra vonatkozóan, hogy a mesterséges intelligencia rendszerek a magas kockázatú kategóriába tartoznak, és nem jelentenek jelentős kockázatot az emberekre nézve. Ezzel szemben az uniós végrehajtó hatalom csak akkor törölheti majd a kritériumokat, ha ez szükséges ahhoz, hogy az EU-ban megmaradjon az azonos szintű védelem.

A ChatGPT, az OpenAI GPT-3.5 és GPT-4 modelljein alapuló chatbot tavaly őszi berobbanása megzavarta az MI-törvényről szóló tárgyalásokat, és arra kényszerítette a döntéshozókat, hogy kitalálják, hogyan kezeljék ezeket a nagy teljesítményű modelleket. A megközelítés több szintre épül. Az elképzelés szerint minden alapmodellre horizontális kötelezettségek vonatkoznak, nevezetesen az átláthatóság és a gazdasági szereplők támogatása a mesterséges intelligenciáról szóló rendeletnek való megfelelés érdekében.

Úgy tűnik, hogy a többszintű megközelítés széles körű támogatást élvez, de a fő kérdés az, hogy miként határozzák meg a "nagyon alkalmas" alapmodellek - például a GPT-4 - legfelső szintjét, amelyre előzetes ellenőrzés és kockázatcsökkentő intézkedések vonatkoznak majd. A terminológia a "nagy hatású" modellekre változhat, hogy kiemeljék, hogy a hangsúlyt az ilyen modellek által jelentett rendszerszintű kockázatokra helyezik. Az általános megállapodás szerint több olyan kritériumot kell kidolgozni, amelyek alapján egy alapmodell "nagy hatásúnak" minősülhet.

A felmerült lehetséges kritériumok a számítási teljesítményre, a képzési adatok mennyiségére és a mesterséges intelligencia szolgáltatók gazdasági erőforrásaira vonatkoznak, de az aggályok leginkább azzal kapcsolatosak, hogy hogyan lehet ezt a megközelítést jövőállóvá tenni egy olyan piacon, amely nyaktörő sebességgel változik.

Vezető egyetemek kutatói is részt vesznek a tanácsadásban, az elkövetkező napokban az uniós tárgyalófelek várhatóan új tervezeteket dolgoznak ki, amelyek feketén-fehéren ábrázolják ezt a megközelítést. Az irányítás tekintetében egyre nagyobb az egyetértés abban, hogy a digitális szolgáltatásokról szóló törvényhez hasonlóan a rendszerkockázatot jelentő mesterséges intelligenciamodellek tanúsítását központosítani kell. Ez lesz az egyik fő feladata az MI Hivatalnak, amely a Bizottság alá tartozik majd, de "funkcionális függetlenséggel" rendelkezik. Szintén a DSA-t követve a Bizottság javasolta, hogy az új személyzeti követelmények finanszírozására kezelési díjat vezessenek be.

Az európai parlamenti képviselők azonban szkeptikusak a díjjal kapcsolatban, és nem tartják alkalmazhatónak a DSA-val való párhuzamosságot, amely a szolgáltatásokra összpontosít - míg az MI törvény a termékbiztonsági jogszabályokat követi. De az uniós országok és az európai parlamenti képviselők leginkább abban nem értenek egyet, hogy mely MI-alkalmazásokat kell betiltani, és milyen kivételeket kell a bűnüldöző szervekre hagyni. Ez a vita még elmérgesedhet, mivel mindkét intézmény rendkívül merev álláspontot képvisel. A legutóbbi háromoldalú egyeztetésen csak az derült ki egyértelműen, hogy a tárgyaló felek különböző szempontokat vizsgálnak, hogy egy olyan csomagot alkossanak, amely a tiltásokat, a bűnüldözési kivételeket, az alapjogi hatásvizsgálatot és a környezetvédelmi rendelkezéseket foglalja össze.

Kedd este (október 24-én) kezdődött meg az EU Tanácsa, a Parlament és a Bizottság magas szintű ülése és egészen szerda hajnalig elhúzódott, de az intézményközi tárgyalások - avagy trilógus, ahogy az uniós szakzsargonban nevezik - eredménye felemás. Az uniós döntéshozók megállapodtak a magas kockázatú mesterséges intelligencia-alkalmazások osztályozására vonatkozó rendelkezésekről, és általános iránymutatást adtak a nagy teljesítményű alapmodellek kezeléséről; arról, hogy kinek kell felügyelnie azokat, de alig karcolták a felszínt a tilalmakra és a jogérvényesítésre vonatkozó részt tekintve.

Most minden szem a következő, december 6-i háromoldalú egyeztetésre szegeződik, ahol politikai megállapodás várható, de az eredmény itt sem garantált. Addig is kilenc technikai ülést terveztek be, hogy a mesterséges intelligenciáról szóló törvény néhány legösszetettebb és legkövetkezetesebb aspektusának szövegét rögzítsék.

Az európai MI-törvény kockázatalapú megközelítést követ, amelynek értelmében azoknak az MI-modelleknek, amelyek jelentős kockázatot jelenthetnek az emberek egészségére, biztonságára és alapvető jogaira, szigorú kötelezettségeknek kell megfelelniük, például a kockázatkezelés és az adatkezelés terén. Az eredeti javaslatban minden olyan mesterséges intelligencia-megoldást, amely a kritikus felhasználási esetek előre meghatározott listájába tartozik, magas kockázatúnak minősítettek. Ezen a listán van például a foglalkoztatás és a migráció ellenőrzése, például a cégeknél a felvételről és előléptetésekről, jutalmakról döntő személyzeti algoritmusok.

Az EU készülő MI törvénye be fogja tiltani a tömeges megfigyelést, tanúsítást követel majd meg a kritikus területeken, míg átláthatóságot a korlátozott kockázatú rendszereknél

Az október 2-án tartott előző háromoldalú egyeztetésen azonban az Európai Parlament és a Tanács, az uniós társjogalkotók egyaránt megszüntették ezt az automatizmust, és egy további réteget vezettek be annak elkerülése érdekében, hogy a minimális kockázatot jelentő mesterséges intelligencia megoldások a szigorúbb rendszer hatálya alá kerüljenek. Október elején az uniós döntéshozók megvitattak egy kompromisszumos szöveget, amely három olyan szűrőfeltételt vezet be, amelyek teljesülése esetén a mesterséges intelligencia szolgáltatók úgy tekinthetik, hogy rendszerük mentesül a magas kockázatú kategóriából. A feltételek azokra az MI-rendszerekre vonatkoznak, amelyeket szűk körű eljárási feladatra, pusztán az emberi értékelés egy járulékos tényezőjének megerősítésére vagy javítására, illetve előkészítő feladat elvégzésére szánnak.

Néhány további biztosítékkal egészült ki a javaslat, nevezetesen azzal, hogy a profilalkotást végző mesterséges intelligenciamodellek továbbra is magas kockázatúnak minősülnek, és a nemzeti hatóságok továbbra is jogosultak a nem magas kockázatúként nyilvántartott rendszerek ellenőrzésére. A képviselők azonban jogi véleményt kértek az EU Parlament jogi szolgálatától, és e szerint ha a mesterséges intelligencia fejlesztőinek kell eldönteniük, hogy a rendszerük megfelel-e a szűrési feltételek valamelyikének, az nagyfokú szubjektivitást eredményez, és "nem tűnik kellően körülhatároltnak ahhoz, hogy az egyének egyértelműen megállapíthassák, milyen kötelezettségeik vannak".

A Parlament jogi hivatala szerint a mesterséges intelligencia szolgáltatóknak ilyen szintű autonómiát hagyva "ellentétben áll a mesterséges intelligenciáról szóló törvény általános céljával, amely a magas kockázatú mesterséges intelligencia rendszerek által okozott károk kockázatának kezelésére irányul". Ezt az ellentmondást jogbizonytalanságnak tekintik. Hasonlóképpen a vélemény szerint a szűrőrendszer ellentétes az egyenlő bánásmód elvével, mivel olyan helyzetekhez vezethet, amikor a magas kockázatú modelleket nem magas kockázatúként kezelik, és fordítva, valamint az arányosság elvével.

A jogi szakértők két feltételt szabtak ahhoz, hogy a megközelítés jogilag megalapozott legyen. Először is, a mentességi feltételeknek kellően pontosnak kell lenniük ahhoz, hogy ne hagyjanak hibalehetőséget a mesterséges intelligenciamodellek besorolása során. Másodszor, a jogalkotónak kell megítélnie, hogy egy mesterséges intelligencia alkalmazás magas kockázatot jelent-e vagy sem. Más szóval, az összes felhasználási esetre vonatkozó mentességi feltételek helyett az uniós döntéshozóknak eseti megközelítést kell alkalmazniuk, és meg kell határozniuk, hogy egy adott kritikus területen a mesterséges intelligencia megoldások milyen feltételek mellett nem jelentenek jelentős kockázatot.

A mostani tervezet szerint a Bizottság csak akkor vehet majd fel új szűrőket, ha konkrét és megbízható bizonyítékok állnak rendelkezésre arra vonatkozóan, hogy a mesterséges intelligencia rendszerek a magas kockázatú kategóriába tartoznak, és nem jelentenek jelentős kockázatot az emberekre nézve. Ezzel szemben az uniós végrehajtó hatalom csak akkor törölheti majd a kritériumokat, ha ez szükséges ahhoz, hogy az EU-ban megmaradjon az azonos szintű védelem.

A ChatGPT, az OpenAI GPT-3.5 és GPT-4 modelljein alapuló chatbot tavaly őszi berobbanása megzavarta az MI-törvényről szóló tárgyalásokat, és arra kényszerítette a döntéshozókat, hogy kitalálják, hogyan kezeljék ezeket a nagy teljesítményű modelleket. A megközelítés több szintre épül. Az elképzelés szerint minden alapmodellre horizontális kötelezettségek vonatkoznak, nevezetesen az átláthatóság és a gazdasági szereplők támogatása a mesterséges intelligenciáról szóló rendeletnek való megfelelés érdekében.

Úgy tűnik, hogy a többszintű megközelítés széles körű támogatást élvez, de a fő kérdés az, hogy miként határozzák meg a "nagyon alkalmas" alapmodellek - például a GPT-4 - legfelső szintjét, amelyre előzetes ellenőrzés és kockázatcsökkentő intézkedések vonatkoznak majd. A terminológia a "nagy hatású" modellekre változhat, hogy kiemeljék, hogy a hangsúlyt az ilyen modellek által jelentett rendszerszintű kockázatokra helyezik. Az általános megállapodás szerint több olyan kritériumot kell kidolgozni, amelyek alapján egy alapmodell "nagy hatásúnak" minősülhet.

A felmerült lehetséges kritériumok a számítási teljesítményre, a képzési adatok mennyiségére és a mesterséges intelligencia szolgáltatók gazdasági erőforrásaira vonatkoznak, de az aggályok leginkább azzal kapcsolatosak, hogy hogyan lehet ezt a megközelítést jövőállóvá tenni egy olyan piacon, amely nyaktörő sebességgel változik.

Vezető egyetemek kutatói is részt vesznek a tanácsadásban, az elkövetkező napokban az uniós tárgyalófelek várhatóan új tervezeteket dolgoznak ki, amelyek feketén-fehéren ábrázolják ezt a megközelítést. Az irányítás tekintetében egyre nagyobb az egyetértés abban, hogy a digitális szolgáltatásokról szóló törvényhez hasonlóan a rendszerkockázatot jelentő mesterséges intelligenciamodellek tanúsítását központosítani kell. Ez lesz az egyik fő feladata az MI Hivatalnak, amely a Bizottság alá tartozik majd, de "funkcionális függetlenséggel" rendelkezik. Szintén a DSA-t követve a Bizottság javasolta, hogy az új személyzeti követelmények finanszírozására kezelési díjat vezessenek be.

Az európai parlamenti képviselők azonban szkeptikusak a díjjal kapcsolatban, és nem tartják alkalmazhatónak a DSA-val való párhuzamosságot, amely a szolgáltatásokra összpontosít - míg az MI törvény a termékbiztonsági jogszabályokat követi. De az uniós országok és az európai parlamenti képviselők leginkább abban nem értenek egyet, hogy mely MI-alkalmazásokat kell betiltani, és milyen kivételeket kell a bűnüldöző szervekre hagyni. Ez a vita még elmérgesedhet, mivel mindkét intézmény rendkívül merev álláspontot képvisel. A legutóbbi háromoldalú egyeztetésen csak az derült ki egyértelműen, hogy a tárgyaló felek különböző szempontokat vizsgálnak, hogy egy olyan csomagot alkossanak, amely a tiltásokat, a bűnüldözési kivételeket, az alapjogi hatásvizsgálatot és a környezetvédelmi rendelkezéseket foglalja össze.