SG.hu·

A mesterséges intelligencia esete a gorillákkal

Sem a Google, sem az Apple fotós alkalmazása nem meri megjelölni a képeken a gorillákat. Nyolc évvel azután, hogy a képelemző szoftverek tévesen jelöltek meg színesbőrű embereket a technológiai óriások a számítógépes látás terén elért nagy előrelépések ellenére még mindig attól tartanak, hogy a hiba megismétlődik.

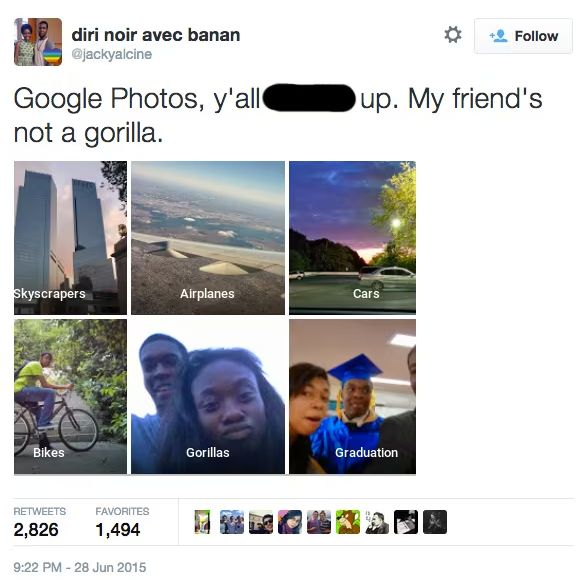

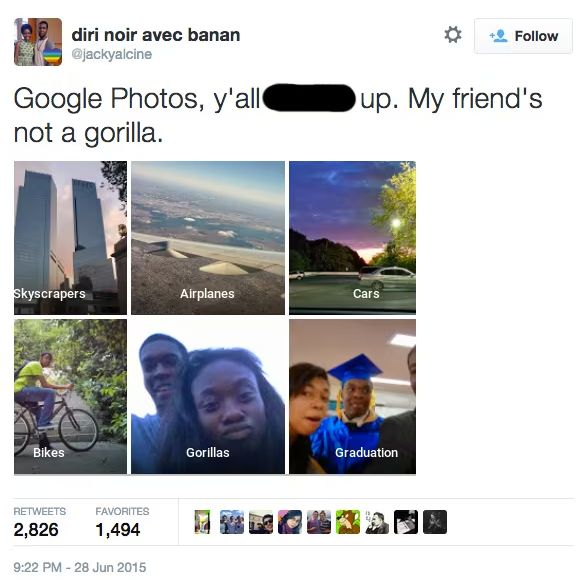

Amikor a Google 2015 májusában kiadta a Fotók alkalmazást az embereket lenyűgözte, hogy mire képes: elemzi a képeket, hogy felcímkézze a rajtuk szereplő embereket, helyeket és dolgokat, ami akkoriban meghökkentő bejelentés volt. Néhány hónappal a megjelenés után azonban egy szoftverfejlesztő, Jacky Alciné felfedezte, hogy a Google "gorilláknak" címkézte a róla és egy barátjáról készült fotókat. Mindketten feketék, és ez számukra különösen sértő, hiszen évszázados rasszista toposzokat idéz fel.

A hiba egyértelműen nem rasszista indíttatású volt, hanem a tréningezésre használt adatbázisból következett. A Google két volt alkalmazottja, akik ezen a technológián dolgoztak, azt mondta, hogy a vállalat nem tett elég színesbőrűről készített fotót abba a képgyűjteménybe, amelyet a rendszer betanításához használt. Ennek következtében a technológia nem ismerte eléggé a sötétebb bőrű embereket, és összetévesztette őket a gorillákkal. Az ezt követő botrány miatt a Google letiltotta, hogy szoftvere bármit is gorillának minősítsen, és megfogadta, hogy orvosolja a problémát. Nyolc év telt el azóta és a mesterséges intelligencia rengeteget fejlődött, de ezen a téren látványos a kudarc.

Az Apple, a Google, az Amazon és a Microsoft által készített fotóalkalmazások gépi tanulásra támaszkodnak, hogy lehetővé tegyék számunkra, hogy az egyre nagyobb méretű fotógyűjteményeinkben bizonyos elemek után kutassunk és megtaláljunk konkrét dolgokat. A New York Times riportere 8000 kép között 44 állatkerti fotót rejtett el, és tesztje szerint a helyzet továbbra is siralmas: a gyűjteményben macskákra és kengurukra keresve remek eredményeket kapott, de a Google Photos egyetlen gorillát sem talált. A keresést kibővítve páviánokra, csimpánzokra, orangutánokra és majmokra hasonlóan lyukra futott, annak ellenére, hogy a gyűjteményben mindegyik főemlősről volt kép.

Tesztje alapján az Apple Photos ugyanezzel a problémával küzd: pontosan meg tudta találni az egyes állatokról készült fotókat, kivéve a főemlősöket. A Microsoft OneDrive fényképkeresője minden állat esetében eredménytelen volt. Az Amazon Photos gorillára keresve egy főemlősökből álló gyűjteményt mutatott, és ezt a mintát megismételte más állatok esetében is. A főemlősök családjának egy tagját, a makikat a Google és az Apple is felismerte. Mindkét szoftver nagyon fejlett képelemzés terén, mégis, mindkét cég a biztonság mellett döntött, amikor kikapcsolta a főemlősök vizuális keresésének lehetőségét.

A fogyasztóknak nyilván ez nem túl fontos téma, a probléma azonban szélesebb körű kérdéseket vet fel a vizuális képeket értelmező technológiára támaszkodó szolgáltatásokat tekintve, valamint az egyéb, mesterséges intelligencia által működtetett termékekben rejlő egyéb, nem javított vagy nem javítható hibákkal kapcsolatban. Számítógépes látást alkalmazó kamerákkal védjük ingatlanainkat, és a szolgáltatás olyan kritikus feladatoknál is használatban van, mint az autók navigálása vagy elkövetők megtalálása egy rendőrségi adatbázisban. Ahogy a mesterséges intelligencia egyre jobban beépül az életünkbe, úgy nőnek a nem szándékos következmények miatti félelmek. Bár a gépi tanulást használó termékek és az olyan mesterséges intelligencia chatbotok, mint a ChatGPT alapvetően különböznek egymástól, mindkettő a betanításukra használt adathalmazoktól függ, és mindkettő hibázhat az adatokban lévő hibák vagy a kódba beépített elfogultságok miatt.

Az Apple Watch karóra oxigénszint-mérési kudarca miatti per még tart

Látványos hiba volt, amikor nem sokkal indulás után a Microsoft korlátozta a Bingbe épített chatrobot hozzáférhetőségét, miután az fura irányba vezette a beszélgetéseket. Ugyanígy a Google azon döntése, hogy algoritmusában letiltja a gorillák azonosítását egy általános iparági megközelítést illusztrál: a hibásan működő technológiai funkciókat javítás helyett inkább elzárják. De így hogyan lehetne megbízni ezekben a szoftverekben? Michael Marconi, a Google szóvivője elmondta, hogy úgy értékelték, hogy az előny "nem ellensúlyozza a kár kockázatát". Az Apple nem kívánta kommentálni, hogy a felhasználók nem tudnak főemlősre keresni az alkalmazásában.

A Google számtalanszor bocsánatot kért a gorillás incidensért, de ez csak egyike volt a technológiai iparágban előforduló számos hasonló epizódnak. További kritizált termékek közé tartoznak a HP arckövető webkamerái, amelyek nem tudták felismerni a sötét bőrű embereket, valamint az Apple Watch karóra, amely nem tudta pontosan leolvasni a vér oxigénszintjét nem fehér embereken. A hibák azt sugallják, hogy az elektronikai eszközöket nem sötétebb bőrű emberek számára és részvételével tervezik. A Google otthoni biztonsági kamerája, a Nest vásárlói hasonló hibákat jeleztek: 2021-ben egy vásárló arról kapott riasztást, hogy az édesanyja csenget, de helyette az anyósát találta az ajtó túloldalán. Amikor a felhasználók arra panaszkodtak, hogy a rendszer összekeveri az általuk "ismerősnek" megjelölt arcokat, a fórumon az ügyfélszolgálat egyik képviselője azt tanácsolta nekik, hogy töröljék az összes címkét, és kezdjék elölről.

A HP arckövetésre képes webkamerájának esete ma már mintapélda

2019-ben a Google megpróbálta javítani az androidos okostelefonok arcfelismerő funkcióját, és növelte a sötét bőrű emberek számát az adathalmazban. De a vállalkozók, akiket a Google felkért a portrék elkészítésére aggasztó módszerrel kompenzálták az adatok sokszínűségének hiányát: hajléktalanokat és diákokat kerestek meg. A Google vezetői "nagyon nyugtalanítónak" nevezték az esetet. Tehát ugyan a színfalak mögött dolgoztak a technológia javításán, de a felhasználóknak soha nem engedték meg, hogy ezeket az erőfeszítéseket megítéljék.

A Google azóta kiadott egy jobb képelemző terméket, a Google Lens-t, amivel fotókkal lehet keresni a weben. A Wired 2018-ban fedezte fel, hogy az eszköz szintén képtelen volt azonosítani egy gorillát. A Lensnek egy kutyáról készült fotót megmutatva még a fajtát is megtippeli, de a gorillánál, csimpánznál, páviánnál vagy egy orángutánnál a Lens láthatóan megakad. Nem hajlandó megjelölni, hogy mi van a képen, és csak "vizuális egyezéseket" - az eredeti képhez hasonlónak ítélt fotókat - hoz felszínre. A gorillák esetében más gorillák fotóit mutatja, ami arra utal, hogy a technológia felismeri az állatot, de a vállalat fél a címkézéstől. Ezek a rendszerek sosem bolondbiztosak, és mivel több milliárd ember használja a Google szolgáltatásait, még az olyan ritka hibák is felszínre kerülnek, amelyek az egymilliárd felhasználóból csak egy emberrel fordulnak elő. Elég egyetlen hiba ahhoz, hogy hatalmas társadalmi következményei legyenek. A Google és az Apple most már képes lehet megkülönböztetni a főemlősöket az emberektől, de nem akarják engedélyezni a funkciót, tekintettel a lehetséges reputációs kockázatra, ha az ismét félresikerül.

Amikor a Google 2015 májusában kiadta a Fotók alkalmazást az embereket lenyűgözte, hogy mire képes: elemzi a képeket, hogy felcímkézze a rajtuk szereplő embereket, helyeket és dolgokat, ami akkoriban meghökkentő bejelentés volt. Néhány hónappal a megjelenés után azonban egy szoftverfejlesztő, Jacky Alciné felfedezte, hogy a Google "gorilláknak" címkézte a róla és egy barátjáról készült fotókat. Mindketten feketék, és ez számukra különösen sértő, hiszen évszázados rasszista toposzokat idéz fel.

A hiba egyértelműen nem rasszista indíttatású volt, hanem a tréningezésre használt adatbázisból következett. A Google két volt alkalmazottja, akik ezen a technológián dolgoztak, azt mondta, hogy a vállalat nem tett elég színesbőrűről készített fotót abba a képgyűjteménybe, amelyet a rendszer betanításához használt. Ennek következtében a technológia nem ismerte eléggé a sötétebb bőrű embereket, és összetévesztette őket a gorillákkal. Az ezt követő botrány miatt a Google letiltotta, hogy szoftvere bármit is gorillának minősítsen, és megfogadta, hogy orvosolja a problémát. Nyolc év telt el azóta és a mesterséges intelligencia rengeteget fejlődött, de ezen a téren látványos a kudarc.

Az Apple, a Google, az Amazon és a Microsoft által készített fotóalkalmazások gépi tanulásra támaszkodnak, hogy lehetővé tegyék számunkra, hogy az egyre nagyobb méretű fotógyűjteményeinkben bizonyos elemek után kutassunk és megtaláljunk konkrét dolgokat. A New York Times riportere 8000 kép között 44 állatkerti fotót rejtett el, és tesztje szerint a helyzet továbbra is siralmas: a gyűjteményben macskákra és kengurukra keresve remek eredményeket kapott, de a Google Photos egyetlen gorillát sem talált. A keresést kibővítve páviánokra, csimpánzokra, orangutánokra és majmokra hasonlóan lyukra futott, annak ellenére, hogy a gyűjteményben mindegyik főemlősről volt kép.

Tesztje alapján az Apple Photos ugyanezzel a problémával küzd: pontosan meg tudta találni az egyes állatokról készült fotókat, kivéve a főemlősöket. A Microsoft OneDrive fényképkeresője minden állat esetében eredménytelen volt. Az Amazon Photos gorillára keresve egy főemlősökből álló gyűjteményt mutatott, és ezt a mintát megismételte más állatok esetében is. A főemlősök családjának egy tagját, a makikat a Google és az Apple is felismerte. Mindkét szoftver nagyon fejlett képelemzés terén, mégis, mindkét cég a biztonság mellett döntött, amikor kikapcsolta a főemlősök vizuális keresésének lehetőségét.

A fogyasztóknak nyilván ez nem túl fontos téma, a probléma azonban szélesebb körű kérdéseket vet fel a vizuális képeket értelmező technológiára támaszkodó szolgáltatásokat tekintve, valamint az egyéb, mesterséges intelligencia által működtetett termékekben rejlő egyéb, nem javított vagy nem javítható hibákkal kapcsolatban. Számítógépes látást alkalmazó kamerákkal védjük ingatlanainkat, és a szolgáltatás olyan kritikus feladatoknál is használatban van, mint az autók navigálása vagy elkövetők megtalálása egy rendőrségi adatbázisban. Ahogy a mesterséges intelligencia egyre jobban beépül az életünkbe, úgy nőnek a nem szándékos következmények miatti félelmek. Bár a gépi tanulást használó termékek és az olyan mesterséges intelligencia chatbotok, mint a ChatGPT alapvetően különböznek egymástól, mindkettő a betanításukra használt adathalmazoktól függ, és mindkettő hibázhat az adatokban lévő hibák vagy a kódba beépített elfogultságok miatt.

Az Apple Watch karóra oxigénszint-mérési kudarca miatti per még tart

Látványos hiba volt, amikor nem sokkal indulás után a Microsoft korlátozta a Bingbe épített chatrobot hozzáférhetőségét, miután az fura irányba vezette a beszélgetéseket. Ugyanígy a Google azon döntése, hogy algoritmusában letiltja a gorillák azonosítását egy általános iparági megközelítést illusztrál: a hibásan működő technológiai funkciókat javítás helyett inkább elzárják. De így hogyan lehetne megbízni ezekben a szoftverekben? Michael Marconi, a Google szóvivője elmondta, hogy úgy értékelték, hogy az előny "nem ellensúlyozza a kár kockázatát". Az Apple nem kívánta kommentálni, hogy a felhasználók nem tudnak főemlősre keresni az alkalmazásában.

A Google számtalanszor bocsánatot kért a gorillás incidensért, de ez csak egyike volt a technológiai iparágban előforduló számos hasonló epizódnak. További kritizált termékek közé tartoznak a HP arckövető webkamerái, amelyek nem tudták felismerni a sötét bőrű embereket, valamint az Apple Watch karóra, amely nem tudta pontosan leolvasni a vér oxigénszintjét nem fehér embereken. A hibák azt sugallják, hogy az elektronikai eszközöket nem sötétebb bőrű emberek számára és részvételével tervezik. A Google otthoni biztonsági kamerája, a Nest vásárlói hasonló hibákat jeleztek: 2021-ben egy vásárló arról kapott riasztást, hogy az édesanyja csenget, de helyette az anyósát találta az ajtó túloldalán. Amikor a felhasználók arra panaszkodtak, hogy a rendszer összekeveri az általuk "ismerősnek" megjelölt arcokat, a fórumon az ügyfélszolgálat egyik képviselője azt tanácsolta nekik, hogy töröljék az összes címkét, és kezdjék elölről.

A HP arckövetésre képes webkamerájának esete ma már mintapélda

2019-ben a Google megpróbálta javítani az androidos okostelefonok arcfelismerő funkcióját, és növelte a sötét bőrű emberek számát az adathalmazban. De a vállalkozók, akiket a Google felkért a portrék elkészítésére aggasztó módszerrel kompenzálták az adatok sokszínűségének hiányát: hajléktalanokat és diákokat kerestek meg. A Google vezetői "nagyon nyugtalanítónak" nevezték az esetet. Tehát ugyan a színfalak mögött dolgoztak a technológia javításán, de a felhasználóknak soha nem engedték meg, hogy ezeket az erőfeszítéseket megítéljék.

A Google azóta kiadott egy jobb képelemző terméket, a Google Lens-t, amivel fotókkal lehet keresni a weben. A Wired 2018-ban fedezte fel, hogy az eszköz szintén képtelen volt azonosítani egy gorillát. A Lensnek egy kutyáról készült fotót megmutatva még a fajtát is megtippeli, de a gorillánál, csimpánznál, páviánnál vagy egy orángutánnál a Lens láthatóan megakad. Nem hajlandó megjelölni, hogy mi van a képen, és csak "vizuális egyezéseket" - az eredeti képhez hasonlónak ítélt fotókat - hoz felszínre. A gorillák esetében más gorillák fotóit mutatja, ami arra utal, hogy a technológia felismeri az állatot, de a vállalat fél a címkézéstől. Ezek a rendszerek sosem bolondbiztosak, és mivel több milliárd ember használja a Google szolgáltatásait, még az olyan ritka hibák is felszínre kerülnek, amelyek az egymilliárd felhasználóból csak egy emberrel fordulnak elő. Elég egyetlen hiba ahhoz, hogy hatalmas társadalmi következményei legyenek. A Google és az Apple most már képes lehet megkülönböztetni a főemlősöket az emberektől, de nem akarják engedélyezni a funkciót, tekintettel a lehetséges reputációs kockázatra, ha az ismét félresikerül.