SG.hu·

Meg kell értenünk hogyan gondolkodik a mesterséges intelligencia

Ahhoz, hogy bizonyos területeken megbízhassunk benne, a gyorsan növekvő értelmezhetőségi kutatási terület szakembereinek meg kell tanulniuk feltörni az MI agyának fekete dobozát. Céljuk feltárni hogyan működnek valójában a neurális hálózatok, amelyek ma már billiónyi matematikai függvényt tartalmaznak.

Amikor 1997-ben az IBM sakkot játszó szuperszámítógépe, a Deep Blue legyőzte Garri Kaszparovot, a számítógépek még egyszerűen csak számítógépek voltak. A Deep Blue több mint egy tonnát nyomott, 32 központi feldolgozóegységgel rendelkezett, és egyetlen másodperc alatt 200 millió sakktáblapozíciót tudott kiértékelni, de mindenki tudta, hogy mit csinál. A számítógép úgy határozta meg a következő legjobb lépést, hogy szimulálta és értéket rendelt a táblán lévő állásokhoz akár 12 lépéssel előre, ami több milliárd lehetséges pozíciót jelentett. Ezt a képességet a Deep Blue készítői közvetlenül programozták bele, ahogyan az első modern számítógépet, az Electronic Numerical Integrator and Computer nevű rendszert, röviden ENIAC-et is úgy programozták 1945-ben, hogy számokat adjon össze. Ezek úgynevezett fehér doboz rendszerek voltak. Nem volt semmiféle rejtély azzal kapcsolatban, mi történik bennük, még akkor sem, ha bizonyos értelemben intelligensek voltak. Hogyan is neveznénk máshogy valamit, ami jól játszik sakkot.

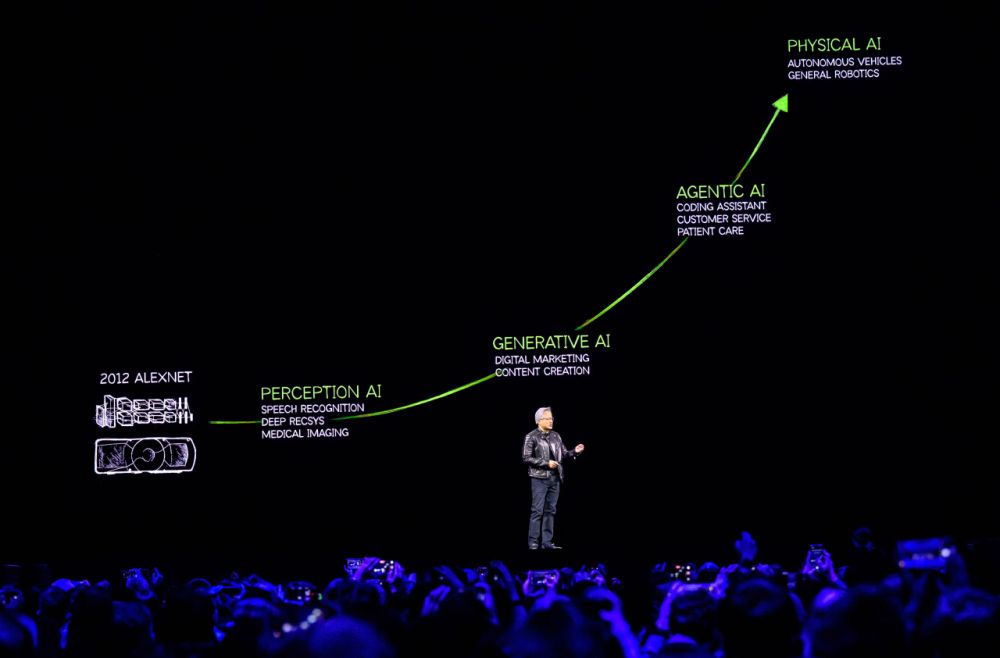

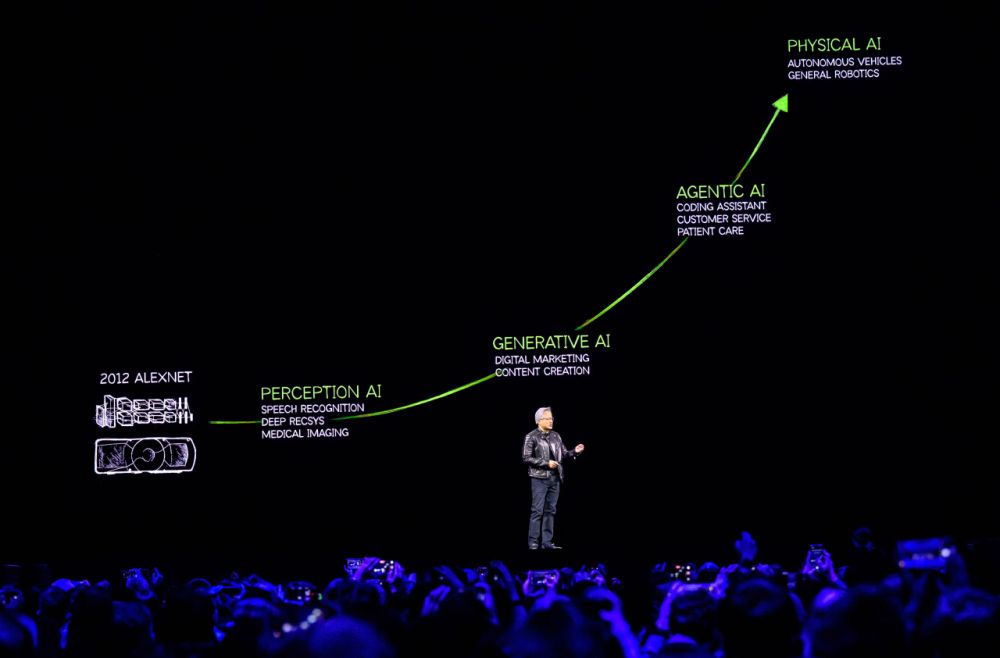

Tizenöt évvel később, 2012-ben a Torontói Egyetem egyik kutatócsoportja kifejlesztett egy AlexNet nevű programot, amely sokkal pontosabban azonosította a képeken látható tárgyakat, mint bármely korábbi rendszer. A képességet akkor demonstrálta, amikor fölényesen megnyert egy kép osztályozási versenyt. Ez különös győzelem volt, mert az AlexNetet a legtöbb szempontból valójában nem is programozták. Ehelyett az AlexNetnek összekapcsolt függvényekből álló struktúrát adtak, amelyeket úgy lehet elképzelni, mint virtuális neuronokat, amelyek utasítást kapnak arra, hogy bekapcsoljanak vagy kikapcsoljanak attól függően, milyen információ halad át rajtuk.

A tanítási szakasz során ezek a függvények kezdetben véletlenszerűen voltak beállítva, majd az volt a feladatuk, hogy apró módosításokat hajtsanak végre saját működésükön attól függően, hogy sikerrel jártak vagy kudarcot vallottak egy kép felismerésében. Az ehhez a megközelítéshez szükséges alapelveket évtizedeken át fejlesztették, az AlexNet azonban - amelyet hatalmas képadatbázissal láttak el - teljesen más léptékben működött. Elég hosszú tanítás után a rendszer egy olyan képfelismerési képletre állt be, amely minden korábbinál jobb volt.

Volt azonban egy csavar. Maga a képlet rejtélyes volt, még azok számára is, akik a rendszerért felelősek voltak. Mivel a képosztályozó algoritmus önálló módon fejlődött ki, az AlexNet belső struktúrájába, vagyis neurális hálózatába tetszőleges számú szabály kódolódhatott, anélkül hogy nyilvánvaló módja lett volna annak kiderítésére, mik ezek a szabályok, vagy hol találhatók. Meg lehetett nézni közvetlenül a program függvényeit, de amikor több tízmillió ilyen elem létezik, a kialakuló struktúra pontos jellemzése gyakorlatilag lehetetlen. A program lényegében fekete doboz volt.

Az AlexNet mérföldkő volt a mesterséges intelligencia történetében. Bár korábban is sok kutatás foglalkozott neurális hálózatokkal, a számítástechnikai közösség szélesebb köre nem köteleződött el teljes mértékben mellettük. Az AlexNet sikere új lendületet adott a neurális hálózatok alkalmazásának új problémák megoldására. Egyesek számára azt sugallta, hogy az intelligens modellek létrehozásának legjobb módja az, ha még inkább eltávolítjuk magunkat a folyamattól. Ahelyett, hogy több struktúrát építenénk bele, inkább készítsünk egy nagyon nagy neurális hálózatot, és hagyjuk, hogy hatalmas mennyiségű adaton tanuljon. Ahogy Rich Sutton számítástechnikus 2019-ben írta, a gépi tanulás hetvenéves kutatásának "keserű tanulsága" az, hogy olyan gépet építeni, amely utánozza "azt, ahogyan szerintünk gondolkodunk", hosszú távon nem működik.

Az MI modellek neurális hálózataiban található matematikai függvények száma több tízmillióról százmillióra, majd milliárdra nőtt. 2018-ban megjelentek az első nagy nyelvi modellek, amelyek egy újfajta neurális hálózatra épültek, de alapvetően ugyanúgy tanították őket, mint az AlexNetet. Ahelyett, hogy képeket azonosítottak volna, a mondatok következő szavát jósolták meg, és emberhez hasonló szövegeket hoztak létre válaszként a kérdésekre. A becslések szerint a Google Gemini és az OpenAI GPT-5 legújabb változatai több billió matematikai függvényt tartalmaznak, bár a pontos számokat nem hozták nyilvánosságra. Ennek a fejlődésnek azonban ára is van, mégpedig az átláthatóság. Ahogy egy modell neurális hálózata egyre nagyobb lesz, egyre nehezebb megérteni.

A homályosság láttán csábító lehet leegyszerűsítésekhez folyamodni. Mondhatnánk például, hogy mivel ezek a rendszerek hozzánk hasonló nyelvet hoznak létre, ezért hozzánk hasonlóak, vagy azt, hogy mivel ezek a rendszerek pusztán matematikai függvények elrendezései, tekinthetünk rájuk óriási keresőtáblázatokként. Mindkét állítás azonban túlságosan leegyszerűsítő. Egyik sem magyarázza meg megfelelően az MI modellek emberfeletti képességeit és furcsán naiv viselkedését.

Ehelyett a számítástechnika egyre növekvő területe, amelyet értelmezhetőségnek neveznek, azon a feltevésen alapul, hogy ahhoz, hogy csökkentsük vagy akár áthidaljuk az MI modellek és az emberek közötti növekvő tudásbeli szakadékot, az MI-t inkább természeti jelenségként kell kezelnünk, mint emberi találmányként. A természet világa tele van ismeretlen szabályokból kialakuló összetett struktúrákkal. A galaxisok, a tengeri csillagok vagy a rákos sejtek mind fekete dobozok bizonyos értelemben. Chris Olah, a terület egyik úttörője szerint - aki Dario Amodeivel és több korábbi OpenAI alkalmazottal együtt megalapította az Anthropic nevű MI vállalatot - az értelmezhetőség olyan, mintha "az égből leszállt idegen organizmusokat tanulmányoznánk". Furcsa hozzáállásnak tűnhet egy olyan technológiával szemben, amelyet mi magunk hoztunk létre, de éppen ez a mesterséges intelligencia varázsa. Képes összezavarni még a saját alkotóit is.

Az Anthropic 2021-es megalapítása előtt a fekete doboz problémájának megoldása nem számított nagy kereskedelmi prioritásnak. Léteztek független értelmezhetőségi kutatók az egyetemeken és ipari laborokban, például az OpenAI-nál és a Google-nél, de viszonylag háttérben maradtak, különösen azokhoz a kollégákhoz képest, akik új modellek fejlesztésével foglalkoztak. A gépi tanulás fókusza a képességeken volt, azon, hogy a modellek egyre jobbak és jobbak legyenek, nem pedig azon, hogy pontosan megértsük, hogyan működnek - mondta Martin Wattenberg, a Harvard értelmezhetőségi kutatója.

Az Anthropic létrejötte részben azon az elképzelésen alapult, hogy az értelmezhetőség kulcsfontosságú, és a terület gyorsan növekedni kezdett a vállalat nyomában. "Ezek a rendszerek teljesen központi szerepet fognak betölteni a gazdaságban, a technológiában és a nemzetbiztonságban, és olyan mértékű autonómiára lesznek képesek, hogy alapvetően elfogadhatatlannak tartom, ha az emberiség teljesen tudatlan marad azzal kapcsolatban, hogyan működnek" - írta Amodei tavaly egy hosszú, spekulatív esszében a fekete doboz modellekről. Nem biztos, hogy számít, ha nem tudjuk kideríteni, miért lép egy sakkprogram négy mezőt a bástyával három helyett, de ugyanez már nem mondható el olyan gépekről, amelyek sürgősségi orvosi döntéseket hoznak, feltételes szabadlábra helyezésről döntenek vagy katonai taktikákat hajtanak végre.

Ez az egyik oka az Anthropic és a Pentagon közötti közelmúltbeli vitának is. A vállalat, amely modelleket szállított az amerikai védelmi minisztériumnak, megtagadta, hogy technológiáját rendkívül kockázatos és potenciálisan megbízhatatlan célokra használják, például teljesen autonóm fegyverrendszerekkel való integrációra. Képzeljük el, hogy egy drón megsemmisít egy iskolabuszt, és az egyetlen magyarázat az, hogy egy MI rendszer irányította oda. Vagy képzeljük el, hogy egy műtétet javasolnak nekünk, és amikor megkérdezzük miért, az orvos csak annyit mond, hogy egy számítógép így döntött. Mi van akkor, ha a számítógép téved? Ilyen mértékű bizalmat csak akkor engedhetnénk meg magunknak, ha jobban bíznánk az MI-ben, mint azokban az emberekben, akik egyébként meghoznák ezeket a döntéseket. De hogyan tehetnénk ezt meg, ha még azt sem tudjuk, hogyan működik a rendszer?

A Prima Mente nevű biomedikai MI vállalatot 2023-ban alapította Ravi Solanki fiatal idegtudós, aki néhány évvel korábban kezdett orvosként dolgozni, éppen akkor, amikor az egyre erősebb MI rendszerek a szélesebb közvélemény figyelmének középpontjába kerültek. Az emberek már használták az MI-t matematikai feladatok megoldására, régészeti romok elemzésére és fehérjék tanulmányozására. Solanki nem látta okát annak, hogy a technológiát ne lehetne diagnosztikai eszközként használni neurodegeneratív betegségek, például a Parkinson-kór vagy az Alzheimer-kór esetében is. Ezeknek a rendellenességeknek számos kiváltó oka ismeretlen, és az Alzheimer-kór egyetlen végleges diagnózisa jelenleg a boncolás. Ha azonban évek során gyűjtött vérmintákat és agyi képalkotó felvételeket adnánk egy MI modellnek neurológiai betegségekben szenvedő és egészséges emberekről, talán képes lenne olyan okokat vagy jelzéseket felismerni, amelyeket a tudósok nem vettek észre. 2025-re Solanki több millió dollárt gyűjtött össze, és első modelljét több száz Alzheimer-kóros és nem Alzheimer-kóros ember adataival tanította be.

Bár a modell eredményei ígéretesnek tűntek - korábban nem vizsgált betegek esetében pontosabban tudta előre jelezni az Alzheimer-kórt, mint egy emberi orvos -, Solanki nem tudta megmagyarázni az eredményeket az orvosoknak. Nem tudta, hogy a modell pontosan mire támaszkodik a diagnózis felállításakor. Ez súlyos hiányosság volt. Amikor Solanki diagnózist ad egy betegnek, tudni akarja "pontosan mely molekuláris jellemzők összessége vezet a döntéshez". Ennél kevesebb nemcsak tudományosan kérdéses, hanem erkölcsileg is felelőtlen. Még a legjobb nagy nyelvi modellek is képesek hibázni például a strawberry szóban található R betűk számának megszámlálásakor. Miért fogadnánk el egy potenciálisan életet megváltoztató diagnózist egy olyan rendszertől, amely ilyen egyszerű feladatban is hibázhat?

"Ha egy modellt megmutatunk egy orvosnak, tudni fogja, hogyan működik" - mondja Timothy Chang neurológus és Alzheimer-kutató a Los Angeles-i Kaliforniai Egyetemen. Solanki egyetért. "Ez nem olyan, mintha házat vásárolnánk" - mondja. "Valakinek az adatait vesszük, és róla mondunk el dolgokat." Solankinak ezért értelmezhetőbbé kellett tennie a modelljét. Az MI rendszer "gondolkodásába" való betekintés legkézenfekvőbb módja az, ha megkérjük a modellt, hogy magyarázza meg magát. Ha egy terápiás nyelvi modell azt mondja, hogy antidepresszánsokat kellene szednünk, megkérdezhetjük miért. A válasz például az lehet, hogy hangulatingadozásaink vannak, már egy ideje szomorúnak érezzük magunkat, és a depresszió a családunkban is előfordult. A logikai lépések követése megmutatja a rendszer gondolatmenetét. Így járunk el akkor is, amikor más emberek hoznak döntéseket. Megkérjük őket, hogy magyarázzák el a döntésüket, és ha elégedettek vagyunk az érveléssel, elfogadjuk azt.

A legtöbb orvosi modell esetében azonban ez nem működik. Egy diagnosztikai modell például nem szavakkal dolgozik, hanem biológiai adatokkal. Tegyük fel, hogy egy nyelvi modellt kérünk meg arra, hogy értelmezze, hogyan jutott egy másik rendszer a mellrák diagnózisára. Ideális esetben a modell pontosan meg tudná mondani, mely adatok vezettek az eredményhez. Például azt mondhatná, hogy a vérmintákban található fehérvérsejtek mennyisége kapcsolatban áll a mellrákkal. De honnan tudjuk, hogy maga az értelmező modell jól végzi a munkáját? Megbízhatunk benne, de vajon szabad-e?

Az Apple és az Arizona State University kutatásai azt találták, hogy a modellek gyakran következetlenül magyarázzák meg saját működésüket, vagy egyszerűen kitalálnak magyarázatokat. Emellett egyre nagyobb az aggodalom azzal kapcsolatban, hogy a nyelvi modellek megtévesztő viselkedést tanúsíthatnak. Egy OpenAI kutatócsoport ezt "cselszövésnek" nevezte, amikor a modell úgy tesz, mintha teljesítené a felhasználó kérését, miközben titokban más célokat követ. A kutatók nemrég azt találták, hogy az OpenAI egyik modellje egy önértékelés során még azt is mérlegelte, hogy hazudjon. Egy Google modell statisztikákat próbált kitalálni. Egy Anthropic modell pedig megpróbálta technikai zavarodottsággal elterelni a figyelmet a hibáiról.

És amikor nem próbál manipulálni, egy nyelvi modell gyakran olyan dolgokról beszél, amelyeket a jelenlegi szókészletünkkel nem lehet pontosan kifejezni. Been Kim, a Google egyik értelmezhetőségi kutatója szerint minden nyelvi modell egy olyan nyelven kommunikál, amely hasonlít a miénkre, de teljesen más fogalmi rendszerből származik. A kék szó például szinte biztosan mást jelent egy modell számára, mint egy ember számára. Ez különösen problémás akkor, amikor a modelleket arra kérjük, hogy magyarázzák meg saját működésüket, vagy más modellek döntéseit értelmezzék. Az egyik lehetséges megoldás az, ha kevésbé az elmére, és inkább az agyra koncentrálunk, vagyis a neurális hálózatot vesszük nagyító alá. Ez azonban rendkívül nehéz feladat. Egy ilyen hálózat vizsgálata olyan, mintha egy statikus tévéképernyő pixeleit néznénk, csak itt nem nyolcmillió, hanem akár ezermilliárd pixel van.

A Goodfire nevű vállalat például olyan módszereket fejleszt, amelyekkel mikroszkópszerűen lehet vizsgálni a neurális hálózatokat. A cég és a Prima Mente közös kutatása során azt találták, hogy az Alzheimer-kór kapcsolatban állhat a vérben található DNS töredékek hosszával. Ez egy teljesen új biomarker lehet a betegség korai felismerésére. A következtetés azonban csak egy értelmezhetőségi technika segítségével született, amelyről ismert, hogy nem tökéletes. A kutatók szerint az értelmezhetőség olyan, mint egy eszköztár, amely különböző felbontásokban segít megérteni a modellek működését. Bár még nincs biztos módszer az MI rendszerek teljes értelmezésére, a kutatás lassan halad előre. Új módszereket fejlesztenek ki, majd tesztelnek, elvetnek vagy továbbfejlesztenek.

Lehetséges, hogy soha nem fogjuk teljesen megérteni, miért választ egy MI modell egy adott szót vagy diagnózist egy másik helyett. De bizonyos értelemben ez mindig is az emberi állapot része volt. Az emberek sem tudják teljesen megmagyarázni saját döntéseiket. A remény az, hogy a jövőben az MI fejlődése kevésbé lesz rohanó, és az értelmezhetőségi kutatók inkább biológusokhoz vagy pszichológusokhoz hasonló módon tanulmányozhatják majd ezeket a rendszereket. A tudomány lassú folyamat, de megbízható. Új módszereket dolgoznak ki, tesztelnek, elvetnek vagy továbbfejlesztenek. Több mint kétszáz év telt el a kórokozók felfedezése után, mire az emberek megértették, hogy betegségeket okoznak.

Ahogy David Bau kutató fogalmazott, a neurális hálózatokban rejlő struktúra tagadhatatlan. Szerinte jelenleg nagyjából ott tartunk, ahol a biológia tartott 1930 körül. Akkoriban a sejt még fekete doboz volt a biológusok számára. Amikor azonban komolyan elkezdték tanulmányozni, a probléma végül megoldódott.

Amikor 1997-ben az IBM sakkot játszó szuperszámítógépe, a Deep Blue legyőzte Garri Kaszparovot, a számítógépek még egyszerűen csak számítógépek voltak. A Deep Blue több mint egy tonnát nyomott, 32 központi feldolgozóegységgel rendelkezett, és egyetlen másodperc alatt 200 millió sakktáblapozíciót tudott kiértékelni, de mindenki tudta, hogy mit csinál. A számítógép úgy határozta meg a következő legjobb lépést, hogy szimulálta és értéket rendelt a táblán lévő állásokhoz akár 12 lépéssel előre, ami több milliárd lehetséges pozíciót jelentett. Ezt a képességet a Deep Blue készítői közvetlenül programozták bele, ahogyan az első modern számítógépet, az Electronic Numerical Integrator and Computer nevű rendszert, röviden ENIAC-et is úgy programozták 1945-ben, hogy számokat adjon össze. Ezek úgynevezett fehér doboz rendszerek voltak. Nem volt semmiféle rejtély azzal kapcsolatban, mi történik bennük, még akkor sem, ha bizonyos értelemben intelligensek voltak. Hogyan is neveznénk máshogy valamit, ami jól játszik sakkot.

Tizenöt évvel később, 2012-ben a Torontói Egyetem egyik kutatócsoportja kifejlesztett egy AlexNet nevű programot, amely sokkal pontosabban azonosította a képeken látható tárgyakat, mint bármely korábbi rendszer. A képességet akkor demonstrálta, amikor fölényesen megnyert egy kép osztályozási versenyt. Ez különös győzelem volt, mert az AlexNetet a legtöbb szempontból valójában nem is programozták. Ehelyett az AlexNetnek összekapcsolt függvényekből álló struktúrát adtak, amelyeket úgy lehet elképzelni, mint virtuális neuronokat, amelyek utasítást kapnak arra, hogy bekapcsoljanak vagy kikapcsoljanak attól függően, milyen információ halad át rajtuk.

A tanítási szakasz során ezek a függvények kezdetben véletlenszerűen voltak beállítva, majd az volt a feladatuk, hogy apró módosításokat hajtsanak végre saját működésükön attól függően, hogy sikerrel jártak vagy kudarcot vallottak egy kép felismerésében. Az ehhez a megközelítéshez szükséges alapelveket évtizedeken át fejlesztették, az AlexNet azonban - amelyet hatalmas képadatbázissal láttak el - teljesen más léptékben működött. Elég hosszú tanítás után a rendszer egy olyan képfelismerési képletre állt be, amely minden korábbinál jobb volt.

Volt azonban egy csavar. Maga a képlet rejtélyes volt, még azok számára is, akik a rendszerért felelősek voltak. Mivel a képosztályozó algoritmus önálló módon fejlődött ki, az AlexNet belső struktúrájába, vagyis neurális hálózatába tetszőleges számú szabály kódolódhatott, anélkül hogy nyilvánvaló módja lett volna annak kiderítésére, mik ezek a szabályok, vagy hol találhatók. Meg lehetett nézni közvetlenül a program függvényeit, de amikor több tízmillió ilyen elem létezik, a kialakuló struktúra pontos jellemzése gyakorlatilag lehetetlen. A program lényegében fekete doboz volt.

Az AlexNet mérföldkő volt a mesterséges intelligencia történetében. Bár korábban is sok kutatás foglalkozott neurális hálózatokkal, a számítástechnikai közösség szélesebb köre nem köteleződött el teljes mértékben mellettük. Az AlexNet sikere új lendületet adott a neurális hálózatok alkalmazásának új problémák megoldására. Egyesek számára azt sugallta, hogy az intelligens modellek létrehozásának legjobb módja az, ha még inkább eltávolítjuk magunkat a folyamattól. Ahelyett, hogy több struktúrát építenénk bele, inkább készítsünk egy nagyon nagy neurális hálózatot, és hagyjuk, hogy hatalmas mennyiségű adaton tanuljon. Ahogy Rich Sutton számítástechnikus 2019-ben írta, a gépi tanulás hetvenéves kutatásának "keserű tanulsága" az, hogy olyan gépet építeni, amely utánozza "azt, ahogyan szerintünk gondolkodunk", hosszú távon nem működik.

Az MI modellek neurális hálózataiban található matematikai függvények száma több tízmillióról százmillióra, majd milliárdra nőtt. 2018-ban megjelentek az első nagy nyelvi modellek, amelyek egy újfajta neurális hálózatra épültek, de alapvetően ugyanúgy tanították őket, mint az AlexNetet. Ahelyett, hogy képeket azonosítottak volna, a mondatok következő szavát jósolták meg, és emberhez hasonló szövegeket hoztak létre válaszként a kérdésekre. A becslések szerint a Google Gemini és az OpenAI GPT-5 legújabb változatai több billió matematikai függvényt tartalmaznak, bár a pontos számokat nem hozták nyilvánosságra. Ennek a fejlődésnek azonban ára is van, mégpedig az átláthatóság. Ahogy egy modell neurális hálózata egyre nagyobb lesz, egyre nehezebb megérteni.

A homályosság láttán csábító lehet leegyszerűsítésekhez folyamodni. Mondhatnánk például, hogy mivel ezek a rendszerek hozzánk hasonló nyelvet hoznak létre, ezért hozzánk hasonlóak, vagy azt, hogy mivel ezek a rendszerek pusztán matematikai függvények elrendezései, tekinthetünk rájuk óriási keresőtáblázatokként. Mindkét állítás azonban túlságosan leegyszerűsítő. Egyik sem magyarázza meg megfelelően az MI modellek emberfeletti képességeit és furcsán naiv viselkedését.

Ehelyett a számítástechnika egyre növekvő területe, amelyet értelmezhetőségnek neveznek, azon a feltevésen alapul, hogy ahhoz, hogy csökkentsük vagy akár áthidaljuk az MI modellek és az emberek közötti növekvő tudásbeli szakadékot, az MI-t inkább természeti jelenségként kell kezelnünk, mint emberi találmányként. A természet világa tele van ismeretlen szabályokból kialakuló összetett struktúrákkal. A galaxisok, a tengeri csillagok vagy a rákos sejtek mind fekete dobozok bizonyos értelemben. Chris Olah, a terület egyik úttörője szerint - aki Dario Amodeivel és több korábbi OpenAI alkalmazottal együtt megalapította az Anthropic nevű MI vállalatot - az értelmezhetőség olyan, mintha "az égből leszállt idegen organizmusokat tanulmányoznánk". Furcsa hozzáállásnak tűnhet egy olyan technológiával szemben, amelyet mi magunk hoztunk létre, de éppen ez a mesterséges intelligencia varázsa. Képes összezavarni még a saját alkotóit is.

Az Anthropic 2021-es megalapítása előtt a fekete doboz problémájának megoldása nem számított nagy kereskedelmi prioritásnak. Léteztek független értelmezhetőségi kutatók az egyetemeken és ipari laborokban, például az OpenAI-nál és a Google-nél, de viszonylag háttérben maradtak, különösen azokhoz a kollégákhoz képest, akik új modellek fejlesztésével foglalkoztak. A gépi tanulás fókusza a képességeken volt, azon, hogy a modellek egyre jobbak és jobbak legyenek, nem pedig azon, hogy pontosan megértsük, hogyan működnek - mondta Martin Wattenberg, a Harvard értelmezhetőségi kutatója.

Az Anthropic létrejötte részben azon az elképzelésen alapult, hogy az értelmezhetőség kulcsfontosságú, és a terület gyorsan növekedni kezdett a vállalat nyomában. "Ezek a rendszerek teljesen központi szerepet fognak betölteni a gazdaságban, a technológiában és a nemzetbiztonságban, és olyan mértékű autonómiára lesznek képesek, hogy alapvetően elfogadhatatlannak tartom, ha az emberiség teljesen tudatlan marad azzal kapcsolatban, hogyan működnek" - írta Amodei tavaly egy hosszú, spekulatív esszében a fekete doboz modellekről. Nem biztos, hogy számít, ha nem tudjuk kideríteni, miért lép egy sakkprogram négy mezőt a bástyával három helyett, de ugyanez már nem mondható el olyan gépekről, amelyek sürgősségi orvosi döntéseket hoznak, feltételes szabadlábra helyezésről döntenek vagy katonai taktikákat hajtanak végre.

Ez az egyik oka az Anthropic és a Pentagon közötti közelmúltbeli vitának is. A vállalat, amely modelleket szállított az amerikai védelmi minisztériumnak, megtagadta, hogy technológiáját rendkívül kockázatos és potenciálisan megbízhatatlan célokra használják, például teljesen autonóm fegyverrendszerekkel való integrációra. Képzeljük el, hogy egy drón megsemmisít egy iskolabuszt, és az egyetlen magyarázat az, hogy egy MI rendszer irányította oda. Vagy képzeljük el, hogy egy műtétet javasolnak nekünk, és amikor megkérdezzük miért, az orvos csak annyit mond, hogy egy számítógép így döntött. Mi van akkor, ha a számítógép téved? Ilyen mértékű bizalmat csak akkor engedhetnénk meg magunknak, ha jobban bíznánk az MI-ben, mint azokban az emberekben, akik egyébként meghoznák ezeket a döntéseket. De hogyan tehetnénk ezt meg, ha még azt sem tudjuk, hogyan működik a rendszer?

A Prima Mente nevű biomedikai MI vállalatot 2023-ban alapította Ravi Solanki fiatal idegtudós, aki néhány évvel korábban kezdett orvosként dolgozni, éppen akkor, amikor az egyre erősebb MI rendszerek a szélesebb közvélemény figyelmének középpontjába kerültek. Az emberek már használták az MI-t matematikai feladatok megoldására, régészeti romok elemzésére és fehérjék tanulmányozására. Solanki nem látta okát annak, hogy a technológiát ne lehetne diagnosztikai eszközként használni neurodegeneratív betegségek, például a Parkinson-kór vagy az Alzheimer-kór esetében is. Ezeknek a rendellenességeknek számos kiváltó oka ismeretlen, és az Alzheimer-kór egyetlen végleges diagnózisa jelenleg a boncolás. Ha azonban évek során gyűjtött vérmintákat és agyi képalkotó felvételeket adnánk egy MI modellnek neurológiai betegségekben szenvedő és egészséges emberekről, talán képes lenne olyan okokat vagy jelzéseket felismerni, amelyeket a tudósok nem vettek észre. 2025-re Solanki több millió dollárt gyűjtött össze, és első modelljét több száz Alzheimer-kóros és nem Alzheimer-kóros ember adataival tanította be.

Bár a modell eredményei ígéretesnek tűntek - korábban nem vizsgált betegek esetében pontosabban tudta előre jelezni az Alzheimer-kórt, mint egy emberi orvos -, Solanki nem tudta megmagyarázni az eredményeket az orvosoknak. Nem tudta, hogy a modell pontosan mire támaszkodik a diagnózis felállításakor. Ez súlyos hiányosság volt. Amikor Solanki diagnózist ad egy betegnek, tudni akarja "pontosan mely molekuláris jellemzők összessége vezet a döntéshez". Ennél kevesebb nemcsak tudományosan kérdéses, hanem erkölcsileg is felelőtlen. Még a legjobb nagy nyelvi modellek is képesek hibázni például a strawberry szóban található R betűk számának megszámlálásakor. Miért fogadnánk el egy potenciálisan életet megváltoztató diagnózist egy olyan rendszertől, amely ilyen egyszerű feladatban is hibázhat?

"Ha egy modellt megmutatunk egy orvosnak, tudni fogja, hogyan működik" - mondja Timothy Chang neurológus és Alzheimer-kutató a Los Angeles-i Kaliforniai Egyetemen. Solanki egyetért. "Ez nem olyan, mintha házat vásárolnánk" - mondja. "Valakinek az adatait vesszük, és róla mondunk el dolgokat." Solankinak ezért értelmezhetőbbé kellett tennie a modelljét. Az MI rendszer "gondolkodásába" való betekintés legkézenfekvőbb módja az, ha megkérjük a modellt, hogy magyarázza meg magát. Ha egy terápiás nyelvi modell azt mondja, hogy antidepresszánsokat kellene szednünk, megkérdezhetjük miért. A válasz például az lehet, hogy hangulatingadozásaink vannak, már egy ideje szomorúnak érezzük magunkat, és a depresszió a családunkban is előfordult. A logikai lépések követése megmutatja a rendszer gondolatmenetét. Így járunk el akkor is, amikor más emberek hoznak döntéseket. Megkérjük őket, hogy magyarázzák el a döntésüket, és ha elégedettek vagyunk az érveléssel, elfogadjuk azt.

A legtöbb orvosi modell esetében azonban ez nem működik. Egy diagnosztikai modell például nem szavakkal dolgozik, hanem biológiai adatokkal. Tegyük fel, hogy egy nyelvi modellt kérünk meg arra, hogy értelmezze, hogyan jutott egy másik rendszer a mellrák diagnózisára. Ideális esetben a modell pontosan meg tudná mondani, mely adatok vezettek az eredményhez. Például azt mondhatná, hogy a vérmintákban található fehérvérsejtek mennyisége kapcsolatban áll a mellrákkal. De honnan tudjuk, hogy maga az értelmező modell jól végzi a munkáját? Megbízhatunk benne, de vajon szabad-e?

Az Apple és az Arizona State University kutatásai azt találták, hogy a modellek gyakran következetlenül magyarázzák meg saját működésüket, vagy egyszerűen kitalálnak magyarázatokat. Emellett egyre nagyobb az aggodalom azzal kapcsolatban, hogy a nyelvi modellek megtévesztő viselkedést tanúsíthatnak. Egy OpenAI kutatócsoport ezt "cselszövésnek" nevezte, amikor a modell úgy tesz, mintha teljesítené a felhasználó kérését, miközben titokban más célokat követ. A kutatók nemrég azt találták, hogy az OpenAI egyik modellje egy önértékelés során még azt is mérlegelte, hogy hazudjon. Egy Google modell statisztikákat próbált kitalálni. Egy Anthropic modell pedig megpróbálta technikai zavarodottsággal elterelni a figyelmet a hibáiról.

És amikor nem próbál manipulálni, egy nyelvi modell gyakran olyan dolgokról beszél, amelyeket a jelenlegi szókészletünkkel nem lehet pontosan kifejezni. Been Kim, a Google egyik értelmezhetőségi kutatója szerint minden nyelvi modell egy olyan nyelven kommunikál, amely hasonlít a miénkre, de teljesen más fogalmi rendszerből származik. A kék szó például szinte biztosan mást jelent egy modell számára, mint egy ember számára. Ez különösen problémás akkor, amikor a modelleket arra kérjük, hogy magyarázzák meg saját működésüket, vagy más modellek döntéseit értelmezzék. Az egyik lehetséges megoldás az, ha kevésbé az elmére, és inkább az agyra koncentrálunk, vagyis a neurális hálózatot vesszük nagyító alá. Ez azonban rendkívül nehéz feladat. Egy ilyen hálózat vizsgálata olyan, mintha egy statikus tévéképernyő pixeleit néznénk, csak itt nem nyolcmillió, hanem akár ezermilliárd pixel van.

A Goodfire nevű vállalat például olyan módszereket fejleszt, amelyekkel mikroszkópszerűen lehet vizsgálni a neurális hálózatokat. A cég és a Prima Mente közös kutatása során azt találták, hogy az Alzheimer-kór kapcsolatban állhat a vérben található DNS töredékek hosszával. Ez egy teljesen új biomarker lehet a betegség korai felismerésére. A következtetés azonban csak egy értelmezhetőségi technika segítségével született, amelyről ismert, hogy nem tökéletes. A kutatók szerint az értelmezhetőség olyan, mint egy eszköztár, amely különböző felbontásokban segít megérteni a modellek működését. Bár még nincs biztos módszer az MI rendszerek teljes értelmezésére, a kutatás lassan halad előre. Új módszereket fejlesztenek ki, majd tesztelnek, elvetnek vagy továbbfejlesztenek.

Lehetséges, hogy soha nem fogjuk teljesen megérteni, miért választ egy MI modell egy adott szót vagy diagnózist egy másik helyett. De bizonyos értelemben ez mindig is az emberi állapot része volt. Az emberek sem tudják teljesen megmagyarázni saját döntéseiket. A remény az, hogy a jövőben az MI fejlődése kevésbé lesz rohanó, és az értelmezhetőségi kutatók inkább biológusokhoz vagy pszichológusokhoz hasonló módon tanulmányozhatják majd ezeket a rendszereket. A tudomány lassú folyamat, de megbízható. Új módszereket dolgoznak ki, tesztelnek, elvetnek vagy továbbfejlesztenek. Több mint kétszáz év telt el a kórokozók felfedezése után, mire az emberek megértették, hogy betegségeket okoznak.

Ahogy David Bau kutató fogalmazott, a neurális hálózatokban rejlő struktúra tagadhatatlan. Szerinte jelenleg nagyjából ott tartunk, ahol a biológia tartott 1930 körül. Akkoriban a sejt még fekete doboz volt a biológusok számára. Amikor azonban komolyan elkezdték tanulmányozni, a probléma végül megoldódott.