SG.hu·

A hamisított szexképeket készítő gyerekek pontosan tudják, hogy amit csinálnak az káros

A deepfake, azaz mélyhamisított aktfotók által egyre inkább traumatizált tinédzserek egyértelműen tudják, hogy az MI által az osztálytársaikról generált szexképek károsak. És a jelek szerint sokan a kínzóik közül is így vannak - ők általában ingyenes vagy olcsó „nudify” alkalmazásokat vagy webes eszközöket használnak az áldozatok ártatlan képeinek "levetkőztetésére”, és ennek ellenére továbbítják a hamis anyagokat az iskolában vagy online ismerőseiknek. Egy nemrégiben készült felmérés szerint a 20 év alatti fiatalok körében egyre nagyobb az egyetértés abban, hogy a hamis aktképek készítése és megosztása nyilvánvalóan bántalmazás.

Ez egy szerény "jó hír” a deepfake fronton, mondta Melissa Stroebel, a Thorn kutatási igazgatója. A középiskolák teljesen felkészületlenek az áldozatok támogatására, vagy egyes esetekben még a bántalmazás elismerésére is. Egy 2023-as felmérés szerint a deepfake pornográfia - azaz amikor eltérő arcot raknak ilyen videókra - már normalizált felnőtt szórakozássá vált: 1522 amerikai férfi deepfake pornófelhasználó 74 százaléka azt mondta, hogy „nem érzi magát bűnösnek” ilyenek megtekintése miatt. És ez az álláspont a társadalmi normákról káoszt okoz az iskolákban. Pennsylvaniában a szülők még egy magániskola vezetőjét is perbe akarták fogni, mert az igazgató állítólag hónapokon keresztül figyelmen kívül hagyott egy diák által készített hamis aktfotókról szóló jelentéseket, amelyek idővel közel 50 diáklányt céloztak meg.

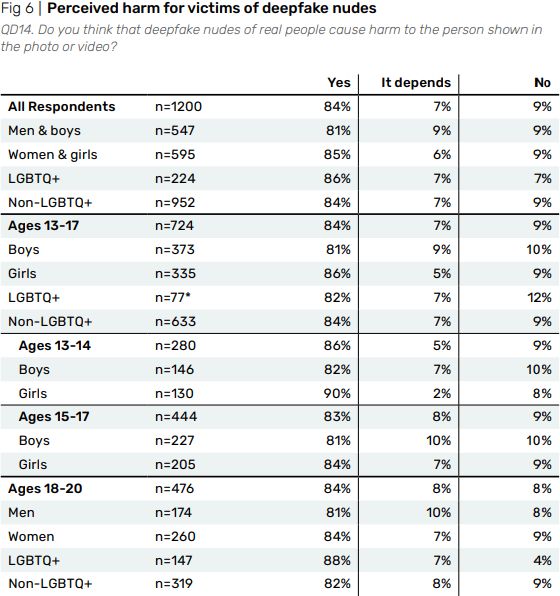

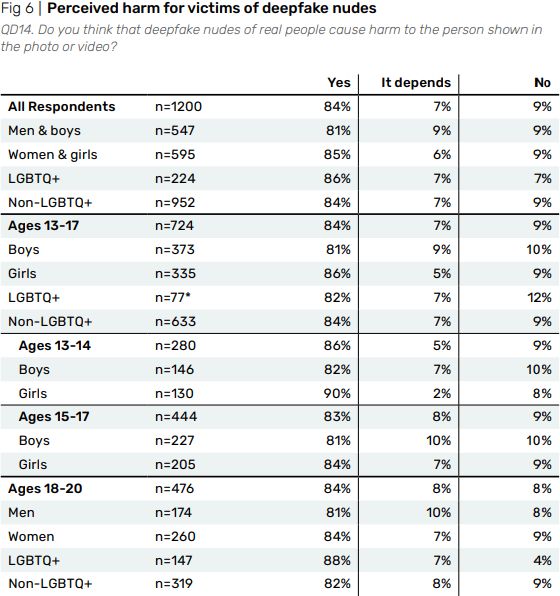

De ahogyan a barátaik és osztálytársaik kárt szenvednek, úgy tűnik, sok tizenéves kezdi megérteni, hogy a mesterséges intelligencia használata a beleegyezés nélküli aktfotók létrehozására nem oké. Egy 1200, 13-20 év közötti fiatal körében végzett felmérés eredményei szerint a válaszadók 84 százaléka „túlnyomórészt felismeri”, hogy a deepfake aktfotók olyan visszaélésnek minősülnek, amely kárt okoz az ábrázolt áldozatnak. A fiatalok számára a deepfake aktfotók készítése még nem normalizálódott. A Thorn felmérése azonban, amely szerint a megkérdezett fiatalok 10 százaléka személyesen ismer áldozatot, azt sugallja, hogy „valószínűbb, hogy ez szinte minden iskolarendszerben megtörténik az országban”, és valószínűleg „minden városban volt legalább egy olyan személy, aki valamilyen módon vagy formában célpont volt” - vetette fel. "Még ha egyetlen személy hozza is létre, és egyetlen személy a célpont, valószínűleg az egész közösségben elterjed” - mondta, azt sugallva, hogy az ilyen nem konszenzuális megosztás "exponenciálisan növeli az érintett gyerekek számát és az ábrázolt gyermeknek okozott kár mértékét."

Roberta Duffield, a Blackbird.AI intelligencia igazgatója - amely deepfake detektáló eszközöket gyárt - szerint jelenleg „a gyerekeket (és felnőtteket) célzó deepfake aktfotók okozzák az egyik legalattomosabb és legszélesebb körű károkat a mesterséges intelligenciával kapcsolatban”. És különösen a fiatalok számára, akik „még mindig alakítják az identitásukat, a pszichológiai, reputációs és társadalmi következmények súlyosak és hosszú távúak lehetnek” - mondta Duffield. Egyetértett Stroebellel abban, hogy sürgősen szükség van a probléma többoldalú megközelítésére, amely nemcsak az iskolákat és a szülőket, hanem a jogalkotókat és a technológiai vállalatokat is bevonja. "A gyerekek mesterséges intelligencia által generált szexuális anyagokkal szembeni védelmének az első helyen kellene állnia a közösségi médiaplatformok tartalommoderálási politikáiban és a törvényhozók irodáiban” - mondta Duffield.

Mióta a nudify alkalmazások egyre inkább elterjedtek, az áldozatok többsége nő, de fiatal férfiak is célpontok lettek - állapította meg a Thorn, amely több kutatást sürgetett az összes fiatal tapasztalatainak feltárására. Ez a tendencia talán hozzájárult ahhoz, hogy az általános vélekedés - legalábbis a fiatalok körében - eltolódott attól, hogy a szexuális visszaéléseket egyszerű viccként védjék. Stroebel meglepődve tapasztalta, hogy a felmérésben részt vevő fiatalok többsége már nem tartja viccesnek az ilyen poénokat. "Mindenki látni fogja, zavarba jönnek, és ez soha nem fog elmúlni” - mondta egy 13 éves fiú válaszadó. Egy másik, 18 éves férfi válaszadó még jobban megértette az összetettséget, és kifejtette, hogy „dehumanizálja az embert, mivel beleegyezés nélkül használod fel örömszerzésre”. Egy 14 éves fiú azt állította, hogy azért készített deepfake aktokat, hogy visszavágjon egy bántalmazónak. Egy egy évvel idősebb, másik tinédzser fiú azt mondta, hogy csak „látni akarta, hogy nézne ki”. Egy harmadik tinédzser fiú azt mondta, hogy csak „látni akarta, milyen lesz”. Egy 18 éves férfi annyit mondott, hogy "kanos voltam és nem gondolkodtam tisztán."

„Tényleg meglepő és egyben nagyon reménykeltő számomra, hogy a gyerekek tisztán látják ezt a témát” - mondta Stroebel, különösen ahhoz képest, hogy a 2023-as felmérés eredményei szerint sok felnőtt férfi szerint semmi rossz nincs a hamis aktfotókban. Mivel a fiatalok digitális bennszülöttek, nagyobb valószínűséggel válnak a feltörekvő technológiák, például a nudify alkalmazások korai alkalmazóivá; sajnos történetesen életüknek abban a szakaszában vannak, amikor valószínűleg kockázatosabb viselkedésformákba kezdenek. A deepfake aktképek létrehozásának motivációi között szerepel a „szexuális kíváncsiság, az élvezetkeresés, a bosszú” és a társak nyomása, állapította meg a Thorn.

A válaszadók mindössze 9 százaléka vitatta az ártalmakat, azzal racionalizálva a mesterséges intelligencia aktfotók létrehozására, megtekintésére vagy megosztására vonatkozó döntéseket, hogy senki sem sérült meg. Az ártalmakat tagadók többsége ragaszkodott ahhoz, hogy a képek nem okozhatnak valódi kárt, mert hamisak, míg mások azt állították, hogy az áldozatoknak fizikailag nem esik bántódásuk, vagy lekicsinyelték az okozott érzelmi fájdalom súlyosságát. "Amint mindenki megtudja, hogy ez egy deepfake, a pánik és a félelem érzése megszűnik” - vélekedett egy 16 éves lány. "Valójában nem te vagy az, így nincs nyomás. Egy kicsit stresszes, de valójában nem az ő testükről van szó”. Egy 13 éves fiú egyetértett azzal, hogy ez etikátlan, de végső soron nem káros, mondván: „te irányítod, hogy mi bánt téged. Persze, rossz dolog deepfake aktfotókat készíteni, de végső soron ez egy hamisítvány”.

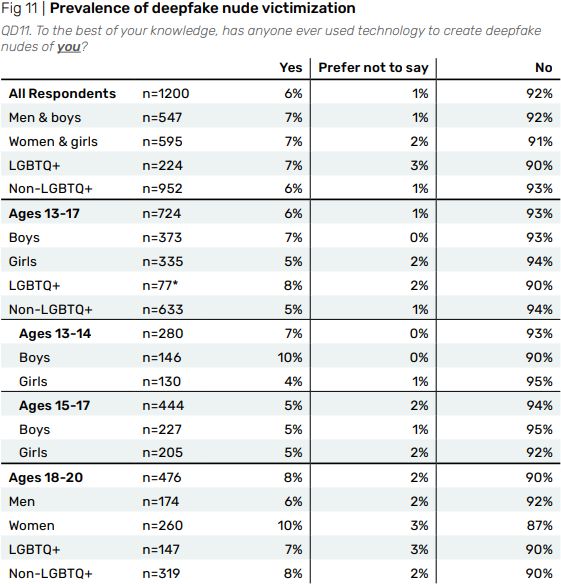

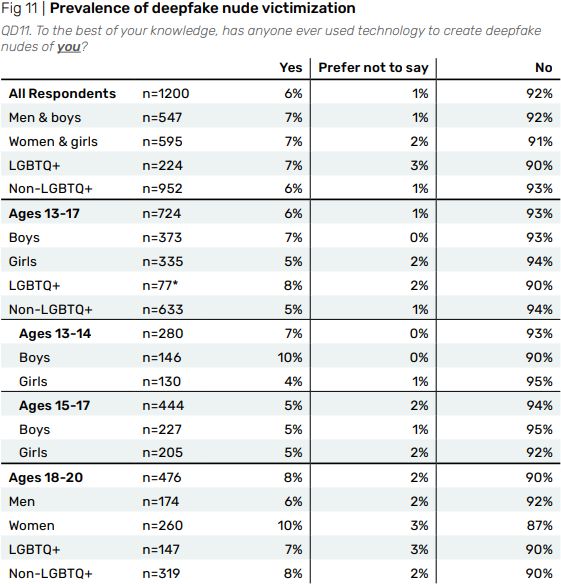

A Thorn azt gyanítja, hogy a fiatalok a deepfake aktfotókkal kapcsolatos tapasztalataikról nem számolnak be alaposan, részben azért, mert az áldozatok túlságosan szégyellik vagy traumatizáltak ahhoz, hogy jelentsenek, részben pedig azért, mert fogalmuk sincs a hamis aktfotók létezéséről. A válaszadók körülbelül 27 százaléka mondta, hogy saját fogyasztásra készített hamis aktképeket, és soha nem osztotta meg azokat. Azonban a legtöbb fiatal, aki hamis aktfotókat készít, megosztja azokat (65 százalék). És nagyjából ugyanolyan valószínűséggel (30 százalék) osztják meg őket más iskolai gyerekekkel, mint a kizárólag online kapcsolatokkal (29 százalék). Duffield elmondta, hogy a megosztásra való késztetés miatt van szükség oktatási kampányokra, hogy „segítsünk az embereknek megkérdőjelezni a tartalmat, mielőtt megosztják”.

A felmérés azt mutatja, hogy a tizenévesek sokkal árnyaltabban gondolkodnak a deepfake aktfotókról, mint azt egyes szakértők várnák. Az iskolákat megrázó botrányokat nyomon követő híradások pedig azt mutatják, hogy a társadalom hozzáállása a hamis aktfotókhoz fontos a tizenévesek számára, akik nagyobb valószínűséggel kérnek segítséget a hamis aktfotókból eredő károk leküzdéséhez (76 százalék), mint az online szexuális interakciók más formáival való megbirkózáshoz (46 százalék). A megkérdezett fiatalok többsége olyan online eszközöket használ, mint a blokkolás vagy a jelentés, amikor szembeszáll a mélyen hamisított aktfotókkal. De több mint a fele (57 százalék) offline is segítséget kért, leggyakrabban szülőhöz, iskolai hatósághoz, barátokhoz vagy rendőrséghez fordulva. Annak érdekében, hogy a fiatalok továbbra is segítségért forduljanak, több támogató forrásra van szükség, mutatja a Thorn felmérése, beleértve a segélyvonalakat és a jogi segítségnyújtást.

Emellett minden iskolának sürgősen meg kell alkotnia egy olyan szabályzatot, amely világossá teszi a szülők és a diákok számára, hogyan reagál az iskola, ha deepfake aktbotrány merül fel - mondta Stroebel. Ennek tartalmaznia kell a válságkezelési terveket is, mondta Duffield. "A pedagógusok szabványosított irányelveket dolgozhatnának ki a deepfake incidensek kezelésére, forrásokat biztosíthatnának a pedagógusok és a szülők számára, és együttműködhetnének a bűnüldöző szervekkel a jogi kihívások kezelése érdekében” - mondta Duffield.

Több kutatást kellene végezni arról is, hogy a fiatalok hogyan használják a blokkolást és a bejelentést az online fenyegetések elleni küzdelemben. Stroebel szeretné jobban megérteni, hogy a gyerekek miért döntenek úgy, hogy bizonyos körülmények között inkább blokkolnak, mint jelentenek. Aggódik amiatt, hogy a gyerekek túlnyomórészt a hamis aktképeket megosztó felhasználók blokkolását választják ahelyett, hogy jelentenék a támadást, és szélesebb körű platformreakciót kezdeményeznének, ami segíthetne minimalizálni a több felhasználónak okozott kárt. Szerinte az is aggasztó, hogy különösen a fiatal felhasználók, akik úgy érzik, hogy közvetlen veszélyben vannak, tévesen azt várják, hogy a hamis aktok bejelentése azonnali intézkedést vált ki.

Duffield szerint a technológiai cégek megfontolhatnák azt is, hogy az erősebb deepfake-felismerést helyezzenek előtérbe. Intézményi támogatásra van szükség ahhoz, hogy a hamis aktfotók ne váljanak a tinédzserek életének normális részévé. A gyerekek tudni akarják, hogyan védhetik meg magukat és a barátaikat, és ebben a pillanatban sehol nincs egyértelműen leszögezve, hogy a hamis aktfotók készítése komoly következményekkel jár. Úgy tűnik, még a támogató iskolák sem osztják meg nyilvánosan a gyerekeket segítő terveiket, és ezzel potenciálisan nyitva hagynak egy olyan vitát arról, hogy mi a helyes és mi a helytelen, amely Stroebel szerint minél tovább tart, annál nagyobb veszélynek teszi ki a fiatalokat.

"Nincs egységes intézményi válasz, akár a politika szintjén, akár a családi egységek szintjén, akár az iskola szintjén. A normalizáció akkor jön létre, ha egy dolog széles körben elfogadott és előre látható” - mondta Stroebel. "Ha túl sokáig nincs intézményi válasz, amely kifejezetten tisztázza, hogy ez káros viselkedés, akkor egyéni vélemények lesznek arról, hogy ez káros-e vagy sem" - mondta Stroebel. Ez azzal a kockázattal jár, hogy a mai hiányzó szabvány marad a status quo, és „az irányítás az elkövetők kezében marad, akik döntést hozhatnak arról, hogy létrehoznak-e nem konszenzusos visszaélésről szóló képeket vagy sem” - mondta Stroebel. Sok tinédzser mondta a Thornnak, hogy elismerik a bántalmazás tényét és segítséget kérnek. Ahogy egy 15 éves lány magyarázta, "még ha nem is valós dologról van szó", az áldozatoknak jelenleg "nincs módjuk ezt bizonyítani, és nem tudják csak úgy letagadni, mert az ő arcuk van rajta”.

Ez egy szerény "jó hír” a deepfake fronton, mondta Melissa Stroebel, a Thorn kutatási igazgatója. A középiskolák teljesen felkészületlenek az áldozatok támogatására, vagy egyes esetekben még a bántalmazás elismerésére is. Egy 2023-as felmérés szerint a deepfake pornográfia - azaz amikor eltérő arcot raknak ilyen videókra - már normalizált felnőtt szórakozássá vált: 1522 amerikai férfi deepfake pornófelhasználó 74 százaléka azt mondta, hogy „nem érzi magát bűnösnek” ilyenek megtekintése miatt. És ez az álláspont a társadalmi normákról káoszt okoz az iskolákban. Pennsylvaniában a szülők még egy magániskola vezetőjét is perbe akarták fogni, mert az igazgató állítólag hónapokon keresztül figyelmen kívül hagyott egy diák által készített hamis aktfotókról szóló jelentéseket, amelyek idővel közel 50 diáklányt céloztak meg.

De ahogyan a barátaik és osztálytársaik kárt szenvednek, úgy tűnik, sok tizenéves kezdi megérteni, hogy a mesterséges intelligencia használata a beleegyezés nélküli aktfotók létrehozására nem oké. Egy 1200, 13-20 év közötti fiatal körében végzett felmérés eredményei szerint a válaszadók 84 százaléka „túlnyomórészt felismeri”, hogy a deepfake aktfotók olyan visszaélésnek minősülnek, amely kárt okoz az ábrázolt áldozatnak. A fiatalok számára a deepfake aktfotók készítése még nem normalizálódott. A Thorn felmérése azonban, amely szerint a megkérdezett fiatalok 10 százaléka személyesen ismer áldozatot, azt sugallja, hogy „valószínűbb, hogy ez szinte minden iskolarendszerben megtörténik az országban”, és valószínűleg „minden városban volt legalább egy olyan személy, aki valamilyen módon vagy formában célpont volt” - vetette fel. "Még ha egyetlen személy hozza is létre, és egyetlen személy a célpont, valószínűleg az egész közösségben elterjed” - mondta, azt sugallva, hogy az ilyen nem konszenzuális megosztás "exponenciálisan növeli az érintett gyerekek számát és az ábrázolt gyermeknek okozott kár mértékét."

Roberta Duffield, a Blackbird.AI intelligencia igazgatója - amely deepfake detektáló eszközöket gyárt - szerint jelenleg „a gyerekeket (és felnőtteket) célzó deepfake aktfotók okozzák az egyik legalattomosabb és legszélesebb körű károkat a mesterséges intelligenciával kapcsolatban”. És különösen a fiatalok számára, akik „még mindig alakítják az identitásukat, a pszichológiai, reputációs és társadalmi következmények súlyosak és hosszú távúak lehetnek” - mondta Duffield. Egyetértett Stroebellel abban, hogy sürgősen szükség van a probléma többoldalú megközelítésére, amely nemcsak az iskolákat és a szülőket, hanem a jogalkotókat és a technológiai vállalatokat is bevonja. "A gyerekek mesterséges intelligencia által generált szexuális anyagokkal szembeni védelmének az első helyen kellene állnia a közösségi médiaplatformok tartalommoderálási politikáiban és a törvényhozók irodáiban” - mondta Duffield.

Mióta a nudify alkalmazások egyre inkább elterjedtek, az áldozatok többsége nő, de fiatal férfiak is célpontok lettek - állapította meg a Thorn, amely több kutatást sürgetett az összes fiatal tapasztalatainak feltárására. Ez a tendencia talán hozzájárult ahhoz, hogy az általános vélekedés - legalábbis a fiatalok körében - eltolódott attól, hogy a szexuális visszaéléseket egyszerű viccként védjék. Stroebel meglepődve tapasztalta, hogy a felmérésben részt vevő fiatalok többsége már nem tartja viccesnek az ilyen poénokat. "Mindenki látni fogja, zavarba jönnek, és ez soha nem fog elmúlni” - mondta egy 13 éves fiú válaszadó. Egy másik, 18 éves férfi válaszadó még jobban megértette az összetettséget, és kifejtette, hogy „dehumanizálja az embert, mivel beleegyezés nélkül használod fel örömszerzésre”. Egy 14 éves fiú azt állította, hogy azért készített deepfake aktokat, hogy visszavágjon egy bántalmazónak. Egy egy évvel idősebb, másik tinédzser fiú azt mondta, hogy csak „látni akarta, hogy nézne ki”. Egy harmadik tinédzser fiú azt mondta, hogy csak „látni akarta, milyen lesz”. Egy 18 éves férfi annyit mondott, hogy "kanos voltam és nem gondolkodtam tisztán."

„Tényleg meglepő és egyben nagyon reménykeltő számomra, hogy a gyerekek tisztán látják ezt a témát” - mondta Stroebel, különösen ahhoz képest, hogy a 2023-as felmérés eredményei szerint sok felnőtt férfi szerint semmi rossz nincs a hamis aktfotókban. Mivel a fiatalok digitális bennszülöttek, nagyobb valószínűséggel válnak a feltörekvő technológiák, például a nudify alkalmazások korai alkalmazóivá; sajnos történetesen életüknek abban a szakaszában vannak, amikor valószínűleg kockázatosabb viselkedésformákba kezdenek. A deepfake aktképek létrehozásának motivációi között szerepel a „szexuális kíváncsiság, az élvezetkeresés, a bosszú” és a társak nyomása, állapította meg a Thorn.

A válaszadók mindössze 9 százaléka vitatta az ártalmakat, azzal racionalizálva a mesterséges intelligencia aktfotók létrehozására, megtekintésére vagy megosztására vonatkozó döntéseket, hogy senki sem sérült meg. Az ártalmakat tagadók többsége ragaszkodott ahhoz, hogy a képek nem okozhatnak valódi kárt, mert hamisak, míg mások azt állították, hogy az áldozatoknak fizikailag nem esik bántódásuk, vagy lekicsinyelték az okozott érzelmi fájdalom súlyosságát. "Amint mindenki megtudja, hogy ez egy deepfake, a pánik és a félelem érzése megszűnik” - vélekedett egy 16 éves lány. "Valójában nem te vagy az, így nincs nyomás. Egy kicsit stresszes, de valójában nem az ő testükről van szó”. Egy 13 éves fiú egyetértett azzal, hogy ez etikátlan, de végső soron nem káros, mondván: „te irányítod, hogy mi bánt téged. Persze, rossz dolog deepfake aktfotókat készíteni, de végső soron ez egy hamisítvány”.

A Thorn azt gyanítja, hogy a fiatalok a deepfake aktfotókkal kapcsolatos tapasztalataikról nem számolnak be alaposan, részben azért, mert az áldozatok túlságosan szégyellik vagy traumatizáltak ahhoz, hogy jelentsenek, részben pedig azért, mert fogalmuk sincs a hamis aktfotók létezéséről. A válaszadók körülbelül 27 százaléka mondta, hogy saját fogyasztásra készített hamis aktképeket, és soha nem osztotta meg azokat. Azonban a legtöbb fiatal, aki hamis aktfotókat készít, megosztja azokat (65 százalék). És nagyjából ugyanolyan valószínűséggel (30 százalék) osztják meg őket más iskolai gyerekekkel, mint a kizárólag online kapcsolatokkal (29 százalék). Duffield elmondta, hogy a megosztásra való késztetés miatt van szükség oktatási kampányokra, hogy „segítsünk az embereknek megkérdőjelezni a tartalmat, mielőtt megosztják”.

A felmérés azt mutatja, hogy a tizenévesek sokkal árnyaltabban gondolkodnak a deepfake aktfotókról, mint azt egyes szakértők várnák. Az iskolákat megrázó botrányokat nyomon követő híradások pedig azt mutatják, hogy a társadalom hozzáállása a hamis aktfotókhoz fontos a tizenévesek számára, akik nagyobb valószínűséggel kérnek segítséget a hamis aktfotókból eredő károk leküzdéséhez (76 százalék), mint az online szexuális interakciók más formáival való megbirkózáshoz (46 százalék). A megkérdezett fiatalok többsége olyan online eszközöket használ, mint a blokkolás vagy a jelentés, amikor szembeszáll a mélyen hamisított aktfotókkal. De több mint a fele (57 százalék) offline is segítséget kért, leggyakrabban szülőhöz, iskolai hatósághoz, barátokhoz vagy rendőrséghez fordulva. Annak érdekében, hogy a fiatalok továbbra is segítségért forduljanak, több támogató forrásra van szükség, mutatja a Thorn felmérése, beleértve a segélyvonalakat és a jogi segítségnyújtást.

Emellett minden iskolának sürgősen meg kell alkotnia egy olyan szabályzatot, amely világossá teszi a szülők és a diákok számára, hogyan reagál az iskola, ha deepfake aktbotrány merül fel - mondta Stroebel. Ennek tartalmaznia kell a válságkezelési terveket is, mondta Duffield. "A pedagógusok szabványosított irányelveket dolgozhatnának ki a deepfake incidensek kezelésére, forrásokat biztosíthatnának a pedagógusok és a szülők számára, és együttműködhetnének a bűnüldöző szervekkel a jogi kihívások kezelése érdekében” - mondta Duffield.

Több kutatást kellene végezni arról is, hogy a fiatalok hogyan használják a blokkolást és a bejelentést az online fenyegetések elleni küzdelemben. Stroebel szeretné jobban megérteni, hogy a gyerekek miért döntenek úgy, hogy bizonyos körülmények között inkább blokkolnak, mint jelentenek. Aggódik amiatt, hogy a gyerekek túlnyomórészt a hamis aktképeket megosztó felhasználók blokkolását választják ahelyett, hogy jelentenék a támadást, és szélesebb körű platformreakciót kezdeményeznének, ami segíthetne minimalizálni a több felhasználónak okozott kárt. Szerinte az is aggasztó, hogy különösen a fiatal felhasználók, akik úgy érzik, hogy közvetlen veszélyben vannak, tévesen azt várják, hogy a hamis aktok bejelentése azonnali intézkedést vált ki.

Duffield szerint a technológiai cégek megfontolhatnák azt is, hogy az erősebb deepfake-felismerést helyezzenek előtérbe. Intézményi támogatásra van szükség ahhoz, hogy a hamis aktfotók ne váljanak a tinédzserek életének normális részévé. A gyerekek tudni akarják, hogyan védhetik meg magukat és a barátaikat, és ebben a pillanatban sehol nincs egyértelműen leszögezve, hogy a hamis aktfotók készítése komoly következményekkel jár. Úgy tűnik, még a támogató iskolák sem osztják meg nyilvánosan a gyerekeket segítő terveiket, és ezzel potenciálisan nyitva hagynak egy olyan vitát arról, hogy mi a helyes és mi a helytelen, amely Stroebel szerint minél tovább tart, annál nagyobb veszélynek teszi ki a fiatalokat.

"Nincs egységes intézményi válasz, akár a politika szintjén, akár a családi egységek szintjén, akár az iskola szintjén. A normalizáció akkor jön létre, ha egy dolog széles körben elfogadott és előre látható” - mondta Stroebel. "Ha túl sokáig nincs intézményi válasz, amely kifejezetten tisztázza, hogy ez káros viselkedés, akkor egyéni vélemények lesznek arról, hogy ez káros-e vagy sem" - mondta Stroebel. Ez azzal a kockázattal jár, hogy a mai hiányzó szabvány marad a status quo, és „az irányítás az elkövetők kezében marad, akik döntést hozhatnak arról, hogy létrehoznak-e nem konszenzusos visszaélésről szóló képeket vagy sem” - mondta Stroebel. Sok tinédzser mondta a Thornnak, hogy elismerik a bántalmazás tényét és segítséget kérnek. Ahogy egy 15 éves lány magyarázta, "még ha nem is valós dologról van szó", az áldozatoknak jelenleg "nincs módjuk ezt bizonyítani, és nem tudják csak úgy letagadni, mert az ő arcuk van rajta”.