SG.hu·

Hatályba lépett az EU mesterséges intelligencia-törvénye

Most már hivatalos, 2024. augusztus 1-jén, csütörtökön hatályba lépett az Európai Unió kockázatalapú szabályozása a mesterséges intelligencia alkalmazásaira vonatkozóan.

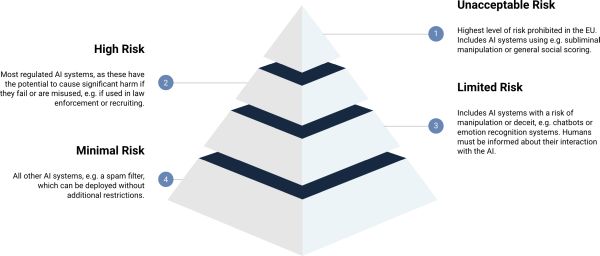

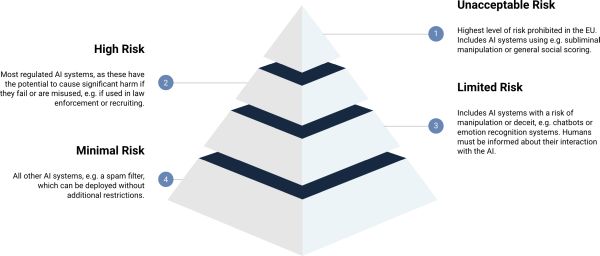

Ezzel elindul egy sor lépcsőzetes megfelelési határidő, amelyeket a törvény a különböző típusú MI-fejlesztésekre és -alkalmazásokra fog alkalmazni. A legtöbb rendelkezés 2026 közepére lesz teljes mértékben alkalmazandó. Az első határidő azonban, amely a mesterséges intelligencia néhány tiltott felhasználási módjára vonatkozó tilalmakat lépteti életbe bizonyos kontextusokban - például a biometrikus adatok nyilvános helyeken történő bűnüldözési célú felhasználására - már hat hónap múlva hatályba lép. A szervezet megközelítése szerint a mesterséges intelligencia legtöbb alkalmazása alacsony/nem kockázatosnak minősül, így egyáltalán nem tartozik majd a rendelet hatálya alá.

A mesterséges intelligencia potenciális felhasználásainak egy része magas kockázatúnak minősül, például a biometria és az arcfelismerés, a mesterséges intelligencia alapú orvosi szoftverek, illetve az olyan területeken használt mesterséges intelligencia, mint az oktatás és a foglalkoztatás. Az ezeken a területeken használt rendszereket be kell majd jegyezni egy uniós adatbázisba, és fejlesztőiknek biztosítaniuk kell a kockázatkezelési és minőségirányítási kötelezettségek betartását. A harmadik, "korlátozott kockázatú" szint az olyan MI-technológiákra vonatkozik, mint a chatbotok vagy a deepfake, azaz mélyhamisítások előállítására alkalmas eszközök. Ezeknek bizonyos átláthatósági követelményeknek kell megfelelniük, hogy a felhasználókat ne lehessen megtéveszteni.

A büntetések is többszintűek: a globális éves forgalom akár 7%-áig terjedő bírságok szabhatók ki a tiltott mesterséges intelligencia-alkalmazások megsértése esetén; 3%-ig terjedő bírságok egyéb kötelezettségek megszegése esetén; és 1,5%-ig terjedő bírságok a szabályozó hatóságoknak nyújtott helytelen információkért.

A törvény egy másik fontos része az úgynevezett általános célú mesterséges intelligenciák (GPAI) fejlesztőire vonatkozik. Az EU itt is kockázatalapú megközelítést alkalmazott, és a legtöbb GPAI-fejlesztőre csak enyhe átláthatósági követelmények vonatkoznak. Csak a legerősebb modellek egy részhalmazától várják el, hogy kockázatértékelést és kockázatcsökkentő intézkedéseket tegyen. Hogy pontosan mit kell majd tenniük a GPAI-fejlesztőknek ahhoz, hogy megfeleljenek a mesterséges intelligenciáról szóló törvénynek, azt még tárgyalják, mivel a gyakorlati kódexek kidolgozása még várat magára. A hét elején az AI Office, a stratégiai felügyeletet és az MI-ökoszisztéma kiépítését végző szerv konzultációt indított és felhívást tett közzé a szabályalkotási folyamatban való részvételre, és közölte, hogy várhatóan 2025 áprilisában véglegesíti a kódexeket.

A múlt hónap végén az OpenAI, a ChatGPT alapjául szolgáló GPT nagy nyelvi modell gyártója azt közölte, hogy várhatóan "szorosan együttműködik az EU AI Office és más érintett hatóságokkal az új törvény végrehajtása során az elkövetkező hónapokban". Ez magában foglalja a technikai dokumentáció és egyéb útmutatók összeállítását a GPAI-modellek szolgáltatói és alkalmazói számára. "Ha az Ön szervezete megpróbálja meghatározni, hogyan feleljen meg a mesterséges intelligenciáról szóló törvénynek, először is határozza meg, hogy milyen GPAI és egyéb MI-rendszereket használ, határozza meg, hogy ezek hogyan vannak besorolva, és fontolja meg, hogy milyen kötelezettségek következnek a felhasználási eseteiből" - közölte az OpenAI, amely saját megfelelési útmutatást kínál az MI-fejlesztőknek. "Azt is meg kell határoznia, hogy az MI-rendszerek tekintetében szolgáltatónak vagy telepítőnek minősül-e. Ezek a kérdések összetettek lehetnek, ezért ha kérdései vannak, forduljon jogi tanácsadóhoz".

Ezzel elindul egy sor lépcsőzetes megfelelési határidő, amelyeket a törvény a különböző típusú MI-fejlesztésekre és -alkalmazásokra fog alkalmazni. A legtöbb rendelkezés 2026 közepére lesz teljes mértékben alkalmazandó. Az első határidő azonban, amely a mesterséges intelligencia néhány tiltott felhasználási módjára vonatkozó tilalmakat lépteti életbe bizonyos kontextusokban - például a biometrikus adatok nyilvános helyeken történő bűnüldözési célú felhasználására - már hat hónap múlva hatályba lép. A szervezet megközelítése szerint a mesterséges intelligencia legtöbb alkalmazása alacsony/nem kockázatosnak minősül, így egyáltalán nem tartozik majd a rendelet hatálya alá.

A mesterséges intelligencia potenciális felhasználásainak egy része magas kockázatúnak minősül, például a biometria és az arcfelismerés, a mesterséges intelligencia alapú orvosi szoftverek, illetve az olyan területeken használt mesterséges intelligencia, mint az oktatás és a foglalkoztatás. Az ezeken a területeken használt rendszereket be kell majd jegyezni egy uniós adatbázisba, és fejlesztőiknek biztosítaniuk kell a kockázatkezelési és minőségirányítási kötelezettségek betartását. A harmadik, "korlátozott kockázatú" szint az olyan MI-technológiákra vonatkozik, mint a chatbotok vagy a deepfake, azaz mélyhamisítások előállítására alkalmas eszközök. Ezeknek bizonyos átláthatósági követelményeknek kell megfelelniük, hogy a felhasználókat ne lehessen megtéveszteni.

A büntetések is többszintűek: a globális éves forgalom akár 7%-áig terjedő bírságok szabhatók ki a tiltott mesterséges intelligencia-alkalmazások megsértése esetén; 3%-ig terjedő bírságok egyéb kötelezettségek megszegése esetén; és 1,5%-ig terjedő bírságok a szabályozó hatóságoknak nyújtott helytelen információkért.

A törvény egy másik fontos része az úgynevezett általános célú mesterséges intelligenciák (GPAI) fejlesztőire vonatkozik. Az EU itt is kockázatalapú megközelítést alkalmazott, és a legtöbb GPAI-fejlesztőre csak enyhe átláthatósági követelmények vonatkoznak. Csak a legerősebb modellek egy részhalmazától várják el, hogy kockázatértékelést és kockázatcsökkentő intézkedéseket tegyen. Hogy pontosan mit kell majd tenniük a GPAI-fejlesztőknek ahhoz, hogy megfeleljenek a mesterséges intelligenciáról szóló törvénynek, azt még tárgyalják, mivel a gyakorlati kódexek kidolgozása még várat magára. A hét elején az AI Office, a stratégiai felügyeletet és az MI-ökoszisztéma kiépítését végző szerv konzultációt indított és felhívást tett közzé a szabályalkotási folyamatban való részvételre, és közölte, hogy várhatóan 2025 áprilisában véglegesíti a kódexeket.

A múlt hónap végén az OpenAI, a ChatGPT alapjául szolgáló GPT nagy nyelvi modell gyártója azt közölte, hogy várhatóan "szorosan együttműködik az EU AI Office és más érintett hatóságokkal az új törvény végrehajtása során az elkövetkező hónapokban". Ez magában foglalja a technikai dokumentáció és egyéb útmutatók összeállítását a GPAI-modellek szolgáltatói és alkalmazói számára. "Ha az Ön szervezete megpróbálja meghatározni, hogyan feleljen meg a mesterséges intelligenciáról szóló törvénynek, először is határozza meg, hogy milyen GPAI és egyéb MI-rendszereket használ, határozza meg, hogy ezek hogyan vannak besorolva, és fontolja meg, hogy milyen kötelezettségek következnek a felhasználási eseteiből" - közölte az OpenAI, amely saját megfelelési útmutatást kínál az MI-fejlesztőknek. "Azt is meg kell határoznia, hogy az MI-rendszerek tekintetében szolgáltatónak vagy telepítőnek minősül-e. Ezek a kérdések összetettek lehetnek, ezért ha kérdései vannak, forduljon jogi tanácsadóhoz".