SG.hu·

Hatalmas próbatétel előtt áll az Nvidia az MI eddigi legnagyobb átalakulása miatt

Az MI modellek futtatásának robbanásszerű növekedése alapjaiban alakítja át a chipipart és új kihívások elé állítja a világ legnagyobb félvezető vállalatát.

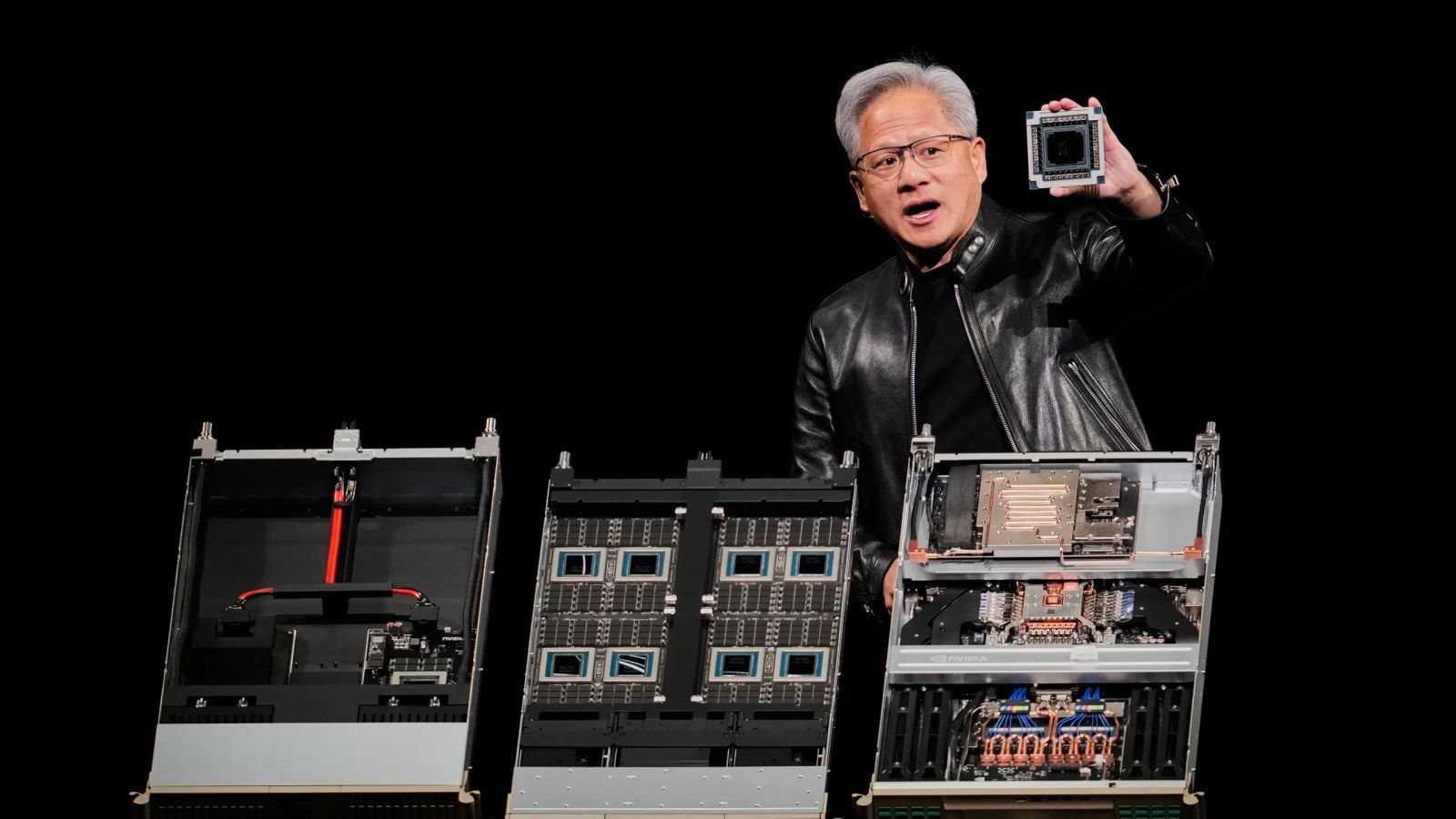

Minden tavasszal szoftvermérnökök ezrei gyűlnek össze a kaliforniai San Jose városában, hogy megcsodálják a legújabb, rendkívül gyors számítógépes processzorokat, és programozási workshopokon vegyenek részt az Nvidia éves fejlesztői konferenciáján. Az esemény neve GTC, amely a GPU Technology Conference rövidítése. Lehet azonban, hogy hamarosan új névre lesz szüksége. A hétfőn kezdődött esemény az idei évben először nem a GPU-kra, vagyis a grafikus feldolgozóegységekre összpontosít. Ezek azok a különlegesen gyors és nagy teljesítményű chipek, amelyekre építve az Nvidia hatalmas számítástechnikai birodalmat hozott létre, és amelyek révén a világ legnagyobb tőzsdén jegyzett vállalatává vált.

A beszélgetések sokkal inkább az úgynevezett következtetésekről szólnak. Ez az a számítási folyamat, amely az MI modellek futtatásához szükséges, és amely lehetővé teszi, hogy azok válaszoljanak a felhasználók kérdéseire. Ennek oka, hogy a mesterséges intelligencia iparága egyértelműen új szakaszba lépett. Az Nvidia ügyfeleit ma már kevésbé foglalkoztatja a nagy MI modellek betanítása, amelyben a GPU-k a legerősebbek, és sokkal inkább az érdekli őket, miként lehet ezeket futtatni, illetve hogyan lehet jelentős profitot termelni a végfelhasználóktól. A következtetési számítás eltérő hardverösszeállítást igényel, mint a betanításra optimalizált chipek. Többek között jobb energiahatékonyságra, gyorsabb összeköttetésekre és nagyobb sávszélességű memóriára van szükség.

Jensen Huang, az Nvidia vezérigazgatója már egy ideje azt hangoztatja, hogy 2026 az az év, amikor a következtetés egy időre uralni fogja az MI világát. Egy március 4-i befektetői konferencián elismerte, hogy „az a fordulópont, amelyet most látunk, valójában már jó ideje mindenki előtt ott volt, és alapvetően arról szól, hogy az MI képes fájlokat használni, fájlokhoz hozzáférni és eszközöket alkalmazni”. Ezek a funkciók, amelyeket összefoglaló néven ügynökalapú MI-nek neveznek, szinte teljes mértékben következtetési számításra támaszkodnak. Ugyanakkor központi szerepet játszanak abban a meggyőződésben, hogy az MI alapjaiban fogja átalakítani a világgazdaságot.

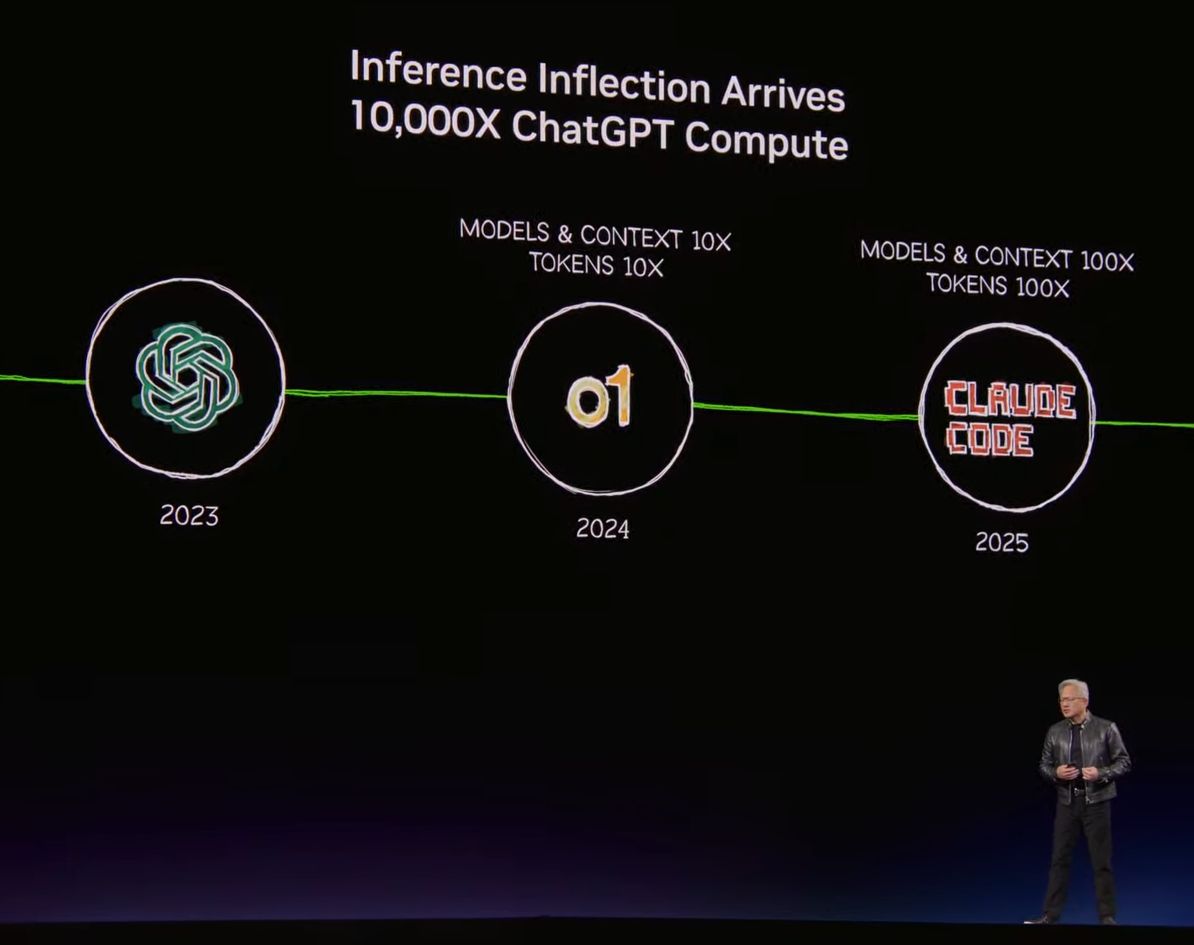

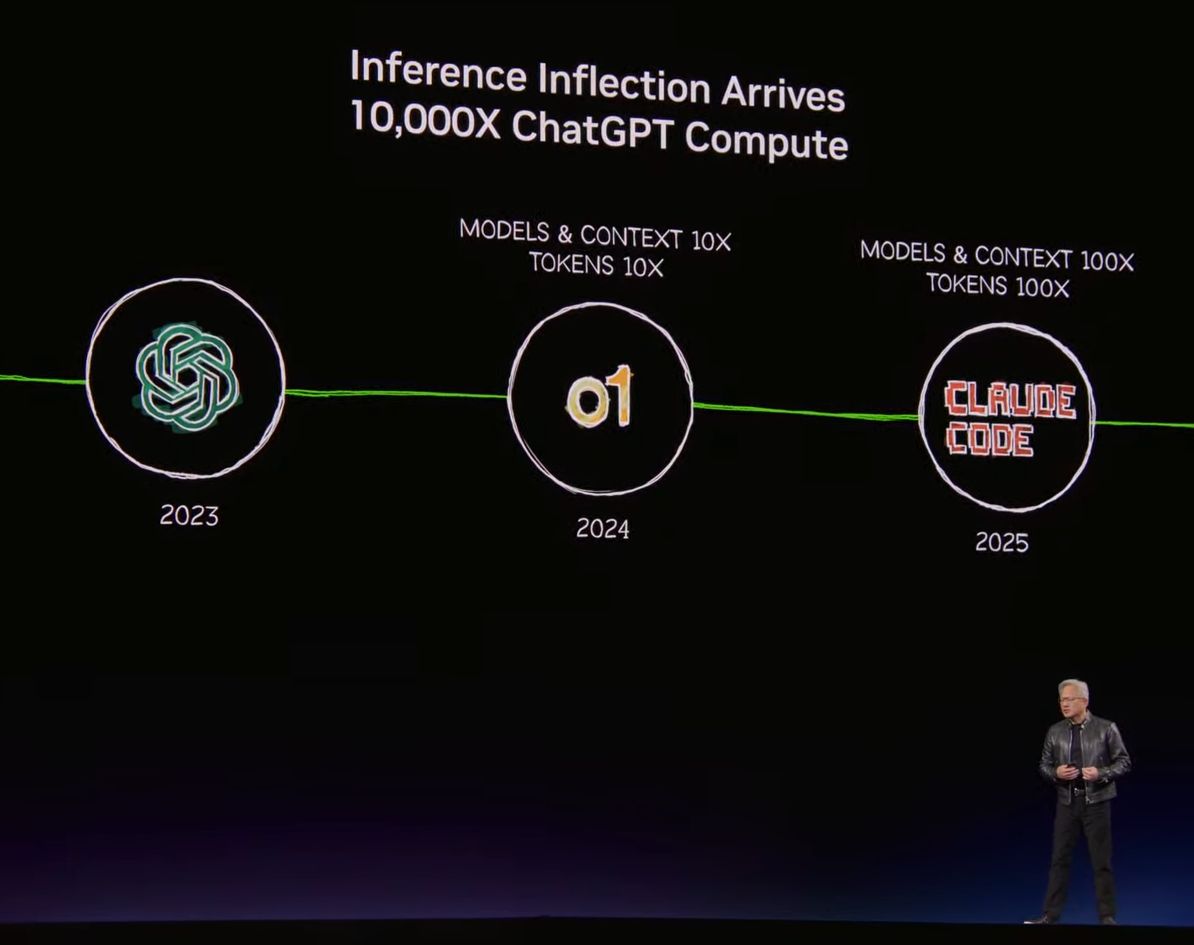

Az ilyen ügynökök képességeinek gyors fejlődése hatalmas növekedést idéz elő a számítási teljesítmény iránti keresletben. Olyan vállalatok, mint az OpenAI és az Anthropic - amelyek rendre a Codex és a Claude Code nevű népszerű kódoló ügynököket működtetik - ma már ezerszer több úgynevezett következtetési tokent állítanak elő, mint korábban. A token a generatív MI rendszerek adatkiadásának alapvető mérési egysége.

A következtetés kora az a korszak, amelyre minden méretű technológiai vállalat régóta vár. Ebben az időszakban az MI számítástechnika gazdasági modellje elméletileg veszteségesből nyereségessé válhat - feltéve, hogy a szükséges számítási kapacitás biztosításának költsége elég alacsonyan tartható. Az MI vállalatok most kezdenek kilépni abból a növekedési szakaszból, amelyben hatalmas összegeket fektettek be a modellek betanításához szükséges infrastruktúrába, például az Nvidia legújabb GPU-inak milliós nagyságrendű megvásárlásába, különösen a Hopper és a Blackwell generációkból. Emellett több százmillió rendszeres felhasználót is sikerült vonzaniuk. Most azonban egyre inkább azon dolgoznak, hogy bevételt termeljenek termékeikből, például előfizetési díjak révén vagy az intelligenciafogyasztás mérése alapján.

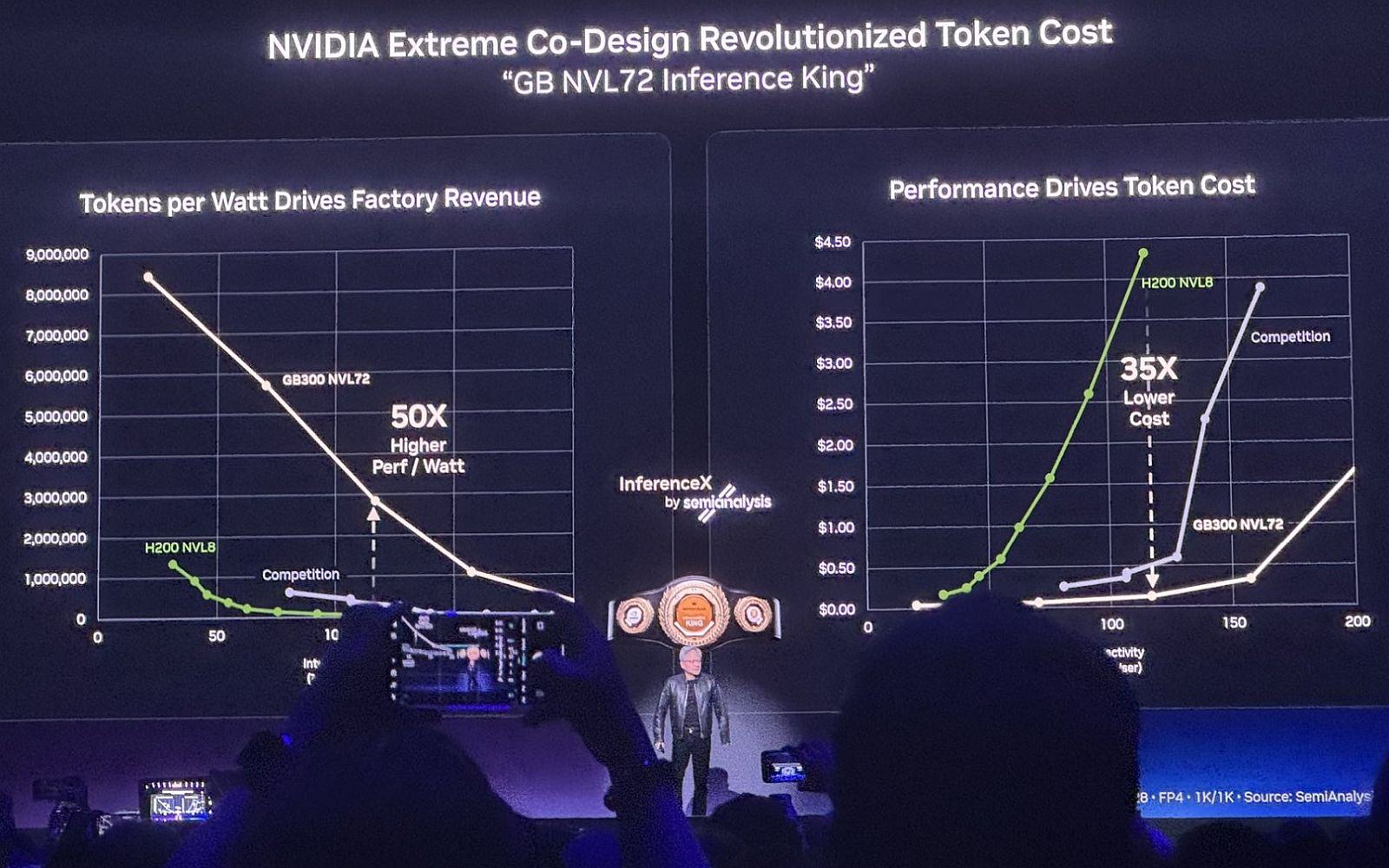

„Nagyon fontos felismerni, hogy a következtetés ma már bevételt jelent az ügyfeleink számára, mert az ügynökök rengeteg tokent generálnak, és az eredmények rendkívül hatékonyak” - mondta Huang az Nvidia legutóbbi eredménybeszámoló konferenciáján. „Sokkal nagyobb sebességgel kell következtetést végeznünk, és amikor ezt ilyen tempóban tesszük, miközben minden token pénzzé válik, az közvetlenül bevétellé alakul.” Az Nvidia számára most az jelenti a kihívást, hogy a legsikeresebb termékei kevésbé vonzóak következtetési számításra, mint betanításra. A felhasználók szerint a vállalat Grace Blackwell szerverei hatalmas mennyiségű energiát fogyasztanak, és nem rendelkeznek elegendő memóriával ahhoz, hogy az MI modellek gyorsan és hatékonyan válaszoljanak a felhasználók kérdéseire.

„Az Nvidia most egy furcsa pillanatban van” - mondta Paul Kedrosky kockázati befektető és a Massachusetts Institute of Technology kutatója. „Jensen hosszú ideig azt mondta, hogy nincs szükség különálló, dedikált következtetési chipekre, egyszerűen rá lehet dobni egy Blackwellt a feladatra. De ez a hajó már elment, és rengeteg új versenytárs jelent meg.” Kedrosky szerint az Nvidia bruttó árrése, amely a legutóbbi negyedévben 73 százalék volt, szükségszerűen csökkenni fog két okból. Az első az, hogy a következtetési számítás üzleti modellje nagy hangsúlyt helyez a hatékonyságra és a végtermék előállítási költségének csökkentésére. A fogyasztók számára ez a végtermék az MI eszközök sora. Az ezeket kiszolgáló hardver nem lehet túl drága, különben az azt értékesítő vállalatok - akár közvetlenül, akár közvetítőként - nem tudnak profitot termelni.

A második ok az, hogy egyre több vállalat versenyez az ügyfelekért a következtetési számítás piacán, mert több chipgyártó is rájött, miként lehet ezt olcsóbban megvásárolható és működtethető chipekkel biztosítani. Az Nvidia úgy vált az első négyezer milliárd dollár értékű vállalattá, hogy a szilíciumipar Ferrarijának számító gyors, erős és drága chipeket értékesített. Most azonban a világ inkább Priusokat és Model Y járműveket szeretne. „Ez az egész következtetési hullám rendkívül fenyegető Jensen számára, mert minden az energiahatékonyságról szól” - mondta Kedrosky. „Kétségbeesetten próbál módot találni arra, hogy a vállalat sikereit a következtetési számítás világára is kiterjessze.”

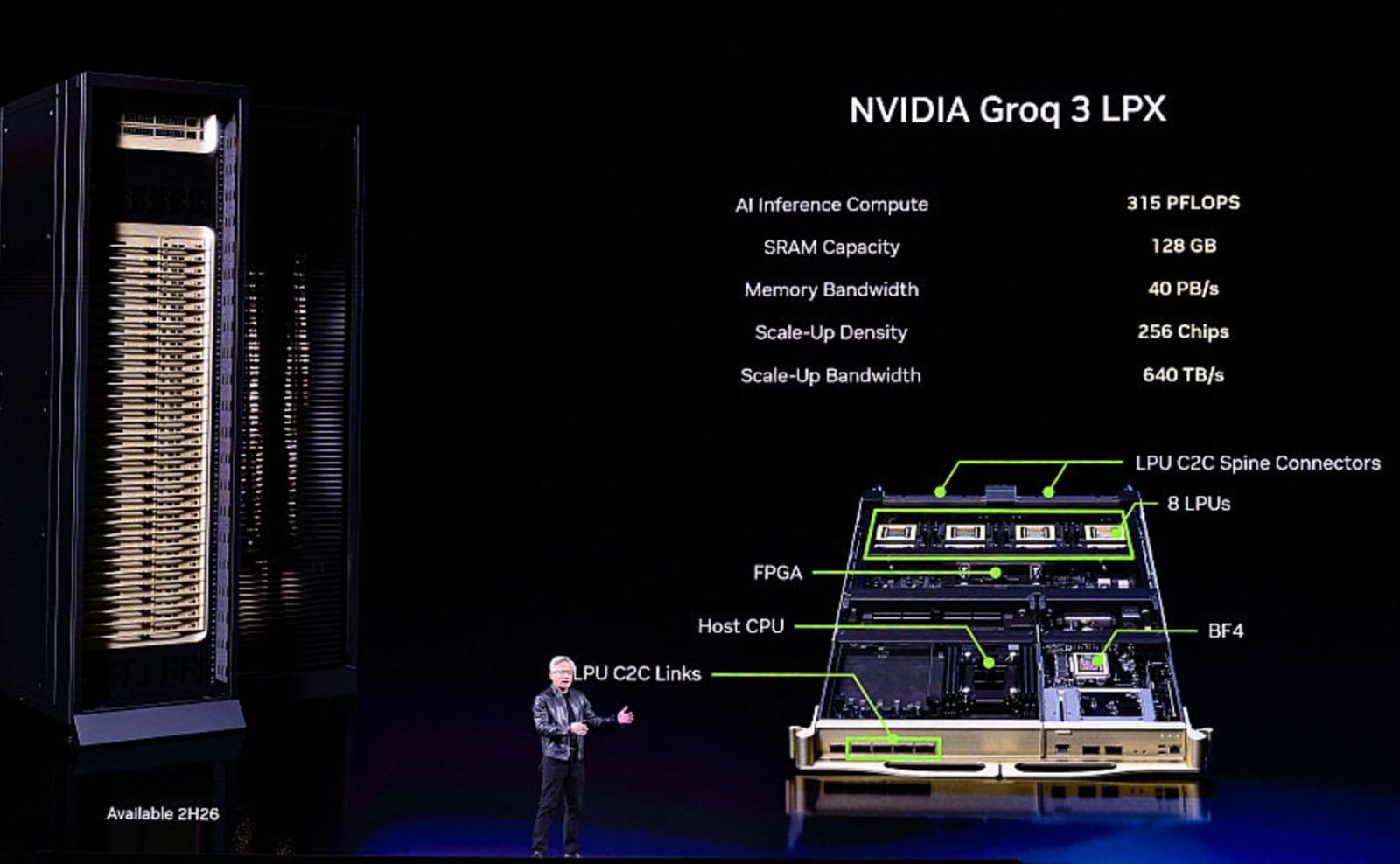

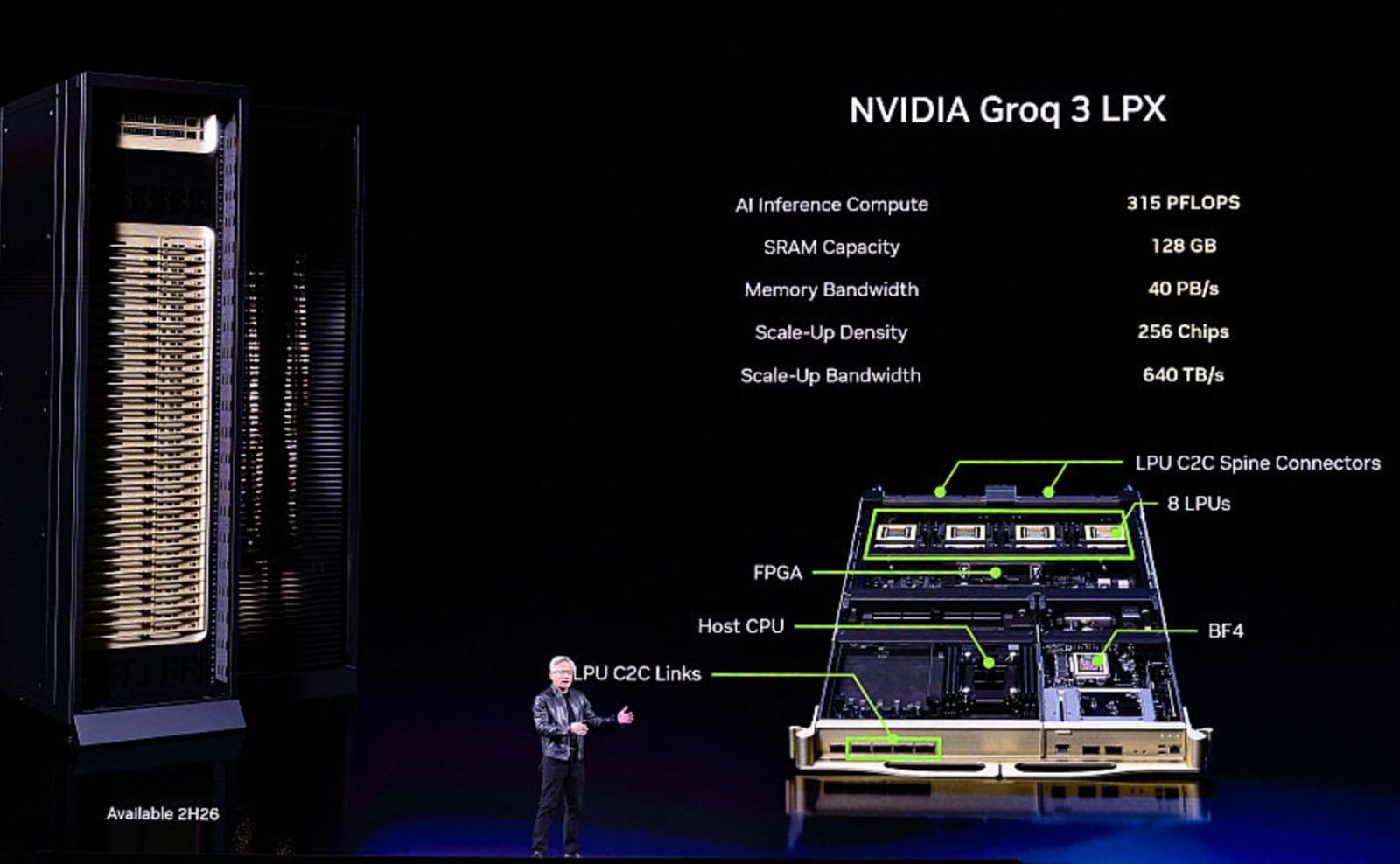

Decemberben az Nvidia 20 milliárd dollárt fizetett azért, hogy licencelje a Groq chiptechnológiáját, és elcsábítsa a startup legfontosabb szakembereit. A Groq egy új típusú chipet tervezett, amelyet nyelvfeldolgozó egységnek neveznek, és amely különösen alkalmas modellek futtatására. Az Nvidia ezen a héten a GTC konferencián mutatja be első olyan számítási platformját, amely Groq chipeket használ. Ez egy olyan szerver lesz, amely a vállalat új Rubin GPU-jának módosított változatát egy kifejezetten következtetési számításra optimalizált Groq processzorral kombinálja.

Más jelek is arra utalnak, hogy az Nvidia kezd eltávolodni attól a stratégiától, amely kizárólag a GPU-kra épült, és egyre inkább a következtetési számítási szolgáltatások felé fordul. Februárban a Meta Platforms bejelentette, hogy több ezer darabot telepít az Nvidia Vera nevű CPU-iból, vagyis központi feldolgozóegységeiből az MI adatközpontjaiban. Ez az első jelentős olyan telepítés, amely Nvidia MI rendszereket használ, de nem tartalmaz GPU-kat. Egyre szélesebb körben ismerik fel, hogy a következtetési számítás CPU-k segítségével is megoldható, és nem feltétlenül igényli az Nvidia csúcskategóriás chipeit.

Az Nvidia olyan új számítási megoldások bemutatását is tervezi, amelyek több CPU-ra épülnek, és nem kapcsolódnak GPU-khoz, hasonlóan ahhoz a modellhez, amelyet a Meta is tervez alkalmazni. Eközben az Intel - a nehézségekkel küzdő chipgyártó, amely az elmúlt években nagyrészt lemaradt az MI számítástechnikai hullámról - egy jelentős partnerségi bejelentést ígér az Nvidia-val a rendezvény keretében. Az Intel hosszú ideje a CPU-k egyik legnagyobb gyártója, de a GPU-k piacán nincs komoly jelenléte. „A legjobb minőségű modellek egyre kevésbé működőképesek a jelenlegi infrastruktúrával” - mondta Shahriar Rabii, a Google és a Meta egykori vezetője, valamint a Majestic Labs chipstartup társalapítója, amely az energiahatékonyság növelésére és a következtetési számítás memóriaproblémáinak megoldására összpontosít.

Az Nvidia hatalmas, 20 milliárd dolláros licencmegállapodása a Groq vállalattal felgyorsult, miután egyik legnagyobb ügyfele, a ChatGPT fejlesztője, az OpenAI 10 milliárd dolláros megállapodást kötött a Cerebras chipstartuppal. A Cerebras olyan drága chipeket tervez, amelyek állítása szerint a leggyorsabb következtetési processzorok a piacon. A vállalat a múlt héten bejelentette, hogy új ügyfélként csatlakozott hozzá az Amazon Web Services, a világ legnagyobb felhőszolgáltatója, ami tovább szűkíti az Nvidia mozgásterét.

Andrew Feldman, a Cerebras vezérigazgatója blogbejegyzéseiben hónapok óta kritizálja az Nvidiát és Huángot. A LinkedInen azt írta, hogy az Nvidia valószínűleg lemarad a versenyben a következtetési számítás globális ellátásáért folyó versenyben. Ennek egyik oka az, hogy az Nvidia saját fejlesztésű programozási könyvtára, a CUDA elsősorban a modellek betanításához szükséges, nem pedig a futtatásukhoz. „A következtetés világában nincs CUDA védőárok” - mondta Feldman egy interjúban. „Nyilvánvalóan nem akarták elveszíteni az OpenAI gyors következtetési üzletét, de mi elvettük tőlük.”

Tom Burke, az Egyesült Királyságban működő Nscale felhőszolgáltató bevételi igazgatója, amely jelenleg kizárólag Nvidia chipeket használ, azt mondta, hogy a következtetés térnyerése teljesen átalakítja a számítási kapacitás értékesítésének piacát. Szerinte a közeljövőben egyre több MI vállalat fogja diverzifikálni chipbeszállítóit. „Ha tizenkét hónappal ezelőtt néztük volna ezt a piacot, a szükséges számítási teljesítmény körülbelül kilencven százaléka betanításra és tíz százaléka következtetésre ment. Szerintem az év végére ez az arány meg fog fordulni” - mondta Burke. „Kötelességünk újragondolni a dolgokat az ügyfeleink számára, és a lehető legrugalmasabbnak lenni.”

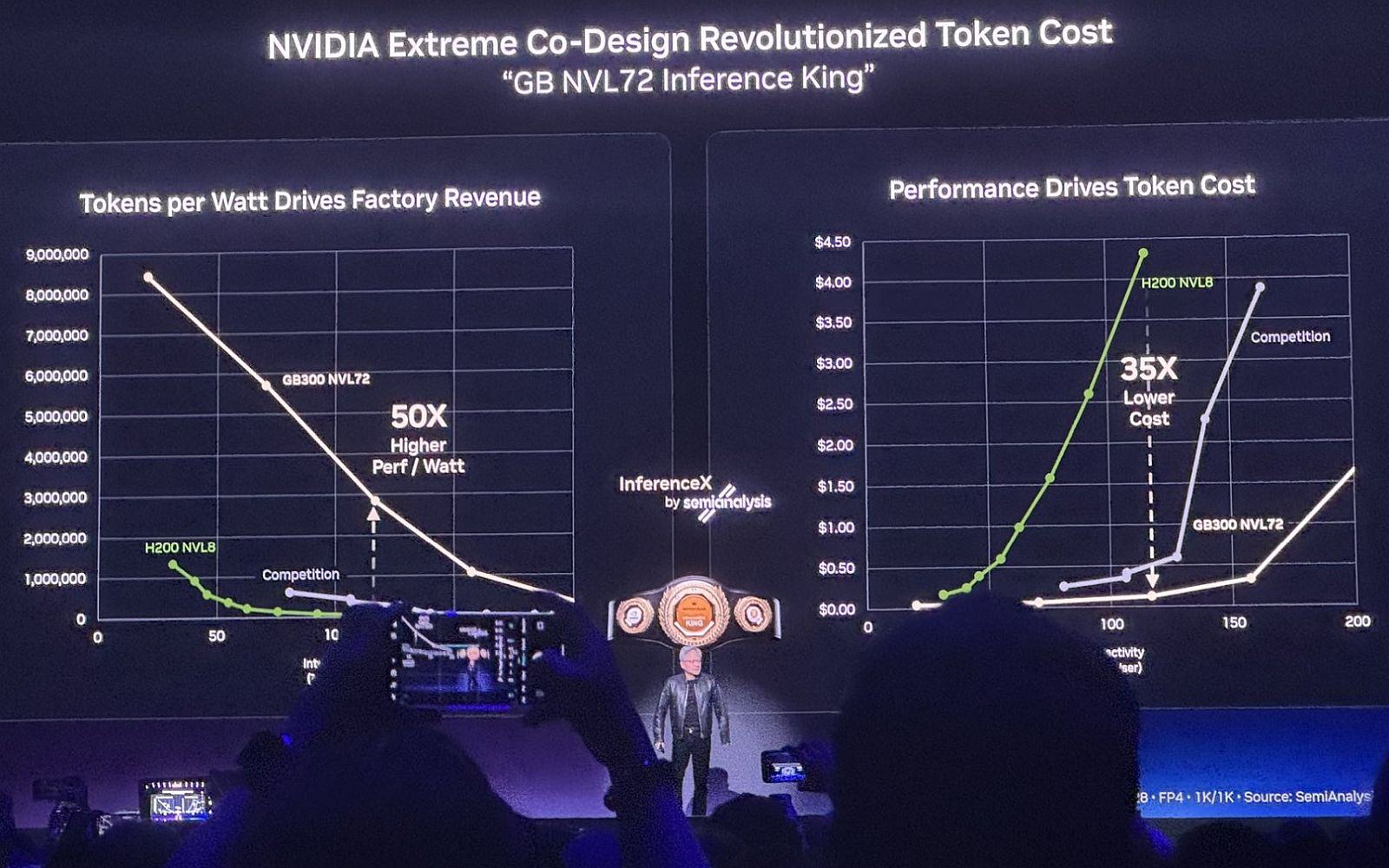

Az, hogy az Nvidia mennyire marad előnyben az MI infrastruktúráért folyó versenyben, nagyrészt attól függ, mennyire képes termékfejlesztési stratégiáját a betanításról a következtetés felé átállítani. Ha a Groq technológiájával fejlesztett új chipek elég gyorsnak, energiahatékonynak és megfizethetőnek bizonyulnak ahhoz, hogy uralják a versenyt, akkor a vállalat valószínűleg továbbra is piacvezető marad. A vállalat erre építi a jövőjét. Colette Kress, a vállalat pénzügyi igazgatója egy közelmúltbeli interjúban azt mondta, hogy az ügynökalapú MI munkaterhelések már most jelentős hajtóerőt jelentenek az Nvidia bevételnövekedésében, és véleménye szerint a vállalat chipjei belátható időn belül továbbra is dominálni fognak. „Jelenleg mi vagyunk a következtetés királyai” - mondta Kress.

Minden tavasszal szoftvermérnökök ezrei gyűlnek össze a kaliforniai San Jose városában, hogy megcsodálják a legújabb, rendkívül gyors számítógépes processzorokat, és programozási workshopokon vegyenek részt az Nvidia éves fejlesztői konferenciáján. Az esemény neve GTC, amely a GPU Technology Conference rövidítése. Lehet azonban, hogy hamarosan új névre lesz szüksége. A hétfőn kezdődött esemény az idei évben először nem a GPU-kra, vagyis a grafikus feldolgozóegységekre összpontosít. Ezek azok a különlegesen gyors és nagy teljesítményű chipek, amelyekre építve az Nvidia hatalmas számítástechnikai birodalmat hozott létre, és amelyek révén a világ legnagyobb tőzsdén jegyzett vállalatává vált.

A beszélgetések sokkal inkább az úgynevezett következtetésekről szólnak. Ez az a számítási folyamat, amely az MI modellek futtatásához szükséges, és amely lehetővé teszi, hogy azok válaszoljanak a felhasználók kérdéseire. Ennek oka, hogy a mesterséges intelligencia iparága egyértelműen új szakaszba lépett. Az Nvidia ügyfeleit ma már kevésbé foglalkoztatja a nagy MI modellek betanítása, amelyben a GPU-k a legerősebbek, és sokkal inkább az érdekli őket, miként lehet ezeket futtatni, illetve hogyan lehet jelentős profitot termelni a végfelhasználóktól. A következtetési számítás eltérő hardverösszeállítást igényel, mint a betanításra optimalizált chipek. Többek között jobb energiahatékonyságra, gyorsabb összeköttetésekre és nagyobb sávszélességű memóriára van szükség.

Jensen Huang, az Nvidia vezérigazgatója már egy ideje azt hangoztatja, hogy 2026 az az év, amikor a következtetés egy időre uralni fogja az MI világát. Egy március 4-i befektetői konferencián elismerte, hogy „az a fordulópont, amelyet most látunk, valójában már jó ideje mindenki előtt ott volt, és alapvetően arról szól, hogy az MI képes fájlokat használni, fájlokhoz hozzáférni és eszközöket alkalmazni”. Ezek a funkciók, amelyeket összefoglaló néven ügynökalapú MI-nek neveznek, szinte teljes mértékben következtetési számításra támaszkodnak. Ugyanakkor központi szerepet játszanak abban a meggyőződésben, hogy az MI alapjaiban fogja átalakítani a világgazdaságot.

Az ilyen ügynökök képességeinek gyors fejlődése hatalmas növekedést idéz elő a számítási teljesítmény iránti keresletben. Olyan vállalatok, mint az OpenAI és az Anthropic - amelyek rendre a Codex és a Claude Code nevű népszerű kódoló ügynököket működtetik - ma már ezerszer több úgynevezett következtetési tokent állítanak elő, mint korábban. A token a generatív MI rendszerek adatkiadásának alapvető mérési egysége.

A következtetés kora az a korszak, amelyre minden méretű technológiai vállalat régóta vár. Ebben az időszakban az MI számítástechnika gazdasági modellje elméletileg veszteségesből nyereségessé válhat - feltéve, hogy a szükséges számítási kapacitás biztosításának költsége elég alacsonyan tartható. Az MI vállalatok most kezdenek kilépni abból a növekedési szakaszból, amelyben hatalmas összegeket fektettek be a modellek betanításához szükséges infrastruktúrába, például az Nvidia legújabb GPU-inak milliós nagyságrendű megvásárlásába, különösen a Hopper és a Blackwell generációkból. Emellett több százmillió rendszeres felhasználót is sikerült vonzaniuk. Most azonban egyre inkább azon dolgoznak, hogy bevételt termeljenek termékeikből, például előfizetési díjak révén vagy az intelligenciafogyasztás mérése alapján.

„Nagyon fontos felismerni, hogy a következtetés ma már bevételt jelent az ügyfeleink számára, mert az ügynökök rengeteg tokent generálnak, és az eredmények rendkívül hatékonyak” - mondta Huang az Nvidia legutóbbi eredménybeszámoló konferenciáján. „Sokkal nagyobb sebességgel kell következtetést végeznünk, és amikor ezt ilyen tempóban tesszük, miközben minden token pénzzé válik, az közvetlenül bevétellé alakul.” Az Nvidia számára most az jelenti a kihívást, hogy a legsikeresebb termékei kevésbé vonzóak következtetési számításra, mint betanításra. A felhasználók szerint a vállalat Grace Blackwell szerverei hatalmas mennyiségű energiát fogyasztanak, és nem rendelkeznek elegendő memóriával ahhoz, hogy az MI modellek gyorsan és hatékonyan válaszoljanak a felhasználók kérdéseire.

„Az Nvidia most egy furcsa pillanatban van” - mondta Paul Kedrosky kockázati befektető és a Massachusetts Institute of Technology kutatója. „Jensen hosszú ideig azt mondta, hogy nincs szükség különálló, dedikált következtetési chipekre, egyszerűen rá lehet dobni egy Blackwellt a feladatra. De ez a hajó már elment, és rengeteg új versenytárs jelent meg.” Kedrosky szerint az Nvidia bruttó árrése, amely a legutóbbi negyedévben 73 százalék volt, szükségszerűen csökkenni fog két okból. Az első az, hogy a következtetési számítás üzleti modellje nagy hangsúlyt helyez a hatékonyságra és a végtermék előállítási költségének csökkentésére. A fogyasztók számára ez a végtermék az MI eszközök sora. Az ezeket kiszolgáló hardver nem lehet túl drága, különben az azt értékesítő vállalatok - akár közvetlenül, akár közvetítőként - nem tudnak profitot termelni.

A második ok az, hogy egyre több vállalat versenyez az ügyfelekért a következtetési számítás piacán, mert több chipgyártó is rájött, miként lehet ezt olcsóbban megvásárolható és működtethető chipekkel biztosítani. Az Nvidia úgy vált az első négyezer milliárd dollár értékű vállalattá, hogy a szilíciumipar Ferrarijának számító gyors, erős és drága chipeket értékesített. Most azonban a világ inkább Priusokat és Model Y járműveket szeretne. „Ez az egész következtetési hullám rendkívül fenyegető Jensen számára, mert minden az energiahatékonyságról szól” - mondta Kedrosky. „Kétségbeesetten próbál módot találni arra, hogy a vállalat sikereit a következtetési számítás világára is kiterjessze.”

Decemberben az Nvidia 20 milliárd dollárt fizetett azért, hogy licencelje a Groq chiptechnológiáját, és elcsábítsa a startup legfontosabb szakembereit. A Groq egy új típusú chipet tervezett, amelyet nyelvfeldolgozó egységnek neveznek, és amely különösen alkalmas modellek futtatására. Az Nvidia ezen a héten a GTC konferencián mutatja be első olyan számítási platformját, amely Groq chipeket használ. Ez egy olyan szerver lesz, amely a vállalat új Rubin GPU-jának módosított változatát egy kifejezetten következtetési számításra optimalizált Groq processzorral kombinálja.

Más jelek is arra utalnak, hogy az Nvidia kezd eltávolodni attól a stratégiától, amely kizárólag a GPU-kra épült, és egyre inkább a következtetési számítási szolgáltatások felé fordul. Februárban a Meta Platforms bejelentette, hogy több ezer darabot telepít az Nvidia Vera nevű CPU-iból, vagyis központi feldolgozóegységeiből az MI adatközpontjaiban. Ez az első jelentős olyan telepítés, amely Nvidia MI rendszereket használ, de nem tartalmaz GPU-kat. Egyre szélesebb körben ismerik fel, hogy a következtetési számítás CPU-k segítségével is megoldható, és nem feltétlenül igényli az Nvidia csúcskategóriás chipeit.

Az Nvidia olyan új számítási megoldások bemutatását is tervezi, amelyek több CPU-ra épülnek, és nem kapcsolódnak GPU-khoz, hasonlóan ahhoz a modellhez, amelyet a Meta is tervez alkalmazni. Eközben az Intel - a nehézségekkel küzdő chipgyártó, amely az elmúlt években nagyrészt lemaradt az MI számítástechnikai hullámról - egy jelentős partnerségi bejelentést ígér az Nvidia-val a rendezvény keretében. Az Intel hosszú ideje a CPU-k egyik legnagyobb gyártója, de a GPU-k piacán nincs komoly jelenléte. „A legjobb minőségű modellek egyre kevésbé működőképesek a jelenlegi infrastruktúrával” - mondta Shahriar Rabii, a Google és a Meta egykori vezetője, valamint a Majestic Labs chipstartup társalapítója, amely az energiahatékonyság növelésére és a következtetési számítás memóriaproblémáinak megoldására összpontosít.

Az Nvidia hatalmas, 20 milliárd dolláros licencmegállapodása a Groq vállalattal felgyorsult, miután egyik legnagyobb ügyfele, a ChatGPT fejlesztője, az OpenAI 10 milliárd dolláros megállapodást kötött a Cerebras chipstartuppal. A Cerebras olyan drága chipeket tervez, amelyek állítása szerint a leggyorsabb következtetési processzorok a piacon. A vállalat a múlt héten bejelentette, hogy új ügyfélként csatlakozott hozzá az Amazon Web Services, a világ legnagyobb felhőszolgáltatója, ami tovább szűkíti az Nvidia mozgásterét.

Andrew Feldman, a Cerebras vezérigazgatója blogbejegyzéseiben hónapok óta kritizálja az Nvidiát és Huángot. A LinkedInen azt írta, hogy az Nvidia valószínűleg lemarad a versenyben a következtetési számítás globális ellátásáért folyó versenyben. Ennek egyik oka az, hogy az Nvidia saját fejlesztésű programozási könyvtára, a CUDA elsősorban a modellek betanításához szükséges, nem pedig a futtatásukhoz. „A következtetés világában nincs CUDA védőárok” - mondta Feldman egy interjúban. „Nyilvánvalóan nem akarták elveszíteni az OpenAI gyors következtetési üzletét, de mi elvettük tőlük.”

Tom Burke, az Egyesült Királyságban működő Nscale felhőszolgáltató bevételi igazgatója, amely jelenleg kizárólag Nvidia chipeket használ, azt mondta, hogy a következtetés térnyerése teljesen átalakítja a számítási kapacitás értékesítésének piacát. Szerinte a közeljövőben egyre több MI vállalat fogja diverzifikálni chipbeszállítóit. „Ha tizenkét hónappal ezelőtt néztük volna ezt a piacot, a szükséges számítási teljesítmény körülbelül kilencven százaléka betanításra és tíz százaléka következtetésre ment. Szerintem az év végére ez az arány meg fog fordulni” - mondta Burke. „Kötelességünk újragondolni a dolgokat az ügyfeleink számára, és a lehető legrugalmasabbnak lenni.”

Az, hogy az Nvidia mennyire marad előnyben az MI infrastruktúráért folyó versenyben, nagyrészt attól függ, mennyire képes termékfejlesztési stratégiáját a betanításról a következtetés felé átállítani. Ha a Groq technológiájával fejlesztett új chipek elég gyorsnak, energiahatékonynak és megfizethetőnek bizonyulnak ahhoz, hogy uralják a versenyt, akkor a vállalat valószínűleg továbbra is piacvezető marad. A vállalat erre építi a jövőjét. Colette Kress, a vállalat pénzügyi igazgatója egy közelmúltbeli interjúban azt mondta, hogy az ügynökalapú MI munkaterhelések már most jelentős hajtóerőt jelentenek az Nvidia bevételnövekedésében, és véleménye szerint a vállalat chipjei belátható időn belül továbbra is dominálni fognak. „Jelenleg mi vagyunk a következtetés királyai” - mondta Kress.