SG.hu·

Kiderült mire használják az emberek a képgenerátorokat

Egy ideig letölthető volt egy MI-képgeneráló cég adatbázisa, amely több, mint 95 ezer képet tartalmazott. Ezek megdöbbentően nagy része volt pornográf tartalmú, és ezek közül jónéhány valószínűleg illegális. A cég törölte a weboldalait.

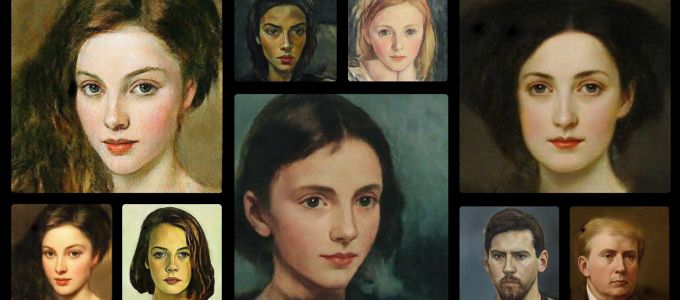

MI által generált képek tízezrei, köztük algoritmus által generált, gyermekek szexuális zaklatását ábrázoló anyagok voltak egy ideig bárki számára elérhetőek az interneten. Egy MI-képgeneráló cég nyílt adatbázisa több mint 95 000 rekordot tartalmazott, köztük a promptnak megadott parancsokat és olyan hírességek képeit, mint Ariana Grande, a Kardashianok és Beyoncé, akiket úgy alakítottak át, hogy gyerekeknek nézzenek ki. Az adatbázist Jeremiah Fowler biztonsági kutató fedezte fel, és az a dél-koreai székhelyű GenNomis weboldalhoz kapcsolódik. A weboldal és anyavállalata, az AI-Nomis számos képgeneráló és chatbot eszközt készített. Több mint 45 GB adat - amely többnyire MI-képekből állt - került nyilvánosságra.

A nyilvánosságra hozott adatok bepillantást engednek abba, hogy a mesterséges intelligencia képgeneráló eszközei hogyan használhatók a felnőttek és a gyermekek szexuális zaklatását bemutató anyagok (CSAM, Child Sexual Abuse Material) nagyon káros és valószínűleg beleegyezés nélküli szexuális tartalmának létrehozására. (Kutatók, áldozatok szószólói, újságírók, technológiai cégek és mások az elmúlt évtizedben nagyrészt kivezették a gyermekpornográfia kifejezést a CSAM javára). Az elmúlt években tucatnyi „deepfake” és „nudify” weboldal, bot és alkalmazás szaporodott el, amelyek nők és lányok ezreit vették célba káros képekkel és videókkal. Mindez a mesterséges intelligencia által generált CSAM-ok megugrása mellett történt. "Ez rendkívül veszélyes” - mondja Fowler az adatokról. "Ha biztonsági kutatóként vagy szülőként nézzük, ez félelmetes. És félelmetes az is, hogy milyen könnyű létrehozni ezt a tartalmat.”

Fowler március elején fedezte fel a nyitott könyvtárat - tehát az adatbázis nem volt jelszóval védett vagy titkosított -, és gyorsan jelentette a GenNomisnak és az AI-Nomisnak, rámutatva, hogy MI CSAM-ot tartalmaz. Fowler szerint a GenNomis gyorsan lezárta az adatbázist, de nem válaszolt, és nem vette fel vele a kapcsolatot a felfedezésekkel kapcsolatban. Néhány órával azután azonban, hogy újságírók kapcsolatba léptek a szervezetekkel, mindkét vállalat honlapja leállt, a GenNomis honlapja most 404-es hibaüzenetet ad vissza.

„Ez a példa is mutatja - ismét -, hogy milyen nyugtalanító mértékben növekszik a mesterséges intelligencia piaca, amely lehetővé teszi az ilyen bántalmazó képek létrehozását” - mondja Clare McGlynn, az Egyesült Királyságban található Durham Egyetem jogi professzora, aki az online és képalapú visszaélésekre szakosodott. „Ez arra kell, hogy emlékeztessen minket, hogy a CSAM létrehozása, birtoklása és terjesztése nem ritka, és nem csak torzult egyéneknek tulajdonítható”.

A GenNomis több különböző mesterséges intelligencia eszközt is közzétett honlapján. Ezek között volt egy képgenerátor, amely lehetővé tette, hogy az emberek beírják az általuk létrehozni kívánt képekhez a parancsokat, vagy feltöltsenek egy képet, és mellékeljenek egy felszólítást a módosítására. Volt még rajta arccserélő eszköz, egy háttér eltávolító, valamint egy videókat képekké alakító alkalmazás. "A legzavaróbb dolgok a a gyermekeket tartalmazó képek voltak. Olyanokat láttunk, amelyeken egyértelműen hírességeket dolgoztak át gyermekké” - mondja Fowler. A kutató látott MI által generált képeket teljesen felöltözött fiatal lányokról is. Azt mondja, ezekben az esetekben nem világos, hogy a felhasznált arcok teljesen mesterséges intelligencia által generáltak-e, vagy valós képek alapján készültek.

Fowler szerint a CSAM mellett az adatbázisban felnőttekről készült, mesterséges intelligenciával generált pornográf képek, valamint kicserélt arcú képek is voltak. A fájlok között megfigyelt olyanokat, amelyek valódi emberek fotóinak tűntek, és amelyeket valószínűleg „kifejezetten meztelen vagy szexuális jellegű, mesterséges intelligencia által generált képek” létrehozásához használtak - mondja. „Tehát valódi képeket készítettek emberekről, és felcserélték az arcukat” - állítja néhány generált képről. "Ha képes voltam látni ezeket a képeket úgy, hogy csak az URL-címet adtam meg, az azt mutatja számomra, hogy nem tesznek meg minden szükséges lépést annak érdekében, hogy blokkolják ezt a tartalmat” - állítja Fowler az adatbázisról.

Amikor a GenNomis honlapja élesben működött, lehetővé tette a meztelen képek generálását. A honlapon és az MI modellek szekcióban sok kép szerepelt, amelyeken nők szexualizált képei voltak láthatóak - egyesek fotorealisztikusak, míg mások teljesen MI-generáltak vagy animált stílusban készültek. Tartalmazott egy NSFW galériát (Not Safe For Work) és egy „piacteret” is, ahol a felhasználók megoszthatták a képeket, és potenciálisan eladhatták az MI által generált fotókból álló albumokat. A weboldal szlogenje szerint az emberek korlátozás nélkül hozhatnak létre képeket és videókat; az oldal egy korábbi, 2024-es verziója szerint „cenzúrázatlan képeket” lehetett létrehozni.

A GenNomis felhasználói szabályzatában az állt, hogy csak „tiszteletteljes tartalom” engedélyezett, és csak a „kifejezett erőszak” és a gyűlöletbeszéd volt tilos. „A gyermekpornográfia és minden más illegális tevékenység szigorúan tilos a GenNomison” - áll a közösségi irányelvekben, amelyek szerint a tiltott tartalmakat közzétevő fiókok megszüntetésre kerülnek. Nem világos, hogy a GenNomis milyen mértékben használt moderációs eszközöket vagy rendszereket a mesterséges intelligencia által generált CSAM létrehozásának megakadályozására vagy tiltására. Néhány felhasználó tavaly a közösségi oldalára azt posztolta, hogy nem tudtak olyan képeket generálni, amelyeken emberek szexelnek, és hogy nem szexuális jellegű „sötét humor” miatt is blokkolták a parancsaikat. Egy másik fiók a közösségi oldalán azt írta, hogy a „NSFW” tartalmakkal foglalkozni kell, mivel „a szövetségiek megnézhetik”.

Henry Ajder deepfake szakértő és a Latent Space Advisory tanácsadó cég alapítója szerint még ha a káros és illegális tartalmak létrehozását nem is engedélyezte a vállalat, a weboldal márkajelzése - amely „korlátlan” képkészítésre és egy „NSFW” szekcióra hivatkozik - arra utal, hogy „egyértelmű kapcsolat állhat fenn az intim tartalmakkal, biztonsági intézkedések nélkül”. Ajder azt mondja, meglepődött, hogy az angol nyelvű weboldal egy dél-koreai szervezethez kapcsolódott. Tavaly az országot egy lányokat célzó, nem konszenzuális deepfake botrány sújtotta, és intézkedéseket hoztak a deepfake visszaélési hullám leküzdésére.

Ajder szerint nagyobb nyomást kell gyakorolni az ökoszisztéma minden olyan tagjára, amely lehetővé teszi, hogy a mesterséges intelligencia segítségével nem konszenzuális képeket hozzanak létre. „Minél több ilyet látunk, annál inkább a jogalkotókra, a technológiai platformokra, a webtárhely-szolgáltatókra és a fizetési szolgáltatókra hárul a kérdés. Mindazok, akik valamilyen formában, tudatosan vagy más módon - többnyire tudtukon kívül - elősegítik és lehetővé teszik, hogy ez megtörténjen” - mondja.

Fowler szerint az adatbázis olyan fájlokat is feltárt, amelyek mesterséges intelligencia-parancsokat tartalmaztak. A kutató szerint a feltárt adatok között nem szerepeltek felhasználói adatok, például nevek vagy jelszavak. A parancsokról készült képernyőfotókon olyan szavak használata látható, mint a „pici”, „lány”, és a családtagok közötti szexuális aktusokra való utalások. A felszólítások hírességek közötti szexuális aktusokat is tartalmaztak. "Nekem úgy tűnik, hogy a technológia megelőzte az irányelveket és az ellenőrzéseket” - mondja Fowler. „Jogi szempontból mindannyian tudjuk, hogy a gyermekekről készült explicit képek illegálisak, de ez nem akadályozta meg a technológiát abban, hogy ezeket a képeket létrehozza”.

Mivel a generatív mesterséges intelligencia rendszerek az elmúlt két évben jelentősen egyszerűsítették a képek létrehozásának és módosításának módját, az MI által generált CSAM-ok száma robbanásszerűen megnőtt. „A mesterséges intelligenciával generált, gyermekek szexuális zaklatását tartalmazó weboldalak száma 2023 óta több mint megnégyszereződött, és e szörnyű tartalmak fotórealizmusa is ugrásszerűen javul- mondja Derek Ray-Hill, az Internet Watch Foundation (IWF), az online CSAM ellen fellépő brit székhelyű nonprofit szervezet ideiglenes vezérigazgatója. Az IWF dokumentálta, hogy a bűnözők egyre gyakrabban készítenek mesterséges intelligencia által generált CSAM-okat, és fejlesztik az ezek létrehozásához használt módszereket. „A bűnözők számára jelenleg egyszerűen túl könnyű a mesterséges intelligenciát arra használni, hogy a gyermekekről szóló szexuális tartalmakat nagy mennyiségben és sebességgel generáljanak és terjesszenek” - mondja Ray-Hill.

MI által generált képek tízezrei, köztük algoritmus által generált, gyermekek szexuális zaklatását ábrázoló anyagok voltak egy ideig bárki számára elérhetőek az interneten. Egy MI-képgeneráló cég nyílt adatbázisa több mint 95 000 rekordot tartalmazott, köztük a promptnak megadott parancsokat és olyan hírességek képeit, mint Ariana Grande, a Kardashianok és Beyoncé, akiket úgy alakítottak át, hogy gyerekeknek nézzenek ki. Az adatbázist Jeremiah Fowler biztonsági kutató fedezte fel, és az a dél-koreai székhelyű GenNomis weboldalhoz kapcsolódik. A weboldal és anyavállalata, az AI-Nomis számos képgeneráló és chatbot eszközt készített. Több mint 45 GB adat - amely többnyire MI-képekből állt - került nyilvánosságra.

A nyilvánosságra hozott adatok bepillantást engednek abba, hogy a mesterséges intelligencia képgeneráló eszközei hogyan használhatók a felnőttek és a gyermekek szexuális zaklatását bemutató anyagok (CSAM, Child Sexual Abuse Material) nagyon káros és valószínűleg beleegyezés nélküli szexuális tartalmának létrehozására. (Kutatók, áldozatok szószólói, újságírók, technológiai cégek és mások az elmúlt évtizedben nagyrészt kivezették a gyermekpornográfia kifejezést a CSAM javára). Az elmúlt években tucatnyi „deepfake” és „nudify” weboldal, bot és alkalmazás szaporodott el, amelyek nők és lányok ezreit vették célba káros képekkel és videókkal. Mindez a mesterséges intelligencia által generált CSAM-ok megugrása mellett történt. "Ez rendkívül veszélyes” - mondja Fowler az adatokról. "Ha biztonsági kutatóként vagy szülőként nézzük, ez félelmetes. És félelmetes az is, hogy milyen könnyű létrehozni ezt a tartalmat.”

Fowler március elején fedezte fel a nyitott könyvtárat - tehát az adatbázis nem volt jelszóval védett vagy titkosított -, és gyorsan jelentette a GenNomisnak és az AI-Nomisnak, rámutatva, hogy MI CSAM-ot tartalmaz. Fowler szerint a GenNomis gyorsan lezárta az adatbázist, de nem válaszolt, és nem vette fel vele a kapcsolatot a felfedezésekkel kapcsolatban. Néhány órával azután azonban, hogy újságírók kapcsolatba léptek a szervezetekkel, mindkét vállalat honlapja leállt, a GenNomis honlapja most 404-es hibaüzenetet ad vissza.

„Ez a példa is mutatja - ismét -, hogy milyen nyugtalanító mértékben növekszik a mesterséges intelligencia piaca, amely lehetővé teszi az ilyen bántalmazó képek létrehozását” - mondja Clare McGlynn, az Egyesült Királyságban található Durham Egyetem jogi professzora, aki az online és képalapú visszaélésekre szakosodott. „Ez arra kell, hogy emlékeztessen minket, hogy a CSAM létrehozása, birtoklása és terjesztése nem ritka, és nem csak torzult egyéneknek tulajdonítható”.

A GenNomis több különböző mesterséges intelligencia eszközt is közzétett honlapján. Ezek között volt egy képgenerátor, amely lehetővé tette, hogy az emberek beírják az általuk létrehozni kívánt képekhez a parancsokat, vagy feltöltsenek egy képet, és mellékeljenek egy felszólítást a módosítására. Volt még rajta arccserélő eszköz, egy háttér eltávolító, valamint egy videókat képekké alakító alkalmazás. "A legzavaróbb dolgok a a gyermekeket tartalmazó képek voltak. Olyanokat láttunk, amelyeken egyértelműen hírességeket dolgoztak át gyermekké” - mondja Fowler. A kutató látott MI által generált képeket teljesen felöltözött fiatal lányokról is. Azt mondja, ezekben az esetekben nem világos, hogy a felhasznált arcok teljesen mesterséges intelligencia által generáltak-e, vagy valós képek alapján készültek.

Fowler szerint a CSAM mellett az adatbázisban felnőttekről készült, mesterséges intelligenciával generált pornográf képek, valamint kicserélt arcú képek is voltak. A fájlok között megfigyelt olyanokat, amelyek valódi emberek fotóinak tűntek, és amelyeket valószínűleg „kifejezetten meztelen vagy szexuális jellegű, mesterséges intelligencia által generált képek” létrehozásához használtak - mondja. „Tehát valódi képeket készítettek emberekről, és felcserélték az arcukat” - állítja néhány generált képről. "Ha képes voltam látni ezeket a képeket úgy, hogy csak az URL-címet adtam meg, az azt mutatja számomra, hogy nem tesznek meg minden szükséges lépést annak érdekében, hogy blokkolják ezt a tartalmat” - állítja Fowler az adatbázisról.

Amikor a GenNomis honlapja élesben működött, lehetővé tette a meztelen képek generálását. A honlapon és az MI modellek szekcióban sok kép szerepelt, amelyeken nők szexualizált képei voltak láthatóak - egyesek fotorealisztikusak, míg mások teljesen MI-generáltak vagy animált stílusban készültek. Tartalmazott egy NSFW galériát (Not Safe For Work) és egy „piacteret” is, ahol a felhasználók megoszthatták a képeket, és potenciálisan eladhatták az MI által generált fotókból álló albumokat. A weboldal szlogenje szerint az emberek korlátozás nélkül hozhatnak létre képeket és videókat; az oldal egy korábbi, 2024-es verziója szerint „cenzúrázatlan képeket” lehetett létrehozni.

A GenNomis felhasználói szabályzatában az állt, hogy csak „tiszteletteljes tartalom” engedélyezett, és csak a „kifejezett erőszak” és a gyűlöletbeszéd volt tilos. „A gyermekpornográfia és minden más illegális tevékenység szigorúan tilos a GenNomison” - áll a közösségi irányelvekben, amelyek szerint a tiltott tartalmakat közzétevő fiókok megszüntetésre kerülnek. Nem világos, hogy a GenNomis milyen mértékben használt moderációs eszközöket vagy rendszereket a mesterséges intelligencia által generált CSAM létrehozásának megakadályozására vagy tiltására. Néhány felhasználó tavaly a közösségi oldalára azt posztolta, hogy nem tudtak olyan képeket generálni, amelyeken emberek szexelnek, és hogy nem szexuális jellegű „sötét humor” miatt is blokkolták a parancsaikat. Egy másik fiók a közösségi oldalán azt írta, hogy a „NSFW” tartalmakkal foglalkozni kell, mivel „a szövetségiek megnézhetik”.

Henry Ajder deepfake szakértő és a Latent Space Advisory tanácsadó cég alapítója szerint még ha a káros és illegális tartalmak létrehozását nem is engedélyezte a vállalat, a weboldal márkajelzése - amely „korlátlan” képkészítésre és egy „NSFW” szekcióra hivatkozik - arra utal, hogy „egyértelmű kapcsolat állhat fenn az intim tartalmakkal, biztonsági intézkedések nélkül”. Ajder azt mondja, meglepődött, hogy az angol nyelvű weboldal egy dél-koreai szervezethez kapcsolódott. Tavaly az országot egy lányokat célzó, nem konszenzuális deepfake botrány sújtotta, és intézkedéseket hoztak a deepfake visszaélési hullám leküzdésére.

Ajder szerint nagyobb nyomást kell gyakorolni az ökoszisztéma minden olyan tagjára, amely lehetővé teszi, hogy a mesterséges intelligencia segítségével nem konszenzuális képeket hozzanak létre. „Minél több ilyet látunk, annál inkább a jogalkotókra, a technológiai platformokra, a webtárhely-szolgáltatókra és a fizetési szolgáltatókra hárul a kérdés. Mindazok, akik valamilyen formában, tudatosan vagy más módon - többnyire tudtukon kívül - elősegítik és lehetővé teszik, hogy ez megtörténjen” - mondja.

Fowler szerint az adatbázis olyan fájlokat is feltárt, amelyek mesterséges intelligencia-parancsokat tartalmaztak. A kutató szerint a feltárt adatok között nem szerepeltek felhasználói adatok, például nevek vagy jelszavak. A parancsokról készült képernyőfotókon olyan szavak használata látható, mint a „pici”, „lány”, és a családtagok közötti szexuális aktusokra való utalások. A felszólítások hírességek közötti szexuális aktusokat is tartalmaztak. "Nekem úgy tűnik, hogy a technológia megelőzte az irányelveket és az ellenőrzéseket” - mondja Fowler. „Jogi szempontból mindannyian tudjuk, hogy a gyermekekről készült explicit képek illegálisak, de ez nem akadályozta meg a technológiát abban, hogy ezeket a képeket létrehozza”.

Mivel a generatív mesterséges intelligencia rendszerek az elmúlt két évben jelentősen egyszerűsítették a képek létrehozásának és módosításának módját, az MI által generált CSAM-ok száma robbanásszerűen megnőtt. „A mesterséges intelligenciával generált, gyermekek szexuális zaklatását tartalmazó weboldalak száma 2023 óta több mint megnégyszereződött, és e szörnyű tartalmak fotórealizmusa is ugrásszerűen javul- mondja Derek Ray-Hill, az Internet Watch Foundation (IWF), az online CSAM ellen fellépő brit székhelyű nonprofit szervezet ideiglenes vezérigazgatója. Az IWF dokumentálta, hogy a bűnözők egyre gyakrabban készítenek mesterséges intelligencia által generált CSAM-okat, és fejlesztik az ezek létrehozásához használt módszereket. „A bűnözők számára jelenleg egyszerűen túl könnyű a mesterséges intelligenciát arra használni, hogy a gyermekekről szóló szexuális tartalmakat nagy mennyiségben és sebességgel generáljanak és terjesszenek” - mondja Ray-Hill.