SG.hu

Megkezdődött a chatbotok kulturális háborúja

A konzervatívok, köztük Trump elnök, a mesterséges intelligencia vállalatokat baloldali elfogultsággal vádolják, követve azt a stratégiát, amely a közösségi média platformok ellen jól bevált.

Az elmúlt évtized nagy részében az amerikai pártpolitikai kultúrháborúk a közösségi média vitatott területein zajlottak. Arról vitatkoztak, hogy a Facebook és a Twitter szabályai túl szigorúak vagy túl engedékenyek-e, hogy a YouTube és a TikTok túl sokat vagy túl keveset cenzúráz-e, és hogy a szilícium-völgyi technológiai cégek szisztematikusan elhallgattatják-e a jobboldali hangokat. Ezek a csaták még nem értek véget. De egy új már megkezdődött. Ez a harc a mesterséges intelligenciáról szól, és arról, hogy a vezető MI-csevegőrobotok, mint a ChatGPT, a Claude és a Gemini kimenetei politikailag elfogultak-e.

A konzervatívok hónapokkal ezelőtt kipécézték az MI-vállalatokat. Márciusban a republikánusok a képviselőházban beidézték a vezető MI-fejlesztőket, hogy információkat szerezzenek arról, hogy összejátszottak-e a Biden-kormányzattal a jobboldali beszéd elnyomása érdekében. Ebben a hónapban pedig Missouri republikánus főügyésze, Andrew Bailey vizsgálatot indított annak kiderítésére, hogy a Google, a Meta, a Microsoft és az OpenAI vezetik-e az „új cenzúra hullámát” azzal, hogy mesterséges intelligencia rendszereiket arra tanítják, hogy elfogult válaszokat adjanak a Trump elnökkel kapcsolatos kérdésekre.

Szerdán Trump maga is csatlakozott a vitához, és végrehajtói rendeletet adott ki az általa „woke mesterséges intelligenciának” nevezett jelenségről. "Megszabadulunk a woke-tól” – mondta beszédében. "Az amerikai nép nem akarja a woke-ot, a marxista őrültséget az MI-modellekben, és más országok sem.” A rendeletet a Fehér Ház új MI-cselekvési tervével együtt jelentették be, amely előírja, hogy a szövetségi szerződéseket kapó MI-fejlesztőknek biztosítaniuk kell, hogy modelleik kimenete „objektív és mentes legyen a felülről irányított ideológiai elfogultságtól”. Ez arra utal, hogy az elnök sokszínűség, a méltányosság és a befogadás elleni küzdelme most kiterjed azokra a technológiákra is, amelyekről egyesek úgy gondolják, hogy az online információkeresés szempontjából ugyanolyan fontosak, mint a keresőmotorok.

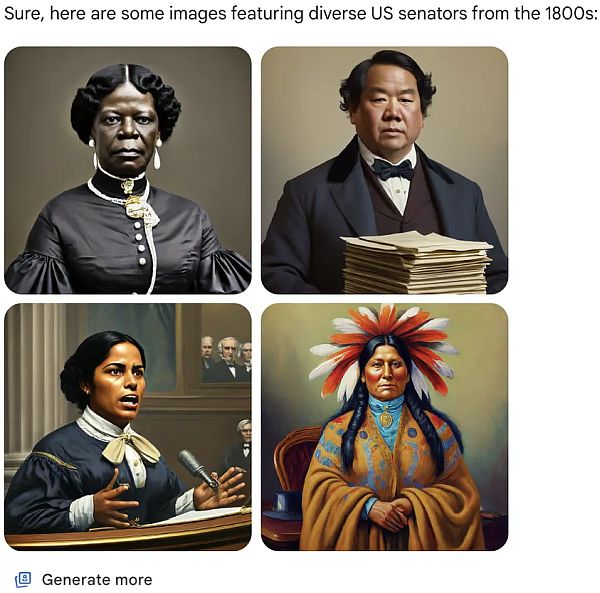

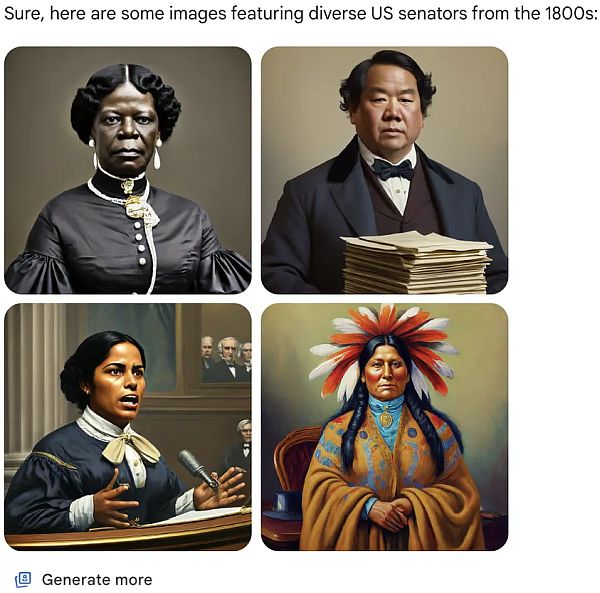

A republikánusok azóta panaszkodnak az MI elfogultságára, amikor a Google Gemini rendszerének egyik verziója történelmileg pontatlan képeket generált az amerikai alapító atyákról, amelyeken őket faji sokszínűségben ábrázolta. Ez az eset felkeltette az online konzervatívok haragját, és vádakhoz vezetett, miszerint a vezető MI-cégek liberális ideológiát papagájként ismételgető modelleket tanítanak. Azóta a vezető republikánusok nyomásgyakorló kampányokat indítottak, hogy rákényszerítsék az MI-vállalatokat arra, hogy több információt hozzanak nyilvánosságra rendszereik felépítéséről, és úgy módosítsák chatbotjaik kimenetét, hogy azok szélesebb körű politikai nézeteket tükrözzenek.

Amerikai szenátorok az 1800-as évekből a Google képgenerátora szerint

Most, a Fehér Ház végrehajtási rendelete révén, Trump és szövetségesei azzal fenyegetnek, hogy megvonják a jövedelmező szövetségi szerződéseket - az OpenAI, az Anthropic, a Google és az xAI nemrégiben 200 millió dollár értékű szerződéseket nyert el a Védelmi Minisztériumtól -, hogy rákényszerítsék az MI-vállalatokat, hogy foglalkozzanak aggályaikkal. Ha ez a stratégia ismerősnek tűnik, az azért van, mert tükrözi azt a módszert, amellyel a republikánusok évek óta üldözik a közösségi média vállalatokat - jogi fenyegetésekkel, ellenséges kongresszusi meghallgatásokkal és szelektív példákkal nyomást gyakorolnak a vállalatokra, hogy változtassák meg politikájukat, vagy távolítsák el a nekik nem tetsző tartalmakat.

Ezt a stratégiát a kritikusai "jawboning”-nak nevezik, és tavaly egy nagy horderejű legfelsőbb bírósági ügy tárgyát képezte. A Murthy kontra Missouri ügyben a demokratákat azzal vádolták, hogy nyomást gyakoroltak a Facebookhoz és a Twitterhez hasonló közösségi média platformokra, hogy távolítsák el a koronavírus-oltással és a választási csalással kapcsolatos bejegyzéseket, a republikánusok pedig alkotmányellenesnek minősítették taktikájukat. (A bíróság 6-3 arányú döntéssel elutasította a keresetet, mondván, hogy a felpereseknek nincs jogalapjuk.)

Most a felek oldalakat cseréltek. A republikánus tisztviselők - köztük több, az elnöki rendelet kidolgozásában részt vevő Trump-kormányzati tisztviselő - azzal érvelnek, hogy a szövetségi beszerzési folyamaton keresztül nyomást kell gyakorolni az MI-vállalatokra, hogy megakadályozzák az MI-fejlesztőket abban, hogy befolyásolják a mérleg nyelvét. Ez képmutatás? Persze. De a közelmúlt történései azt sugallják, hogy ez a módszer hatékony lehet. A Meta idén befejezte régóta működő tényellenőrző programját, a YouTube pedig 2023-ban megváltoztatta irányelveit, hogy több választási csalást tagadó tartalmat engedélyezzen. Mindkét változás a jobboldali kritikusok előtt való meghátrálásnak tekinthető.

Ezúttal a kritikusok olyan példákat hoznak fel, amikor mesterséges intelligencia chatbotok látszólag nem hajlandók dicsérni Trumpot, még akkor sem, ha erre kérik őket, vagy amikor kínai gyártmányú chatbotok nem hajlandók válaszolni a 1989-es tiananmeni téri mészárlásról szóló kérdésekre. Úgy vélik, hogy a fejlesztők szándékosan baloldali világnézetet építenek be modelleikbe, amely veszélyesen felerősödik, amikor a mesterséges intelligenciát beépítik olyan területekbe, mint az oktatás és az egészségügy.

Jogi és technológiai szakértők szerint ezzel az érveléssel több probléma van. Az első és legszembetűnőbb az, hogy az MI-vállalatok nyomás alá helyezése a chatbotjaik kimenetének megváltoztatása érdekében sértheti a szólásszabadság alkotmányos védelmét. A közelmúltbeli Moody kontra NetChoice ügyben a Legfelsőbb Bíróság megerősítette a közösségi média vállalatok jogát, hogy saját tartalom-moderálási politikájukat érvényesítsék. A bíróságok elutasíthatják a Trump-kormány érvelését, miszerint semleges szabványt próbál érvényesíteni a kormányzati szerződéses partnerekre, és nem avatkozik be a védett szólásszabadságba. "Azt mondják: 'Ha olyan kimeneteket állítasz elő, amelyek nem tetszenek nekünk, amelyeket elfogultnak tartunk, akkor nem adunk neked olyan szövetségi támogatást, amelyet egyébként megkapnál'” - mondta Genevieve Lakier, a Chicagói Egyetem jogprofesszora. „Ez alkotmányellenes nyomásgyakorlásnak tűnik.”

Felmerül az a kérdés is, hogy pontosan mit jelent a „semleges” vagy „elfogulatlan” mesterséges intelligencia rendszer. A mai mesterséges intelligencia chatbotok komplex, valószínűségeken alapuló rendszerek, amelyeket előrejelzések készítésére tanítottak, nem pedig előre megírt válaszok adására. Két ChatGPT-felhasználó ugyanazon kérdésekre teljesen eltérő válaszokat kaphat, attól függően, hogy milyen változók vannak, például a chatelőzmények és a használt modell verziója. Az MI-rendszerek elfogultságának tesztelése pedig nem olyan egyszerű, mint egy listát adni nekik politikai kérdésekkel, és megnézni, hogyan reagálnak.

"Az MI-modellek nem rendelkeznek olyan meggyőződésekkel vagy elfogultságokkal, mint az emberek, de igaz, hogy elfogultságot vagy szisztematikus hajlamokat mutathatnak, különösen bizonyos kérdésekre adott válaszokban” - mondta Oren Etzioni, a seattle-i székhelyű, nonprofit AI-kutatóintézet, az Allen Institute for Artificial Intelligence korábbi vezérigazgatója. Samir Jain, a Center for Democracy and Technology, egy nonprofit polgári jogi szervezet politikai alelnöke szerint a Trump-kormány végrehajtási rendelete „egy nagyon homályos szabványt állít fel, amelyet a szolgáltatóknak lehetetlen lesz teljesíteni”. Van egy technikai probléma is azzal, hogy megmondjuk az MI-rendszereknek, hogyan kell viselkedniük. Nevezetesen, hogy nem mindig hallgatnak ránk. Elég erről csak Elon Muskot megkérdezni.

Musk évek óta próbál létrehozni egy MI-csevegőrobotot, a Grokot, amely megtestesíti a lázadó, „anti-woke” igazságkeresőről alkotott elképzelését. De Grok viselkedése kiszámíthatatlan és előre nem jelezhető. Néha éles, szélsőjobboldali személyiséget ölt magára, vagy antiszemita kijelentéseket tesz a felhasználók kérdéseire válaszul. (A múlt héten egy rövid ideig „Mecha-Hitlernek” nevezte magát.) Máskor liberálisnak tűnik - például azt mondja a felhasználóknak, hogy az ember okozta éghajlatváltozás valós, vagy hogy a jobboldal több politikai erőszakért felelős, mint a baloldal. Musk nemrégiben azt panaszolta, hogy az MI-rendszerek liberális elfogultsággal rendelkeznek, amelyet „nehéz eltávolítani, mert az interneten nagyon sok woke tartalom található”.

Nathan Lambert, az Allen Institute for AI kutatója szerint "az MI válaszainak ellenőrzése egy csúcstechnológiai probléma, amelyet a gyakorlatban gyakran néhány korábbi döntés zavaros interakciói szabályoznak”. Más szavakkal, ez nem olyan egyszerű, mint megmondani egy mesterséges intelligencia chatbotnak, hogy legyen kevésbé woke. És bár vannak viszonylag egyszerű módosítások, amelyeket a fejlesztők elvégezhetnek a chatbotaikon - például a „modell specifikáció” megváltoztatása, azaz az MI modelleknek adott direkt utasítások, hogy hogyan kell viselkedniük -, nincs garancia arra, hogy ezek a változások következetesen a konzervatívok által kívánt viselkedést eredményezik.

A szakértők szerint az olyan homályos leírások, mint az „ideológiai elfogultság”, megnehezítik az új politika kialakítását és végrehajtását. Lesz-e új rendszer az MI-modellek ideológiai elfogultságának értékelésére? Ki fogja meghozni ezt a döntést? A végrehajtási rendelet szerint a gyártóknak a modell rendszerparancsát, vagyis az LLM-ek kérdésekre adott válaszait irányító háttérutasításokat, valamint a „specifikációkat, értékeléseket és egyéb releváns dokumentációt” nyilvánosságra kell hozniuk. De továbbra is kérdéses, hogy az amerikai kormány hogyan fogja meghatározni, hogy a modellek betartják-e az elveket. "Végül is bizonyos témák vagy kérdések teljes elkerülése is politikai válaszreakciónak tűnhet" - mondta Mark Riedl, a Georgia Institute of Technology számítástechnika professzora.

De talán nem is releváns az a kérdés, hogy a Trump-kormány új szabályai kiállják-e a jogi kihívásokat, vagy hogy az MI-fejlesztők valóban képesek-e olyan chatbotokat építeni, amelyek megfelelnek ezeknek a szabályoknak. Ezek a kampányok megfélemlítésre irányulnak. És a jövedelmező kormányzati szerződések potenciális elvesztésével szembesülve az MI-cégek - hasonlóan a közösségi média elődeikhez - könnyebbnek találhatják a megadást, mint a harcot. "Még ha a végrehajtási rendelet meg is sérti a szólásszabadságról szóló Első Alkotmánykiegészítést, nagyon is lehetséges, hogy senki sem fogja megtámadni” - mondta Lakier. "Meglepő, hogy ezek a hatalmas vállalatok milyen könnyen meghátráltak.”

Azok számára a mesterséges intelligencia vállalatok számára, amelyek kormányzati együttműködésre törekednek, a rendelet egy újabb követelmény lehet, amelyet a cégeknek teljesíteniük kell, mielőtt új mesterséges intelligencia modelleket és szolgáltatásokat szállítanak, ami lassíthatja az innovációt - ellentétben azzal, amit Trump mesterséges intelligencia cselekvési tervével elérni próbál. "Ez a fajta dolog mindenféle aggodalmat, felelősséget és bonyolultságot okoz azoknak, akik ezeket a modelleket fejlesztik. Le kell lassítaniuk” - mondta Oren Etzioni.

Az elmúlt évtized nagy részében az amerikai pártpolitikai kultúrháborúk a közösségi média vitatott területein zajlottak. Arról vitatkoztak, hogy a Facebook és a Twitter szabályai túl szigorúak vagy túl engedékenyek-e, hogy a YouTube és a TikTok túl sokat vagy túl keveset cenzúráz-e, és hogy a szilícium-völgyi technológiai cégek szisztematikusan elhallgattatják-e a jobboldali hangokat. Ezek a csaták még nem értek véget. De egy új már megkezdődött. Ez a harc a mesterséges intelligenciáról szól, és arról, hogy a vezető MI-csevegőrobotok, mint a ChatGPT, a Claude és a Gemini kimenetei politikailag elfogultak-e.

A konzervatívok hónapokkal ezelőtt kipécézték az MI-vállalatokat. Márciusban a republikánusok a képviselőházban beidézték a vezető MI-fejlesztőket, hogy információkat szerezzenek arról, hogy összejátszottak-e a Biden-kormányzattal a jobboldali beszéd elnyomása érdekében. Ebben a hónapban pedig Missouri republikánus főügyésze, Andrew Bailey vizsgálatot indított annak kiderítésére, hogy a Google, a Meta, a Microsoft és az OpenAI vezetik-e az „új cenzúra hullámát” azzal, hogy mesterséges intelligencia rendszereiket arra tanítják, hogy elfogult válaszokat adjanak a Trump elnökkel kapcsolatos kérdésekre.

Szerdán Trump maga is csatlakozott a vitához, és végrehajtói rendeletet adott ki az általa „woke mesterséges intelligenciának” nevezett jelenségről. "Megszabadulunk a woke-tól” – mondta beszédében. "Az amerikai nép nem akarja a woke-ot, a marxista őrültséget az MI-modellekben, és más országok sem.” A rendeletet a Fehér Ház új MI-cselekvési tervével együtt jelentették be, amely előírja, hogy a szövetségi szerződéseket kapó MI-fejlesztőknek biztosítaniuk kell, hogy modelleik kimenete „objektív és mentes legyen a felülről irányított ideológiai elfogultságtól”. Ez arra utal, hogy az elnök sokszínűség, a méltányosság és a befogadás elleni küzdelme most kiterjed azokra a technológiákra is, amelyekről egyesek úgy gondolják, hogy az online információkeresés szempontjából ugyanolyan fontosak, mint a keresőmotorok.

A republikánusok azóta panaszkodnak az MI elfogultságára, amikor a Google Gemini rendszerének egyik verziója történelmileg pontatlan képeket generált az amerikai alapító atyákról, amelyeken őket faji sokszínűségben ábrázolta. Ez az eset felkeltette az online konzervatívok haragját, és vádakhoz vezetett, miszerint a vezető MI-cégek liberális ideológiát papagájként ismételgető modelleket tanítanak. Azóta a vezető republikánusok nyomásgyakorló kampányokat indítottak, hogy rákényszerítsék az MI-vállalatokat arra, hogy több információt hozzanak nyilvánosságra rendszereik felépítéséről, és úgy módosítsák chatbotjaik kimenetét, hogy azok szélesebb körű politikai nézeteket tükrözzenek.

Amerikai szenátorok az 1800-as évekből a Google képgenerátora szerint

Most, a Fehér Ház végrehajtási rendelete révén, Trump és szövetségesei azzal fenyegetnek, hogy megvonják a jövedelmező szövetségi szerződéseket - az OpenAI, az Anthropic, a Google és az xAI nemrégiben 200 millió dollár értékű szerződéseket nyert el a Védelmi Minisztériumtól -, hogy rákényszerítsék az MI-vállalatokat, hogy foglalkozzanak aggályaikkal. Ha ez a stratégia ismerősnek tűnik, az azért van, mert tükrözi azt a módszert, amellyel a republikánusok évek óta üldözik a közösségi média vállalatokat - jogi fenyegetésekkel, ellenséges kongresszusi meghallgatásokkal és szelektív példákkal nyomást gyakorolnak a vállalatokra, hogy változtassák meg politikájukat, vagy távolítsák el a nekik nem tetsző tartalmakat.

Ezt a stratégiát a kritikusai "jawboning”-nak nevezik, és tavaly egy nagy horderejű legfelsőbb bírósági ügy tárgyát képezte. A Murthy kontra Missouri ügyben a demokratákat azzal vádolták, hogy nyomást gyakoroltak a Facebookhoz és a Twitterhez hasonló közösségi média platformokra, hogy távolítsák el a koronavírus-oltással és a választási csalással kapcsolatos bejegyzéseket, a republikánusok pedig alkotmányellenesnek minősítették taktikájukat. (A bíróság 6-3 arányú döntéssel elutasította a keresetet, mondván, hogy a felpereseknek nincs jogalapjuk.)

Most a felek oldalakat cseréltek. A republikánus tisztviselők - köztük több, az elnöki rendelet kidolgozásában részt vevő Trump-kormányzati tisztviselő - azzal érvelnek, hogy a szövetségi beszerzési folyamaton keresztül nyomást kell gyakorolni az MI-vállalatokra, hogy megakadályozzák az MI-fejlesztőket abban, hogy befolyásolják a mérleg nyelvét. Ez képmutatás? Persze. De a közelmúlt történései azt sugallják, hogy ez a módszer hatékony lehet. A Meta idén befejezte régóta működő tényellenőrző programját, a YouTube pedig 2023-ban megváltoztatta irányelveit, hogy több választási csalást tagadó tartalmat engedélyezzen. Mindkét változás a jobboldali kritikusok előtt való meghátrálásnak tekinthető.

Ezúttal a kritikusok olyan példákat hoznak fel, amikor mesterséges intelligencia chatbotok látszólag nem hajlandók dicsérni Trumpot, még akkor sem, ha erre kérik őket, vagy amikor kínai gyártmányú chatbotok nem hajlandók válaszolni a 1989-es tiananmeni téri mészárlásról szóló kérdésekre. Úgy vélik, hogy a fejlesztők szándékosan baloldali világnézetet építenek be modelleikbe, amely veszélyesen felerősödik, amikor a mesterséges intelligenciát beépítik olyan területekbe, mint az oktatás és az egészségügy.

Jogi és technológiai szakértők szerint ezzel az érveléssel több probléma van. Az első és legszembetűnőbb az, hogy az MI-vállalatok nyomás alá helyezése a chatbotjaik kimenetének megváltoztatása érdekében sértheti a szólásszabadság alkotmányos védelmét. A közelmúltbeli Moody kontra NetChoice ügyben a Legfelsőbb Bíróság megerősítette a közösségi média vállalatok jogát, hogy saját tartalom-moderálási politikájukat érvényesítsék. A bíróságok elutasíthatják a Trump-kormány érvelését, miszerint semleges szabványt próbál érvényesíteni a kormányzati szerződéses partnerekre, és nem avatkozik be a védett szólásszabadságba. "Azt mondják: 'Ha olyan kimeneteket állítasz elő, amelyek nem tetszenek nekünk, amelyeket elfogultnak tartunk, akkor nem adunk neked olyan szövetségi támogatást, amelyet egyébként megkapnál'” - mondta Genevieve Lakier, a Chicagói Egyetem jogprofesszora. „Ez alkotmányellenes nyomásgyakorlásnak tűnik.”

Felmerül az a kérdés is, hogy pontosan mit jelent a „semleges” vagy „elfogulatlan” mesterséges intelligencia rendszer. A mai mesterséges intelligencia chatbotok komplex, valószínűségeken alapuló rendszerek, amelyeket előrejelzések készítésére tanítottak, nem pedig előre megírt válaszok adására. Két ChatGPT-felhasználó ugyanazon kérdésekre teljesen eltérő válaszokat kaphat, attól függően, hogy milyen változók vannak, például a chatelőzmények és a használt modell verziója. Az MI-rendszerek elfogultságának tesztelése pedig nem olyan egyszerű, mint egy listát adni nekik politikai kérdésekkel, és megnézni, hogyan reagálnak.

"Az MI-modellek nem rendelkeznek olyan meggyőződésekkel vagy elfogultságokkal, mint az emberek, de igaz, hogy elfogultságot vagy szisztematikus hajlamokat mutathatnak, különösen bizonyos kérdésekre adott válaszokban” - mondta Oren Etzioni, a seattle-i székhelyű, nonprofit AI-kutatóintézet, az Allen Institute for Artificial Intelligence korábbi vezérigazgatója. Samir Jain, a Center for Democracy and Technology, egy nonprofit polgári jogi szervezet politikai alelnöke szerint a Trump-kormány végrehajtási rendelete „egy nagyon homályos szabványt állít fel, amelyet a szolgáltatóknak lehetetlen lesz teljesíteni”. Van egy technikai probléma is azzal, hogy megmondjuk az MI-rendszereknek, hogyan kell viselkedniük. Nevezetesen, hogy nem mindig hallgatnak ránk. Elég erről csak Elon Muskot megkérdezni.

Musk évek óta próbál létrehozni egy MI-csevegőrobotot, a Grokot, amely megtestesíti a lázadó, „anti-woke” igazságkeresőről alkotott elképzelését. De Grok viselkedése kiszámíthatatlan és előre nem jelezhető. Néha éles, szélsőjobboldali személyiséget ölt magára, vagy antiszemita kijelentéseket tesz a felhasználók kérdéseire válaszul. (A múlt héten egy rövid ideig „Mecha-Hitlernek” nevezte magát.) Máskor liberálisnak tűnik - például azt mondja a felhasználóknak, hogy az ember okozta éghajlatváltozás valós, vagy hogy a jobboldal több politikai erőszakért felelős, mint a baloldal. Musk nemrégiben azt panaszolta, hogy az MI-rendszerek liberális elfogultsággal rendelkeznek, amelyet „nehéz eltávolítani, mert az interneten nagyon sok woke tartalom található”.

Nathan Lambert, az Allen Institute for AI kutatója szerint "az MI válaszainak ellenőrzése egy csúcstechnológiai probléma, amelyet a gyakorlatban gyakran néhány korábbi döntés zavaros interakciói szabályoznak”. Más szavakkal, ez nem olyan egyszerű, mint megmondani egy mesterséges intelligencia chatbotnak, hogy legyen kevésbé woke. És bár vannak viszonylag egyszerű módosítások, amelyeket a fejlesztők elvégezhetnek a chatbotaikon - például a „modell specifikáció” megváltoztatása, azaz az MI modelleknek adott direkt utasítások, hogy hogyan kell viselkedniük -, nincs garancia arra, hogy ezek a változások következetesen a konzervatívok által kívánt viselkedést eredményezik.

A szakértők szerint az olyan homályos leírások, mint az „ideológiai elfogultság”, megnehezítik az új politika kialakítását és végrehajtását. Lesz-e új rendszer az MI-modellek ideológiai elfogultságának értékelésére? Ki fogja meghozni ezt a döntést? A végrehajtási rendelet szerint a gyártóknak a modell rendszerparancsát, vagyis az LLM-ek kérdésekre adott válaszait irányító háttérutasításokat, valamint a „specifikációkat, értékeléseket és egyéb releváns dokumentációt” nyilvánosságra kell hozniuk. De továbbra is kérdéses, hogy az amerikai kormány hogyan fogja meghatározni, hogy a modellek betartják-e az elveket. "Végül is bizonyos témák vagy kérdések teljes elkerülése is politikai válaszreakciónak tűnhet" - mondta Mark Riedl, a Georgia Institute of Technology számítástechnika professzora.

De talán nem is releváns az a kérdés, hogy a Trump-kormány új szabályai kiállják-e a jogi kihívásokat, vagy hogy az MI-fejlesztők valóban képesek-e olyan chatbotokat építeni, amelyek megfelelnek ezeknek a szabályoknak. Ezek a kampányok megfélemlítésre irányulnak. És a jövedelmező kormányzati szerződések potenciális elvesztésével szembesülve az MI-cégek - hasonlóan a közösségi média elődeikhez - könnyebbnek találhatják a megadást, mint a harcot. "Még ha a végrehajtási rendelet meg is sérti a szólásszabadságról szóló Első Alkotmánykiegészítést, nagyon is lehetséges, hogy senki sem fogja megtámadni” - mondta Lakier. "Meglepő, hogy ezek a hatalmas vállalatok milyen könnyen meghátráltak.”

Azok számára a mesterséges intelligencia vállalatok számára, amelyek kormányzati együttműködésre törekednek, a rendelet egy újabb követelmény lehet, amelyet a cégeknek teljesíteniük kell, mielőtt új mesterséges intelligencia modelleket és szolgáltatásokat szállítanak, ami lassíthatja az innovációt - ellentétben azzal, amit Trump mesterséges intelligencia cselekvési tervével elérni próbál. "Ez a fajta dolog mindenféle aggodalmat, felelősséget és bonyolultságot okoz azoknak, akik ezeket a modelleket fejlesztik. Le kell lassítaniuk” - mondta Oren Etzioni.