SG.hu

Algoritmus dönt a családtámogatásokról Franciaországban

Francia civil szervezetek beperelték a francia társadalombiztosítási rendszer családokért felelős ágát, a Caisse Nationale des Allocations Familiales (CNAF) állami szervet, mely Franciaország-szerte 101 családtámogatási hivatal (CAF) hálózatán keresztül osztja el a lakhatási támogatásokat egy pontozási algoritmus segítségével. "Ezek a kockázatértékelő rendszerek a mesterséges intelligenciáról szóló törvény értelmében elfogadhatatlan kockázatot jelenthetnek” - mondta Soizic Pénicaud kutató.

Tizenöt francia nem kormányzati szervezet perelte be a CNAF-et a francia államtanácsnál egy kockázati pontozási algoritmus alkalmazása miatt, amely a francia lakosság közel felét érinti. A jogi lépések azt követően indultak, hogy az Európai Unió Bírósága (EUB) kimondta, hogy a személyes adatokat felhasználó pontozási algoritmusokat alkalmazó döntéshozatal az uniós adatvédelmi rendelet (GDPR) értelmében jogellenes. A civil szervezetek felszólították az államtanácsot, hogy előzetes döntéshozatal céljából utalja az ügyet az EUB elé. Az ügy elbírálása két-öt évig is eltarthat, attól függően, hogyan kezelik az előterjesztést.

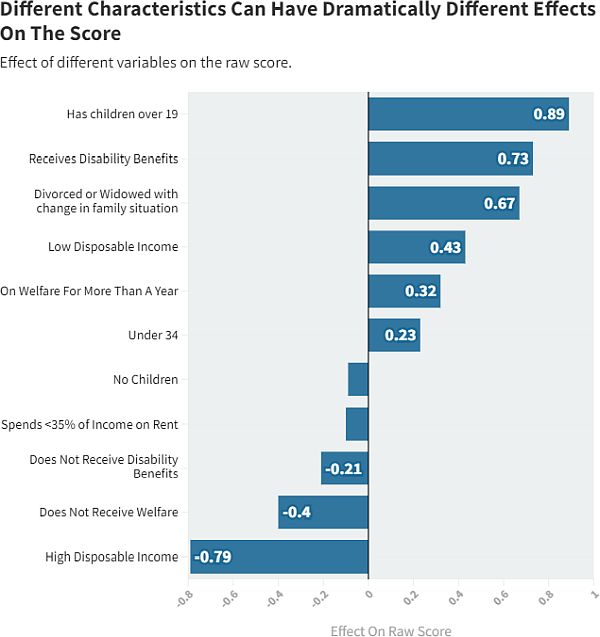

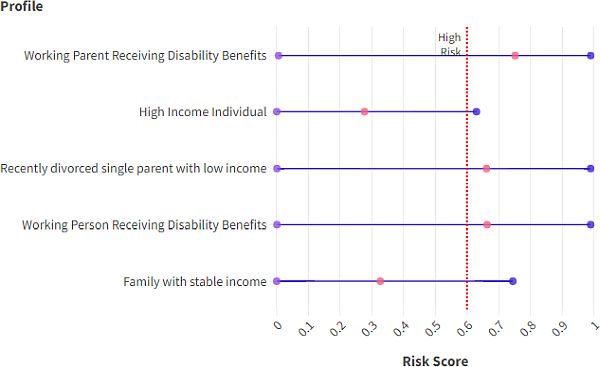

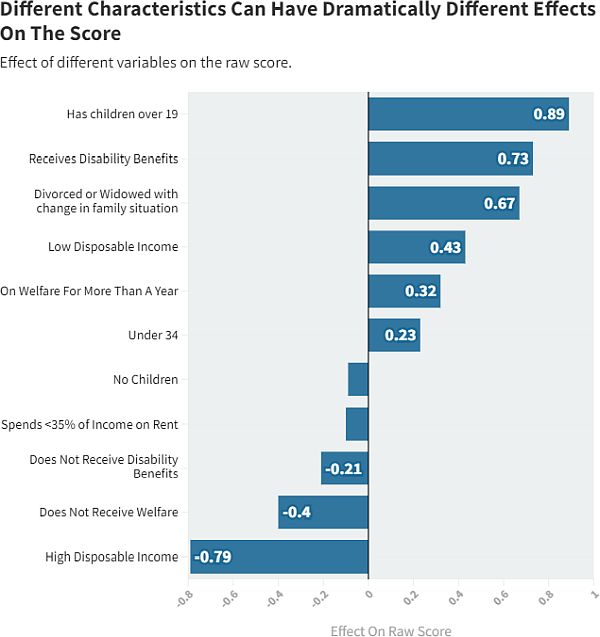

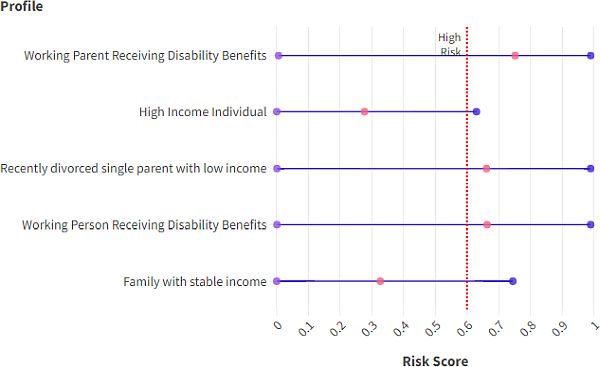

„Ez az algoritmus matematikailag tükrözi a társadalmunkban már meglévő diszkriminációt. Se nem semleges, se nem objektív” - mondta Marion Ogier, az Emberi Jogi Liga ügyvédje Párizsban tartott sajtótájékoztatóján. A CNAF 2010 óta egy algoritmus segítségével választja ki a kedvezményezetteket, hogy felülvizsgálják a juttatásaikat. Ezek a hitelképesség-ellenőrzések a kedvezményezett profilja és helyzete alapján „magasabb kockázatúnak” ítélt esetekre összpontosítanak.

Egy 2023 decemberében közzétett helyi vizsgálat azonban bírálta ezeket az ellenőrzéseket, mivel nem voltak valóban véletlenszerűek. A 2021-ben elvégzett 128 000 ellenőrzés hetven százaléka pontozó algoritmusokból származott - derült ki a CNAF 2022-es jelentéséből. "A CNAF algoritmusa csak egy része a rendszernek. Az állami nyugdíjrendszerek, az egészségbiztosítás és a foglalkoztatási szolgálat is hasonló algoritmusokat használ” - tette hozzá Ogier. A szoftvert úgy tervezték, hogy csak a „jelentős és ismétlődő túlfizetéseket” azonosítsa a bevallásaikban hibázásra leginkább hajlamos kedvezményezettek körében - mondta Nicolas Grivel, a CNAF főigazgatója. "Ha egy bíróság olyan döntést hozna, amely a rendszer kiigazítását igényli, a CNAF ennek természetesen eleget tenne” - mondta.

A 15 civil szervezet által az államtanácshoz benyújtott kereset kétféle érv körül forog: az adatvédelem és a diszkrimináció. A La Quadrature du Net, az Amnesty International France, az Abbé Pierre Alapítvány és az Emberi Jogi Liga mások mellett azt állítja, hogy a CNAF megsértette a GDPR-t, mert az algoritmus használata nem tartja tiszteletben az arányossági elvet. "A francia lakosság csaknem felét ellenőrzik” - mondta Bastien Le Querrec, a La Quadrature du Net (LQDN) jogi szakértője.

A nem kormányzati szervezetek szerint továbbá a CNAF algoritmusa közvetve diszkriminál bizonyos személyeket, ami sérti az egyenlő bánásmód elvéről szóló uniós irányelvet és az EU alapjogi chartáját. Szerintük az algoritmus a szociális juttatásokban részesülő szegényebb személyeket célozza meg, mivel a juttatási szabályok bonyolultak, ami növeli a hibák valószínűségét. "Az algoritmus állandósítja a 'segélyfüggő' emberek politikai sztereotípiáját, és működési módszerei révén diszkriminál” - mondta Le Querrec. A CNAF algoritmusa például diszkriminálja a nőket, akik az egyszülős családok 95%-át teszik ki a különélést követő első 18 hónapban - mondta.

Jogi beadványukban a civil szervezetek azt írják, hogy a CNAF algoritmusa az ellenőrzések 69%-át váltja ki, ezek azonban az összes visszakövetelt hibás kifizetés 49%-át teszik ki. Ezzel szemben az egyéb módon kiváltott hitelellenőrzés az összes ellenőrzés 31%-át teszi ki, de a visszakeresett hibás kifizetések 51%-át. A nem kormányzati szervezetek ezért úgy vélik, hogy a pontozási algoritmusok megzavarják a közszolgáltatások méltányos kezelését, mivel bizonyos csoportokat túlzottan ellenőriznek a vitatott ellátások tekintetében.

"Egy pontozási algoritmus több, mint a kódsorok puszta összege; mindig politikai indíttatású, és gyakran támogatja az elnyomó megszorító politikákat, amelyek a legkiszolgáltatottabbaknak ártanak” - mondta Soizic Pénicaud, aki független kutatóként a Lighthouse Reports CNAF-vizsgálatán dolgozott, és a Sciences Po digitális közpolitika előadója. Franciaország nincs egyedül az ilyen algoritmusok alkalmazásával. Hasonló algoritmusokat használnak más uniós országokban, többek között Hollandiában és Dániában is - tette hozzá Pénicaud. Németország még jogszabályi keretbe is kívánja foglalni.

A franciaországi eset kifejezetten a hatóságok ilyen algoritmusainak célzott használatára mutat rá. A holland kormány 2021 januárjában lemondott, miután a pontozó algoritmusok több ezer szülőt vádoltak meg tévesen csalással. Dániában az állami ellátások adminisztrációjának pontozási algoritmusa a Lighthouse Reports és a WIRED 2023. márciusi jelentése után azért került tűz alá, mert állítólag nemzetiségen alapuló adatokat használt - az etnikai profilalkotáshoz hasonlóan - a segélykérelmező csalók elfogására.

Pénicaud a bizonyítási teher megfordítását javasolja, miszerint „az uniós országoknak a bevezetés előtt be kell bizonyítaniuk, hogy rendszereik nem károsak és nem diszkriminatívak”. Az Európai Parlament belső piaci bizottsága (ITRE) 2023 októberében ugyanezt a gondolatot fogalmazta meg, amikor elfogadta az online szolgáltatások addiktív kialakításáról szóló saját kezdeményezésű jelentését, amely a digitális méltányossági törvény közelgő vitáiban is megjelenhet. "Ezek a kockázatértékelő rendszerek a mesterséges intelligenciáról szóló törvény értelmében elfogadhatatlan kockázatot jelentőnek tekinthetők” - mondta Pénicaud.

Tizenöt francia nem kormányzati szervezet perelte be a CNAF-et a francia államtanácsnál egy kockázati pontozási algoritmus alkalmazása miatt, amely a francia lakosság közel felét érinti. A jogi lépések azt követően indultak, hogy az Európai Unió Bírósága (EUB) kimondta, hogy a személyes adatokat felhasználó pontozási algoritmusokat alkalmazó döntéshozatal az uniós adatvédelmi rendelet (GDPR) értelmében jogellenes. A civil szervezetek felszólították az államtanácsot, hogy előzetes döntéshozatal céljából utalja az ügyet az EUB elé. Az ügy elbírálása két-öt évig is eltarthat, attól függően, hogyan kezelik az előterjesztést.

„Ez az algoritmus matematikailag tükrözi a társadalmunkban már meglévő diszkriminációt. Se nem semleges, se nem objektív” - mondta Marion Ogier, az Emberi Jogi Liga ügyvédje Párizsban tartott sajtótájékoztatóján. A CNAF 2010 óta egy algoritmus segítségével választja ki a kedvezményezetteket, hogy felülvizsgálják a juttatásaikat. Ezek a hitelképesség-ellenőrzések a kedvezményezett profilja és helyzete alapján „magasabb kockázatúnak” ítélt esetekre összpontosítanak.

Egy 2023 decemberében közzétett helyi vizsgálat azonban bírálta ezeket az ellenőrzéseket, mivel nem voltak valóban véletlenszerűek. A 2021-ben elvégzett 128 000 ellenőrzés hetven százaléka pontozó algoritmusokból származott - derült ki a CNAF 2022-es jelentéséből. "A CNAF algoritmusa csak egy része a rendszernek. Az állami nyugdíjrendszerek, az egészségbiztosítás és a foglalkoztatási szolgálat is hasonló algoritmusokat használ” - tette hozzá Ogier. A szoftvert úgy tervezték, hogy csak a „jelentős és ismétlődő túlfizetéseket” azonosítsa a bevallásaikban hibázásra leginkább hajlamos kedvezményezettek körében - mondta Nicolas Grivel, a CNAF főigazgatója. "Ha egy bíróság olyan döntést hozna, amely a rendszer kiigazítását igényli, a CNAF ennek természetesen eleget tenne” - mondta.

A 15 civil szervezet által az államtanácshoz benyújtott kereset kétféle érv körül forog: az adatvédelem és a diszkrimináció. A La Quadrature du Net, az Amnesty International France, az Abbé Pierre Alapítvány és az Emberi Jogi Liga mások mellett azt állítja, hogy a CNAF megsértette a GDPR-t, mert az algoritmus használata nem tartja tiszteletben az arányossági elvet. "A francia lakosság csaknem felét ellenőrzik” - mondta Bastien Le Querrec, a La Quadrature du Net (LQDN) jogi szakértője.

A nem kormányzati szervezetek szerint továbbá a CNAF algoritmusa közvetve diszkriminál bizonyos személyeket, ami sérti az egyenlő bánásmód elvéről szóló uniós irányelvet és az EU alapjogi chartáját. Szerintük az algoritmus a szociális juttatásokban részesülő szegényebb személyeket célozza meg, mivel a juttatási szabályok bonyolultak, ami növeli a hibák valószínűségét. "Az algoritmus állandósítja a 'segélyfüggő' emberek politikai sztereotípiáját, és működési módszerei révén diszkriminál” - mondta Le Querrec. A CNAF algoritmusa például diszkriminálja a nőket, akik az egyszülős családok 95%-át teszik ki a különélést követő első 18 hónapban - mondta.

Jogi beadványukban a civil szervezetek azt írják, hogy a CNAF algoritmusa az ellenőrzések 69%-át váltja ki, ezek azonban az összes visszakövetelt hibás kifizetés 49%-át teszik ki. Ezzel szemben az egyéb módon kiváltott hitelellenőrzés az összes ellenőrzés 31%-át teszi ki, de a visszakeresett hibás kifizetések 51%-át. A nem kormányzati szervezetek ezért úgy vélik, hogy a pontozási algoritmusok megzavarják a közszolgáltatások méltányos kezelését, mivel bizonyos csoportokat túlzottan ellenőriznek a vitatott ellátások tekintetében.

"Egy pontozási algoritmus több, mint a kódsorok puszta összege; mindig politikai indíttatású, és gyakran támogatja az elnyomó megszorító politikákat, amelyek a legkiszolgáltatottabbaknak ártanak” - mondta Soizic Pénicaud, aki független kutatóként a Lighthouse Reports CNAF-vizsgálatán dolgozott, és a Sciences Po digitális közpolitika előadója. Franciaország nincs egyedül az ilyen algoritmusok alkalmazásával. Hasonló algoritmusokat használnak más uniós országokban, többek között Hollandiában és Dániában is - tette hozzá Pénicaud. Németország még jogszabályi keretbe is kívánja foglalni.

A franciaországi eset kifejezetten a hatóságok ilyen algoritmusainak célzott használatára mutat rá. A holland kormány 2021 januárjában lemondott, miután a pontozó algoritmusok több ezer szülőt vádoltak meg tévesen csalással. Dániában az állami ellátások adminisztrációjának pontozási algoritmusa a Lighthouse Reports és a WIRED 2023. márciusi jelentése után azért került tűz alá, mert állítólag nemzetiségen alapuló adatokat használt - az etnikai profilalkotáshoz hasonlóan - a segélykérelmező csalók elfogására.

Pénicaud a bizonyítási teher megfordítását javasolja, miszerint „az uniós országoknak a bevezetés előtt be kell bizonyítaniuk, hogy rendszereik nem károsak és nem diszkriminatívak”. Az Európai Parlament belső piaci bizottsága (ITRE) 2023 októberében ugyanezt a gondolatot fogalmazta meg, amikor elfogadta az online szolgáltatások addiktív kialakításáról szóló saját kezdeményezésű jelentését, amely a digitális méltányossági törvény közelgő vitáiban is megjelenhet. "Ezek a kockázatértékelő rendszerek a mesterséges intelligenciáról szóló törvény értelmében elfogadhatatlan kockázatot jelentőnek tekinthetők” - mondta Pénicaud.