SG.hu

Végre elkészült a Samsung MI-re alkalmas memóriája

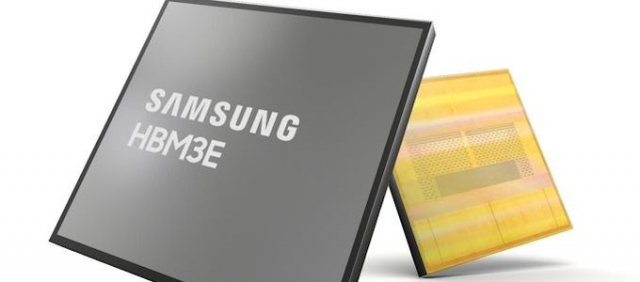

A Samsung Electronics ötödik generációs nagy sávszélességű memória (HBM) chipjeinek egy változata, a HBM3E átment az Nvidia tesztjein, az felhasználható a mesterséges intelligencia processzorokban.

A minősítés komoly akadályt gördített a világ legnagyobb memóriachipgyártója elé, amely eddig a helyi rivális SK Hynixszel szemben alulmaradt a generatív MI-terhelések elvégzésére alkalmas fejlett memóriachipek szállításáért folytatott versenyben. A Samsung és az Nvidia még nem írta alá a jóváhagyott nyolccsatornás HBM3E chipek szállítási szerződését, de hamarosan meg fogják tenni - mondták a források, hozzátéve, hogy várakozásaik szerint a szállítások 2024 negyedik negyedévében kezdődhetnek meg. A dél-koreai technológiai óriás HBM3E chipjeinek 12 rétegű változata azonban még nem ment át az Nvidia tesztjén. A Samsung azt közölte, hogy termékeinek tesztelése a tervek szerint halad, hozzátéve, hogy "a különböző ügyfelekkel való együttműködés révén folyamatban van termékeinek optimalizálása".

A HBM a dinamikus véletlen hozzáférésű memória vagy DRAM-szabvány egy olyan típusa, amelynek gyártása 2013-ban kezdődött meg. Ennél a chipeket függőlegesen egymásra helyezik a helytakarékosság és az energiafogyasztás csökkentése érdekében. A mesterséges intelligenciához használt grafikus feldolgozóegységek (GPU-k) kulcsfontosságú összetevője, segít feldolgozni az összetett alkalmazások által termelt hatalmas adatmennyiséget. A Samsung már tavaly óta igyekszik átmenni az Nvidia tesztjein a HBM3E és az azt megelőző negyedik generációs HBM3 modellekkel, de a hő- és energiafogyasztási problémák miatt eddig nehézségekbe ütközött. A vállalat azóta átdolgozta a HBM3E dizájnját, hogy megoldja ezeket a problémákat. "A Samsung még mindig felzárkózási fázisban van a HBM terén" - mondta Dylan Patel, a SemiAnalysis félvezető-kutatócsoport alapítója. "Míg ők a negyedik negyedévben kezdik meg a 8 rétegű HBM3E szállítását, addig a riválisuk, az SK Hynix száguld előre, és ezzel egy időben már a 12 rétegű HBM3E-t szállítja."

Az Nvidia nemrég tanúsította a Samsung HBM3 chipjeit a kínai piacra kifejlesztett, kevésbé kifinomult processzorokban való felhasználásra. A Samsung legújabb HBM chipjeinek Nvidia általi jóváhagyása a kifinomult, MI-re használt GPU-k iránti növekvő kereslet közepette történt, amelyet az Nvidia és más MI chipsetek gyártói nehezen tudnak kielégíteni. A TrendForce piackutató cég szerint a HBM3E chipek idén tömegtermékekké válnak, a szállítások pedig a második félévre koncentrálódnak. A vezető gyártó, az SK Hynix becslése szerint a HBM memóriachipek iránti kereslet általában véve 82%-kal nőhet, egészen 2027-ig bővülésre számítanak.

A HBM-nek mindössze három fő gyártója van: az SK Hynix, a Micronés a Samsung. Az SK Hynix az Nvidia fő beszállítója HBM-chipek terén. A Micron szintén közölte, hogy HBM3E chipeket fog szállítani az Nvidia számára. A Samsung júliusban azt prognosztizálta, hogy a HBM3E chipek a negyedik negyedévi HBM chipek értékesítésének 60%-át teszik majd ki, de ehhez az is kell(ett), hogy átmenjenek az Nvidia végleges jóváhagyásán. A Samsung nem közöl bevételi bontást az egyes chiptermékekre vonatkozóan, de elemzők szerint a Samsung teljes DRAM chip bevétele kb. 16,4 milliárd dollár lehet az idei első hat hónapban, és ennek mintegy 10%-a származhat a HBM értékesítéséből.

A minősítés komoly akadályt gördített a világ legnagyobb memóriachipgyártója elé, amely eddig a helyi rivális SK Hynixszel szemben alulmaradt a generatív MI-terhelések elvégzésére alkalmas fejlett memóriachipek szállításáért folytatott versenyben. A Samsung és az Nvidia még nem írta alá a jóváhagyott nyolccsatornás HBM3E chipek szállítási szerződését, de hamarosan meg fogják tenni - mondták a források, hozzátéve, hogy várakozásaik szerint a szállítások 2024 negyedik negyedévében kezdődhetnek meg. A dél-koreai technológiai óriás HBM3E chipjeinek 12 rétegű változata azonban még nem ment át az Nvidia tesztjén. A Samsung azt közölte, hogy termékeinek tesztelése a tervek szerint halad, hozzátéve, hogy "a különböző ügyfelekkel való együttműködés révén folyamatban van termékeinek optimalizálása".

A HBM a dinamikus véletlen hozzáférésű memória vagy DRAM-szabvány egy olyan típusa, amelynek gyártása 2013-ban kezdődött meg. Ennél a chipeket függőlegesen egymásra helyezik a helytakarékosság és az energiafogyasztás csökkentése érdekében. A mesterséges intelligenciához használt grafikus feldolgozóegységek (GPU-k) kulcsfontosságú összetevője, segít feldolgozni az összetett alkalmazások által termelt hatalmas adatmennyiséget. A Samsung már tavaly óta igyekszik átmenni az Nvidia tesztjein a HBM3E és az azt megelőző negyedik generációs HBM3 modellekkel, de a hő- és energiafogyasztási problémák miatt eddig nehézségekbe ütközött. A vállalat azóta átdolgozta a HBM3E dizájnját, hogy megoldja ezeket a problémákat. "A Samsung még mindig felzárkózási fázisban van a HBM terén" - mondta Dylan Patel, a SemiAnalysis félvezető-kutatócsoport alapítója. "Míg ők a negyedik negyedévben kezdik meg a 8 rétegű HBM3E szállítását, addig a riválisuk, az SK Hynix száguld előre, és ezzel egy időben már a 12 rétegű HBM3E-t szállítja."

Az Nvidia nemrég tanúsította a Samsung HBM3 chipjeit a kínai piacra kifejlesztett, kevésbé kifinomult processzorokban való felhasználásra. A Samsung legújabb HBM chipjeinek Nvidia általi jóváhagyása a kifinomult, MI-re használt GPU-k iránti növekvő kereslet közepette történt, amelyet az Nvidia és más MI chipsetek gyártói nehezen tudnak kielégíteni. A TrendForce piackutató cég szerint a HBM3E chipek idén tömegtermékekké válnak, a szállítások pedig a második félévre koncentrálódnak. A vezető gyártó, az SK Hynix becslése szerint a HBM memóriachipek iránti kereslet általában véve 82%-kal nőhet, egészen 2027-ig bővülésre számítanak.

A HBM-nek mindössze három fő gyártója van: az SK Hynix, a Micronés a Samsung. Az SK Hynix az Nvidia fő beszállítója HBM-chipek terén. A Micron szintén közölte, hogy HBM3E chipeket fog szállítani az Nvidia számára. A Samsung júliusban azt prognosztizálta, hogy a HBM3E chipek a negyedik negyedévi HBM chipek értékesítésének 60%-át teszik majd ki, de ehhez az is kell(ett), hogy átmenjenek az Nvidia végleges jóváhagyásán. A Samsung nem közöl bevételi bontást az egyes chiptermékekre vonatkozóan, de elemzők szerint a Samsung teljes DRAM chip bevétele kb. 16,4 milliárd dollár lehet az idei első hat hónapban, és ennek mintegy 10%-a származhat a HBM értékesítéséből.